El software y la tecnología pueden procesar grandes cantidades de datos de forma instantánea, lo que los hace muy atractivos para el uso gubernamental. Crédito:Shutterstock

En 2019, el ex relator especial de la ONU, Philip Alston, dijo que le preocupaba que estuviéramos "tropezando como zombis en una distopía de bienestar digital". Había estado investigando cómo las agencias gubernamentales de todo el mundo recurrían a los sistemas automatizados de toma de decisiones (ADS) para reducir costos, aumentar la eficiencia y orientar los recursos. Los ADS son sistemas técnicos diseñados para ayudar o reemplazar la toma de decisiones humanas mediante algoritmos.

Alston estaba preocupado por una buena razón. Las investigaciones muestran que los ADS se pueden utilizar de manera que discriminen, exacerben la desigualdad, infrinjan los derechos, clasifiquen a las personas en diferentes grupos sociales, limiten erróneamente el acceso a los servicios e intensifiquen la vigilancia.

Por ejemplo, las familias se han arruinado y se han visto obligadas a entrar en crisis después de haber sido acusadas falsamente de fraude de beneficios.

Los investigadores han identificado cómo los sistemas de reconocimiento facial y las herramientas de evaluación de riesgos tienen más probabilidades de identificar erróneamente a las personas con tonos de piel más oscuros y a las mujeres. Estos sistemas ya han llevado a arrestos injustos y decisiones de sentencias mal informadas.

A menudo, las personas solo se enteran de que han sido afectadas por una aplicación ADS cuando sucede una de dos cosas:después de que las cosas salen mal, como fue el caso del escándalo de los A-levels en el Reino Unido; o cuando las controversias se hacen públicas, como fue el caso de los usos de la tecnología de reconocimiento facial en Canadá y Estados Unidos.

Problemas automatizados

Una mayor transparencia, responsabilidad, rendición de cuentas y participación pública en el diseño y uso de ADS es importante para proteger los derechos y la privacidad de las personas. Hay tres razones principales para esto:

Nuestro último proyecto de investigación, Automatización de los servicios públicos:aprendizaje de los sistemas cancelados , proporciona hallazgos destinados a ayudar a prevenir daños y contribuir a un debate y una acción significativos. El informe proporciona la primera descripción general completa de los sistemas que se cancelan en las democracias occidentales.

Investigar los factores y las razones que conducen a la cancelación de los sistemas ADS nos ayuda a comprender mejor sus límites. En nuestro informe, identificamos 61 ADS que se cancelaron en Australia, Canadá, Europa, Nueva Zelanda y los EE. UU. Presentamos una descripción detallada de los sistemas cancelados en las áreas de detección de fraude, bienestar infantil y vigilancia. Nuestros hallazgos demuestran la importancia de una cuidadosa consideración y preocupación por la equidad.

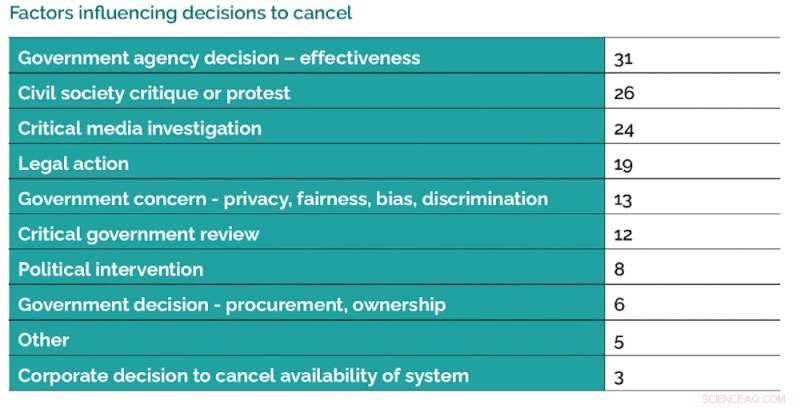

Hay una serie de factores que influyen en las decisiones de cancelar los usos de los sistemas ADS. Crédito:Data Justice Lab, proporcionado por el autor

Motivos de cancelación

Hay una serie de factores que influyen en las decisiones de cancelar los usos de ADS. Uno de nuestros hallazgos más importantes es la frecuencia con la que se cancelan los sistemas porque no son tan efectivos como se esperaba. Otro hallazgo clave es el importante papel que desempeñan la movilización y la investigación comunitarias, los reportajes de investigación y las acciones legales.

Nuestros hallazgos demuestran que existen interpretaciones, visiones y políticas contrapuestas en torno al uso de ADS.

Con suerte, nuestras recomendaciones conducirán a una mayor participación cívica y una mejor supervisión, rendición de cuentas y prevención de daños.

En el informe, señalamos los llamados generalizados para que los gobiernos establezcan registros de ADS con recursos como un primer paso básico para una mayor transparencia. Algunos países, como el Reino Unido, han declarado planes para hacerlo, mientras que otros países, como Canadá, aún no se han movido en esta dirección.

Nuestros hallazgos demuestran que el uso de ADS puede conducir a una mayor desigualdad e injusticia sistémica. Esto refuerza la necesidad de estar atentos a cómo el uso de ADS puede crear sistemas diferenciales de ventaja y desventaja.

Responsabilidad y transparencia

Los ADS deben desarrollarse con cuidado y responsabilidad mediante la participación significativa de las comunidades afectadas. Puede haber consecuencias dañinas cuando las agencias gubernamentales no involucran al público en discusiones sobre el uso apropiado de ADS antes de la implementación.

Este compromiso debe incluir la opción de que los miembros de la comunidad decidan las áreas en las que no desean que se utilice ADS. Los ejemplos de buenas prácticas de gobierno pueden incluir tomarse el tiempo para garantizar que se lleven a cabo revisiones de expertos independientes y evaluaciones de impacto que se centren en la igualdad y los derechos humanos.

Los gobiernos pueden adoptar varios enfoques diferentes para implementar los sistemas ADS de una manera más responsable. Crédito:Data Justice Lab, proporcionado por el autor

Recomendamos fortalecer la rendición de cuentas para aquellos que quieran implementar ADS al exigir pruebas de precisión, eficacia y seguridad, así como revisiones de legalidad. Como mínimo, las personas deberían poder averiguar si una ADS ha utilizado sus datos y, si es necesario, tener acceso a recursos para cuestionar y corregir evaluaciones erróneas.

Hay una serie de casos enumerados en nuestro informe en los que la asociación de agencias gubernamentales con empresas privadas para proporcionar servicios de ADS ha presentado problemas. En un caso, una agencia gubernamental decidió no utilizar un sistema de fijación de fianzas porque la naturaleza patentada del sistema significaba que los acusados y los funcionarios no podrían entender por qué se tomó una decisión, lo que imposibilitaba una impugnación efectiva.

Las agencias gubernamentales deben tener los recursos y las habilidades para examinar minuciosamente cómo adquieren los sistemas ADS.

Una política del cuidado

Todas estas recomendaciones apuntan a la importancia de una política del cuidado. Esto requiere que quienes deseen implementar ADS aprecien las complejidades de las personas, las comunidades y sus derechos.

Se deben hacer preguntas clave sobre cómo los usos de ADS conducen a puntos ciegos debido a la forma en que aumentan el distanciamiento entre los administradores y las personas a las que deben servir a través de sistemas de calificación y clasificación que simplifican en exceso, infieren culpabilidad, apuntan incorrectamente y estereotipan a las personas. a través de categorizaciones y cuantificaciones.

La buena práctica, en términos de una política de atención, implica tomarse el tiempo para considerar cuidadosamente los impactos potenciales de ADS antes de la implementación y responder a las críticas, garantizar una supervisión y revisión continuas y buscar una revisión independiente y comunitaria.

Este artículo se vuelve a publicar de The Conversation bajo una licencia Creative Commons. Lea el artículo original. El reconocimiento facial, las cámaras y otras herramientas que utiliza la policía plantean interrogantes sobre la responsabilidad