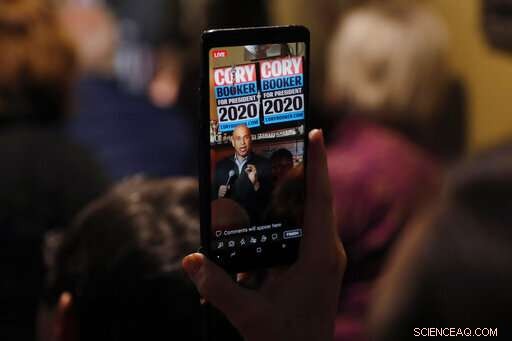

En este 9 de febrero, 2019, foto de archivo, Senador Cory Booker, D-N.J., es visto en un teléfono celular mientras habla durante un encuentro y saludo con los residentes locales en Marshalltown, Iowa. El Congreso está comenzando a mostrar interés en abrir la "caja negra" de la inteligencia artificial de las empresas de tecnología de la misma manera que el gobierno federal verifica debajo del capó de los autos y audita a los bancos. Una propuesta presentada el miércoles, 19 de abril y copatrocinado por Booker, requeriría que las grandes empresas prueben la "responsabilidad algorítmica" de sus sistemas de IA de alto riesgo, como la tecnología que detecta rostros o toma decisiones importantes en función de sus datos personales más confidenciales. (Foto AP / Charlie Neibergall, Expediente)

El Congreso está comenzando a mostrar interés en abrir la "caja negra" de la inteligencia artificial de las empresas de tecnología con una supervisión que se asemeja a la forma en que el gobierno federal verifica debajo del capó de los automóviles y audita a los bancos.

Una propuesta presentada el miércoles y copatrocinada por un candidato presidencial demócrata, Senador Cory Booker, requeriría que las grandes empresas prueben la "responsabilidad algorítmica" de sus sistemas de IA de alto riesgo, como la tecnología que detecta rostros o toma decisiones importantes en función de sus datos personales más confidenciales.

"Las computadoras están cada vez más involucradas en muchas de las decisiones clave que los estadounidenses toman con respecto a su vida diaria:si alguien puede comprar una casa, conseguir un trabajo o incluso ir a la cárcel, ", Dijo el senador Ron Wyden en una entrevista con The Associated Press. El demócrata de Oregon copatrocina el proyecto de ley.

"Cuando las empresas realmente se adentran en esto, buscarán sesgos en sus sistemas, ", Dijo Wyden." Creo que van a encontrar mucho ".

La propuesta de los demócratas es la primera de su tipo, y puede enfrentar una batalla cuesta arriba en el Senado liderado por los republicanos. Pero refleja un escrutinio creciente (y bipartidista) de la economía de datos, en gran parte no regulada, todo, desde las redes sociales, corretaje de datos en línea, algoritmos financieros y software de conducción autónoma que impactan cada vez más la vida diaria. Un proyecto de ley bipartidista del Senado presentado el mes pasado requeriría que las empresas notifiquen a las personas antes de usar software de reconocimiento facial en ellas. al mismo tiempo que requiere pruebas de terceros para verificar si hay problemas de sesgo.

Estudios académicos y ejemplos de la vida real han descubierto sistemas de reconocimiento facial que identifican erróneamente a las mujeres de piel oscura. herramientas de préstamos computarizadas que cobran tasas de interés más altas a los prestatarios latinos y negros, y herramientas de contratación laboral que favorezcan a los hombres en industrias en las que ya dominan.

En este 20 de marzo, 2019, trabajadores de fotografía toman fotos con sus teléfonos mientras el presidente Donald Trump habla en el Joint Systems Manufacturing Center en Lima, Ohio. El Congreso está comenzando a mostrar interés en abrir la "caja negra" de la inteligencia artificial de las empresas de tecnología de la misma manera que el gobierno federal verifica debajo del capó de los autos y audita a los bancos. La administración del presidente Donald Trump también está tomando nota y ha hecho del desarrollo de algoritmos "confiables" parte de la nueva iniciativa de inteligencia artificial de la Casa Blanca. (Foto AP / Michael Conroy, Expediente)

"Existe el mito de que los algoritmos son neutrales, cosas objetivas, "dijo Aaron Rieke, director gerente del grupo de defensa Upturn. "El aprendizaje automático detecta patrones en la sociedad:quién hace qué, quien compra que, o quién tiene qué trabajo. Esos son patrones moldeados por problemas con los que hemos estado luchando durante décadas ".

La administración del presidente Donald Trump también está tomando nota y ha hecho del desarrollo de algoritmos "seguros y confiables" un objetivo principal de la nueva iniciativa de inteligencia artificial de la Casa Blanca. Pero lo haría principalmente mediante el fortalecimiento de un proceso existente impulsado por la industria de creación de estándares tecnológicos.

"Existe la necesidad de una mayor transparencia y comparabilidad de datos, "y para detectar y reducir el sesgo en estos sistemas, dijo el subsecretario de Comercio, Walter Copan, quien dirige el Instituto Nacional de Estándares y Tecnología. "Los consumidores esencialmente están volando a ciegas".

Docenas de desarrolladores de reconocimiento facial, incluidas empresas de marca como Microsoft, el año pasado presentó sus algoritmos patentados a la agencia de Copan para que pudieran ser evaluados y comparados entre sí. Los resultados mostraron ganancias significativas en precisión con respecto a años anteriores.

Pero Wyden dijo que los estándares voluntarios no son suficientes.

"La autorregulación claramente ha fallado aquí, " él dijo.

En este 28 de junio 2018, foto de archivo del senador Ron Wyden, D-Ore., miembro de alto rango del Comité Senatorial de Finanzas, habla durante una audiencia en el Capitolio en Washington. El Congreso está comenzando a mostrar interés en abrir la "caja negra" de la inteligencia artificial de las empresas de tecnología con una supervisión que se asemeja a la forma en que el gobierno federal verifica debajo del capó de los automóviles y audita a los bancos. Una propuesta presentada el miércoles, 10 de abril, 2018 y copatrocinado por Wyden requeriría que las grandes empresas prueben la "responsabilidad algorítmica" de sus sistemas de inteligencia artificial que están ayudando a tomar importantes decisiones de justicia penal y afectando el acceso de las personas a la vivienda. crédito y empleo. (Foto AP / Jacquelyn Martin, Expediente)

En un movimiento más audaz de la administración Trump, el Departamento de Vivienda y Desarrollo Urbano federal ha acusado a Facebook de permitir que los propietarios y corredores de bienes raíces excluyan sistemáticamente a grupos como los no cristianos, inmigrantes y minorías de ver anuncios de casas y apartamentos.

Booker, en un comunicado sobre su factura, dijo que si bien la acción de Facebook de HUD es un paso importante, es necesario profundizar para abordar las "formas perniciosas" que opera la discriminación en las plataformas tecnológicas, a veces sin querer.

Booker dijo que los algoritmos sesgados están causando el mismo tipo de prácticas inmobiliarias discriminatorias que buscaban alejar a sus padres de Nueva Jersey y otras parejas negras de ciertos vecindarios estadounidenses a fines de la década de 1960. Esta vez, él dijo, es más difícil de detectar y luchar.

El proyecto de ley que él y Wyden han presentado permitiría a la Comisión Federal de Comercio establecer y hacer cumplir nuevas reglas para que las empresas verifiquen la precisión. sesgo y posibles preocupaciones de privacidad o seguridad en sus sistemas automatizados, y corregirlos si se encuentran problemas. Exime a las empresas más pequeñas que ganan menos de $ 50 millones al año, a menos que sean intermediarios de datos con información sobre al menos 1 millón de consumidores.

La representante demócrata de Nueva York Yvette Clarke, que está presentando un proyecto de ley complementario en la Cámara, dijo que el objetivo es solucionar problemas, no solo para evaluarlos. Dijo que tiene sentido otorgar a la FTC autoridad para monitorear regularmente el desempeño de estos sistemas porque "tiene el dedo en el pulso de lo que les está sucediendo a los consumidores".

© 2019 The Associated Press. Reservados todos los derechos.