Crédito:Marat Marihal / Shutterstock

Desde que las empresas comenzaron a desarrollar vehículos autónomos, La gente ha preguntado cómo los diseñadores abordarán la cuestión moral de a quién debería matar un automóvil autónomo si un accidente fatal es inevitable. Investigaciones recientes sugieren que esta pregunta puede ser aún más difícil de responder para los fabricantes de automóviles de lo que se pensaba anteriormente porque las preferencias morales de las personas varían mucho entre países.

Los investigadores, con sede en la Universidad de Harvard y el MIT, desarrolló un juego en línea que simula situaciones en las que un accidente automovilístico fatal era inevitable. Pidieron a alrededor de 40 millones de personas de más de 200 países que eligieran entre varios resultados de accidentes, como matar a los peatones en lugar de a los pasajeros del automóvil.

Los resultados revelaron tres grupos culturales donde había diferencias significativas en las preferencias éticas que tenían las personas. Por ejemplo, en el grupo del Sur (que incluía la mayor parte de América Latina y algunas antiguas colonias francesas), había una fuerte preferencia por perdonar a las mujeres sobre los hombres. El grupo oriental (que incluía muchos países islámicos además de China, Japón y Corea) tenían una menor preferencia por perdonar a las personas más jóvenes que a las personas mayores.

Los investigadores concluyeron diciendo que esta información debería influir en los desarrolladores de vehículos autónomos. ¿Pero es ese el caso realmente? Si bien este artículo destaca un descubrimiento interesante sobre las variaciones globales en las preferencias morales, también destaca un malentendido persistente sobre la IA, y lo que realmente puede hacer. Dada la tecnología de IA actual que se utiliza en los vehículos autónomos, la idea de que un vehículo pueda tomar una decisión moral es realmente imposible.

La fantasía de la 'máquina moral'

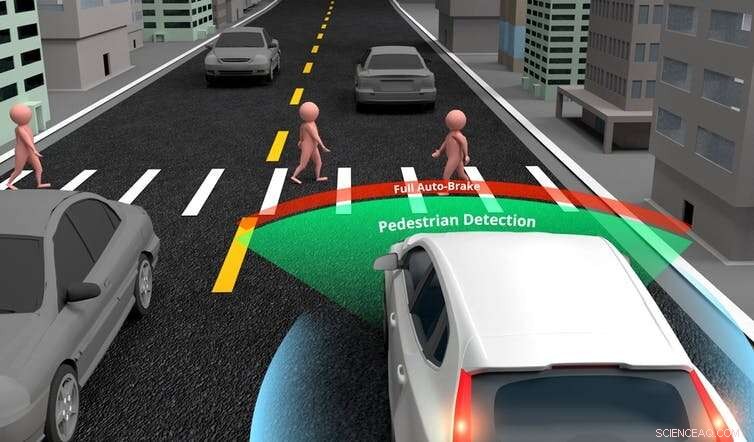

Los vehículos autónomos están capacitados para tomar decisiones sobre dónde girar o cuándo frenar, utilizando IA específica (o débil) (inteligencia artificial que se centra en completar una tarea limitada). Están diseñados con una variedad de sensores, cámaras y láseres de medición de distancia (lidar), que dan información a una computadora central. Luego, la computadora usa la IA para analizar estas entradas y tomar una decisión.

Aunque la tecnología es actualmente relativamente simple, los automóviles eventualmente superarán a los humanos en estas tareas básicas de conducción. Sin embargo, No es realista pensar que los coches autónomos también deberían ser capaces de tomar una decisión ética que incluso el más moral de los seres humanos no tendría tiempo de tomar en un escenario de accidente. Un automóvil debería programarse con IA general si se espera que haga esto.

La IA específica permite que los automóviles autónomos emitan juicios básicos sobre los objetos en su entorno. Crédito:Akarat Phasura / Shutterstock

La IA general es el equivalente de lo que nos hace humanos. Es la capacidad de conversar Disfruta la música, encontrar cosas divertidas o hacer juicios morales. Actualmente, producir IA general es imposible debido a la complejidad del pensamiento y las emociones humanas. Si requerimos vehículos autónomos morales, no llegaremos allí hasta dentro de varias décadas, si alguna vez.

Otro problema con la nueva investigación fue que muchas de las situaciones que se les pidió a los participantes que juzgaran no eran realistas. En un escenario que se hace eco del famoso "problema del carrito", Se preguntó a los participantes a quién debería matar el automóvil si fallaban los frenos:sus tres pasajeros (un hombre adulto, una mujer adulta y un niño) o tres peatones ancianos (dos hombres y una mujer).

Las personas pueden considerar cuidadosamente este tipo de problemas al responder un cuestionario. Pero en la mayoría de los accidentes de la vida real, un conductor no tendría tiempo para hacer tales juicios en la fracción de segundo antes de que suceda. Esto significa que la comparación no es válida. Y dada la tecnología de inteligencia artificial actual de los automóviles autónomos, estos vehículos tampoco podrán hacer estos juicios.

Los coches autónomos actuales tienen capacidades de detección sofisticadas y pueden distinguir a los peatones de otros objetos. como postes de luz o señales de tráfico. Sin embargo, los autores de la investigación sugieren que los coches autónomos pueden, será y tal vez debería poder hacer distinciones más avanzadas. Por ejemplo, podrían reconocer a las personas consideradas más deseables para la sociedad, como médicos o deportistas, y elige guardarlos en caso de accidente.

La realidad es que diseñar coches para hacer juicios tan avanzados implicaría producir IA general, que actualmente es imposible. También está la cuestión de si esto es incluso deseable. Si alguna vez es posible programar un automóvil para decidir qué vida se debe salvar, no es algo que creo que debamos permitir. No debemos permitir las preferencias identificadas en la investigación, por grande que sea el tamaño de la muestra, para determinar el valor de una vida.

En su forma más básica, Los coches autónomos se diseñan para evitar accidentes si pueden, y minimizar la velocidad en el impacto si no pueden. A pesar de que, como los humanos, no pueden tomar una decisión moral antes de un accidente inevitable. Pero los coches autónomos serán más seguros que los conductores humanos, ya que están más atentos, puede reaccionar más rápido y utilizará al máximo las capacidades del sistema de frenado en caso de accidente.

En la actualidad, El mayor desafío ético al que se enfrentan los diseñadores de automóviles autónomos es determinar cuándo hay suficiente evidencia de un comportamiento seguro a partir de simulaciones y pruebas controladas en la carretera para introducir automóviles autónomos en la carretera. Pero esto no significa que sean "morales", o lo será pronto. Decir eso es confundir la IA específica de realizar tareas de conducción con la IA general, que probablemente no existirá en nuestra vida.

Por último, los coches autónomos serán más seguros que los humanos. Lo conseguirán mediante el diseño y evitando accidentes siempre que sea posible, y reducir el daño donde no. Sin embargo, los coches no podrán tomar decisiones morales que ni siquiera nosotros podríamos. Esta noción sigue siendo una fantasía inverosímil, y no uno en el que debamos tener esperanza. En lugar de, concentrémonos en la seguridad:algo en lo que podremos tener una confianza justificada.

Este artículo se ha vuelto a publicar de The Conversation con una licencia de Creative Commons. Lea el artículo original.