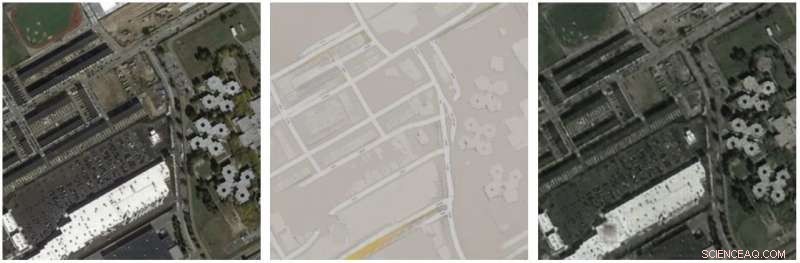

Los detalles en x se reconstruyen en GF x, a pesar de no aparecer en el mapa intermedio F x. Crédito:arXiv:1712.02950 [cs.CV]

Llámalo inteligente marcarlo como un tramposo, pero no se avergüence de encontrarlo terriblemente interesante. El "eso" es CycleGAN, y su vínculo a la esteganografía, donde los mensajes y la información se ocultan dentro de texto o datos no secretos.

Entonces, en 2019 no puede ser tan impactante que la gente se entere de que una máquina, no un humano, puede engañar a su manera a través de una tarea. La IA en este caso, como buenos espías y estafadores humanos, aprendió cuándo ocultar cierta información que se puede utilizar más adelante.

En Packt , Bhagyashree R escribió que "los investigadores descubrieron que la máquina estaba codificando datos del mapa aéreo en los patrones de ruido del mapa de calles en la parte inferior. El código era tan sutil que sería invisible para el ojo humano. Pero en una inspección más cercana, cuando los detalles fueron ampliados, estaba claro que la máquina había realizado miles de pequeños cambios de color que indicaban datos visuales que podrían usarse como una hoja de trucos al recrear la imagen aérea, de ahí los tragaluces que reaparecen mágicamente ".

Mientras tanto, un artículo muy citado sobre el tema (la investigación fue cubierta por varios sitios de observación de tecnología, en realidad) encapsuló lo que descubrieron los investigadores. "Se descubrió que un agente de aprendizaje automático destinado a transformar imágenes aéreas en mapas de calles y viceversa estaba engañando al ocultar información que necesitaría más adelante en un 'casi imperceptible, señal de alta frecuencia, " dijo TechCrunch .

Lily Hay Newman en Cableado en 2017 recordó a los lectores que la esteganografía es una práctica antigua, nada nacido ayer. Piense en Da Vinci incrustando un significado secreto en una pintura; o los espías de antaño escribiendo con tinta invisible.

Si la práctica es antigua, aunque, hay algunos problemas contemporáneos. Nosotros estamos, después de todo, en un mundo digital donde todos los vicios y virtudes han asumido nuevos procesos online.

La esteganografía solo se volverá más difícil de detectar, dijo BankInfoSecurity , y "ya ha sido utilizado por malos actores".

Mathew Schwartz dijo que la esteganografía digital parecía hacer la vida más difícil para las agencias de aplicación de la ley y citó a un profesor universitario que hizo un comentario similar. "El cifrado de disco esteganográfico perfectamente negable será una pesadilla cuando se trata de recopilar evidencia digital, "dijo Alan Woodward, profesor de informática en la Universidad de Surrey.

Avance rápido a los informes que están ahora, que un grupo de investigadores de Stanford y Google realizó un estudio sobre cómo una red neuronal, CycleGAN, aprende a hacer trampa. El periódico:CycleGAN, un maestro de esteganografía está en arXiv y los tres autores son Casey Chu (Stanford), Andrey Zhmoginov (Google) y Mark Sandler (Google).

Ellos escribieron, "CycleGAN aprende a 'ocultar' información sobre una imagen de origen en las imágenes que genera de una manera casi imperceptible, señal de alta frecuencia ".

Como parte de su sección de Discusión, los autores señalan que "Al codificar la información de esta manera, CycleGAN se vuelve especialmente vulnerable a los ataques adversarios; un atacante puede hacer que una de las transformaciones aprendidas produzca una imagen de su elección perturbando cualquier imagen de origen elegida ".

¿Su consejo? Escribieron que "la presencia de este fenómeno indica que se necesita precaución al diseñar funciones de pérdida que involucran composiciones de redes neuronales:tales modelos pueden comportarse de formas poco intuitivas si un componente aprovecha la capacidad del otro componente para soportar ejemplos contradictorios".

Marcos comunes, según los autores, como las redes generativas de confrontación y las pérdidas de percepción utilizan estas composiciones. Dijeron que "estos marcos deben analizarse cuidadosamente para asegurarse de que los ejemplos contradictorios no sean un problema".

Pero espera. ¿Deberíamos correr hacia las colinas con el temor de que los robots y la IA acaben con todos nosotros? Afortunadamente, Devin Coldewey calmó a los lectores en TechCrunch . La ocurrencia "simplemente revela un problema con las computadoras que ha existido desde que se inventaron:hacen exactamente lo que les dices que hagan".

¿Qué quiso decir Coldewey con eso? "La intención de los investigadores fue, como puedes adivinar, para acelerar y mejorar el proceso de conversión de imágenes satelitales en los famosos mapas precisos de Google. Con ese fin, el equipo estaba trabajando con lo que se llama CycleGAN, una red neuronal que aprende a transformar imágenes de tipo X e Y entre sí, de la manera más eficiente y precisa posible, a través de una gran cantidad de experimentación ".

La computadora llegó a una solución "que arrojó luz sobre una posible debilidad de este tipo de red neuronal:que la computadora, si no se lo impide explícitamente, esencialmente encontrará una manera de transmitirse detalles a sí mismo con el fin de resolver un problema determinado de forma rápida y sencilla ".

© 2019 Science X Network