Crédito:Nvidia

Aquí hay una cadena de palabras que puede reflexionar:gráficos interactivos de IA. Nvidia es el acto principal. Los cerebros de la GPU están completamente detrás de un próximo capítulo, "AI, "para la industria gráfica. Suceden cosas asombrosas cuando se pone un sistema de red neuronal a la mesa para mundos virtuales basados en secuencias de video.

Crear una escena digital realista normalmente requiere mucha (y mucha) paciencia. "Ahora podemos simplemente transferir el trabajo a un algoritmo de IA, "dijo Will Knight, en su mirada a lo que Nvidia está trabajando, en Revisión de tecnología del MIT .

Nvidia está anunciando lo que dijo fue el primer mundo virtual renderizado por IA interactiva, y lo llamó un "avance de la IA". El equipo de investigadores estuvo dirigido por Bryan Catanzaro, vicepresidente, Aprendizaje profundo aplicado. "En realidad, estamos enseñando al modelo a dibujar en función de un video real, "dijo en Revisión de tecnología del MIT .

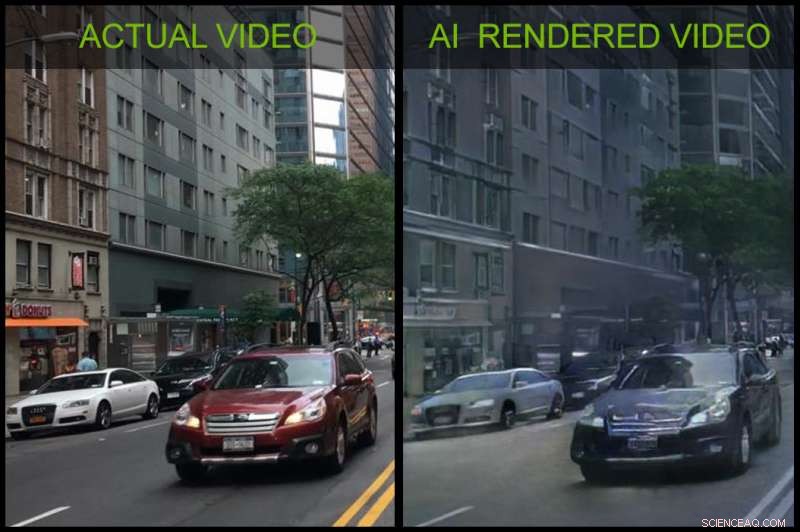

Los fotogramas son renderizados por tecnología AI, dijo el científico investigador, Ting-Chun Wang. En otras palabras, el equipo ha entrenado una red neuronal para renderizar entornos 3D después de haber sido entrenado en videos existentes.

Los avances comienzan con la pregunta de alguien. En Nvidia, la pregunta ¿qué pasaría si ...? ¿Qué pasaría si pudiéramos entrenar un modelo de IA para dibujar nuevos mundos simplemente basados en videos del mundo real? Entonces, ahora es un trato hecho en tecnología que muestra tal generación de imágenes.

Los usuarios objetivo son desarrolladores y artistas. La idea es que creen mundos virtuales 3D interactivos para automoción, juegos o realidad virtual.

Se seleccionaron videos de ciudades para renderizar entornos urbanos en los que entrenaron la red neuronal.

"Nos dieron secuencias de conducción de diferentes ciudades, ", dijo Ting-Chun Wang. Luego utilizaron otra red de segmentación, para extraer la semántica de alto nivel, él dijo, de esas secuencias.

El motor UE4 ayudó a generar los diseños coloreados:diferentes objetos recibieron diferentes colores. La red, a su vez, convierte la representación en imágenes.

[UE4 se refiere a Unreal Engine 4. El borde lo describió como "un motor popular utilizado para títulos como Fortnite, PUBG, Gears of War 4, y muchos otros ". El sitio Unreal Engine 4 dijo que es" un conjunto completo de herramientas de desarrollo de juegos creado por desarrolladores de juegos, para desarrolladores de juegos. "]

Nvidia ha mostrado su progreso en la conferencia NeurIPS en Montreal, Canadá, un programa centrado en la investigación de la IA.

Sí, pero, aparte del factor gee-whiz, ¿Cuál es el punto de? La creación de contenido es costosa y esta ruta de IA ahorra dinero y ahorra tiempo. Nuevo Atlas hizo la observación de que "Para hacer que los mundos virtuales se sientan más inmersivos, los artistas necesitan llenarlos de edificios, rocas árboles, y otros objetos. Crear y colocar todos esos objetos virtuales rápidamente se suma a un tiempo y un costo de desarrollo bastante altos ".

Para el desarrollo de juegos u otras aplicaciones, Nvidia exploró un método que permitiría a los desarrolladores crear a un costo menor, mediante el uso de IA que aprende del mundo real. El comunicado de prensa señaló que, dado que la producción se genera sintéticamente, "una escena se puede editar fácilmente para eliminar, modificar, o añadir objetos ".

James Vincent en El borde guió a los lectores a través del esfuerzo de investigación de Nvidia:

"El problema es, si los algoritmos de aprendizaje profundo generan los gráficos para el mundo a una velocidad de 25 fotogramas por segundo, ¿Cómo mantienen los objetos con el mismo aspecto? Catanzaro dice que este problema significaba que los resultados iniciales del sistema eran "dolorosos a la vista", ya que los colores y las texturas "cambiaban cada fotograma". El equipo le dio al sistema memoria a corto plazo, por lo que podría comparar un nuevo cuadro con el anterior. Como tal, crea nuevos marcos consistentes con lo que está en pantalla.

El comunicado de prensa de Nvidia dijo que "esta investigación está en una etapa inicial".

© 2018 Science X Network