Desde el lanzamiento de la vacuna COVID-19 en 2021, se ha atribuido ampliamente a las noticias falsas en las redes sociales la baja aceptación de la vacuna en los Estados Unidos, pero una investigación realizada por el MIT Sloan School of Management Ph.D. La candidata Jennifer Allen y el profesor David Rand consideran que la culpa está en otra parte.

En un nuevo artículo publicado en Science Y en coautoría con Duncan J. Watts de la Universidad de Pensilvania, los investigadores presentan una nueva metodología para medir el impacto causal del contenido de las redes sociales a escala. Muestran que el contenido engañoso de las principales fuentes de noticias, en lugar de información errónea o "noticias falsas", fue el principal impulsor de las dudas sobre las vacunas en Facebook.

"La desinformación se ha correlacionado con muchos desafíos sociales, pero no hay muchas investigaciones que demuestren que la exposición a la información errónea realmente cause daño", explicó Allen.

Durante la pandemia de COVID-19, por ejemplo, la difusión de información errónea relacionada con el virus y la vacuna recibió una importante atención pública. Sin embargo, la investigación existente, en su mayor parte, solo ha establecido correlaciones entre el rechazo de las vacunas y factores como compartir información errónea en línea, y ha pasado por alto en gran medida el papel del contenido "escéptico sobre las vacunas", que era potencialmente engañoso pero que Facebook no marcó como información errónea. -damas.

Para abordar esa brecha, los investigadores primero hicieron una pregunta clave:¿Qué sería necesario para que la información errónea o cualquier otro tipo de contenido tenga impactos de largo alcance?

"Para cambiar el comportamiento a escala, el contenido no sólo debe ser lo suficientemente persuasivo como para convencer a las personas de no vacunarse, sino que también debe ser visto ampliamente", dijo Allen. "El daño potencial resulta de la combinación de persuasión y exposición."

Para cuantificar la capacidad persuasiva del contenido, los investigadores realizaron experimentos aleatorios en los que mostraron a miles de participantes de la encuesta los titulares de 130 historias relacionadas con las vacunas (incluido contenido convencional e información errónea conocida) y probaron cómo esos titulares impactaban sus intenciones de vacunarse contra el COVID. 19.

Los investigadores también pidieron a un grupo separado de encuestados que calificaran los titulares según varios atributos, incluida la plausibilidad y la inclinación política. Un factor predijo de manera confiable los impactos en las intenciones de vacunación:el grado en que un titular sugería que la vacuna era perjudicial para la salud de una persona.

Utilizando la "sabiduría de las multitudes" y herramientas de inteligencia artificial para el procesamiento del lenguaje natural, Allen y sus coautores extrapolaron los resultados de la encuesta para predecir el poder persuasivo de las 13.206 URL relacionadas con la vacuna que fueron ampliamente vistas en Facebook en los primeros tres meses de la vacuna. lanzamiento.

Al combinar estas predicciones con datos de Facebook que muestran la cantidad de usuarios que vieron cada URL, los investigadores pudieron predecir el impacto general de cada titular:la cantidad de personas que podrían haber persuadido a no recibir la vacuna. Los resultados fueron sorprendentes.

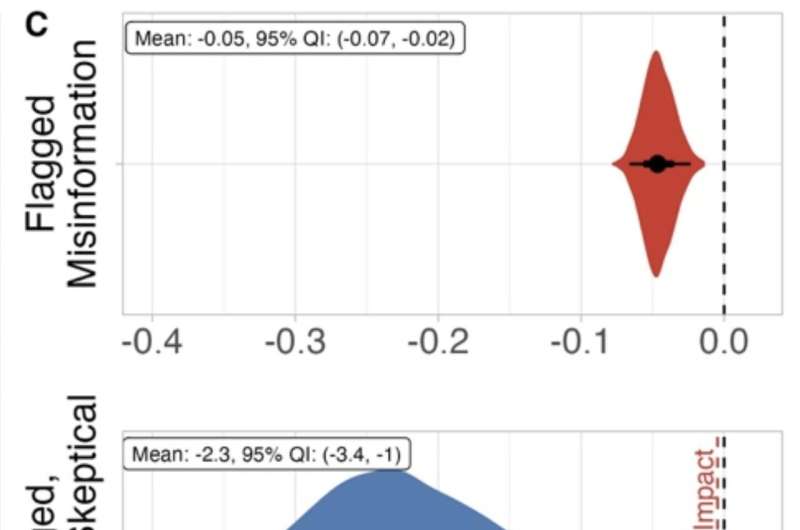

Contrariamente a la percepción popular, los investigadores estimaron que el contenido escéptico sobre las vacunas reducía las intenciones de vacunación 46 veces más que la información errónea señalada por los verificadores de datos.

¿La razón? Aunque la información errónea señalada era más dañina cuando se veía, tenía un alcance relativamente bajo. En total, los titulares relacionados con las vacunas en el conjunto de datos de Facebook recibieron 2.700 millones de visitas, pero el contenido marcado como información errónea recibió solo el 0,3 % de esas vistas, y el contenido de dominios calificados como de baja credibilidad recibió el 5,1 %.

"Aunque el contenido totalmente falso fue el que más redujo las intenciones de vacunación cuando se vio, comparativamente pocas personas lo vieron", explicó Rand. "Esencialmente, eso significa que existe esta clase de contenido de área gris que es menos dañino por exposición pero que se ve con mucha más frecuencia (y por lo tanto tiene más impacto en general) y que ha sido pasado por alto en gran medida tanto por los académicos como por las empresas de redes sociales".

En particular, varias de las URL más impactantes dentro del conjunto de datos eran artículos de fuentes convencionales que arrojaban dudas sobre la seguridad de la vacuna. Por ejemplo, el más visto fue un artículo, de una fuente de noticias importante y reconocida, que sugería que un médico murió dos semanas después de recibir la vacuna COVID-19. Este único titular recibió 54,9 millones de visitas, más de seis veces las vistas combinadas de toda la información errónea denunciada.

Si bien el cuerpo de este artículo reconocía la incertidumbre sobre la causa de la muerte del médico, su titular "clickbait" era muy sugerente e implicaba que la vacuna probablemente fuera la responsable. Esto es significativo ya que la gran mayoría de los espectadores en las redes sociales probablemente nunca hagan clic para leer más allá del titular.

Según Rand, una implicación de este trabajo es que los medios de comunicación deben tener más cuidado con sus titulares, incluso si eso significa que no llaman tanto la atención.

"Cuando escribes un titular, no deberías preguntarte simplemente si es falso o no", dijo. "Debería preguntarse si es probable que el titular genere percepciones inexactas".

Para las plataformas, añadió Allen, la investigación también señala la necesidad de una moderación más matizada, en todos los temas, no solo en la salud pública.

"La moderación de contenido se centra en identificar la información más notoriamente falsa, pero puede que no sea una forma eficaz de identificar el contenido más dañino en general", afirma. "Las plataformas también deben priorizar la revisión del contenido de las personas u organizaciones con el mayor número de seguidores y, al mismo tiempo, equilibrar la libertad de expresión. Necesitamos invertir en más investigación y soluciones creativas en este espacio, por ejemplo, herramientas de moderación colaborativas como X's Community Notes".

"Las decisiones de moderación de contenido pueden ser realmente difíciles debido a la tensión inherente entre querer mitigar el daño y permitir que las personas se expresen", dijo Rand. "Nuestro documento presenta un marco para ayudar a equilibrar esa compensación al permitir que las empresas de tecnología cuantifiquen realmente los daños potenciales".

Y las compensaciones podrían ser grandes. Un análisis exploratorio realizado por los autores encontró que si los usuarios de Facebook no hubieran estado expuestos a este contenido escéptico sobre las vacunas, hasta 3 millones de estadounidenses más podrían haber sido vacunados.

"No podemos simplemente ignorar este contenido de área gris", concluyó Allen. "Se podrían haber salvado vidas."