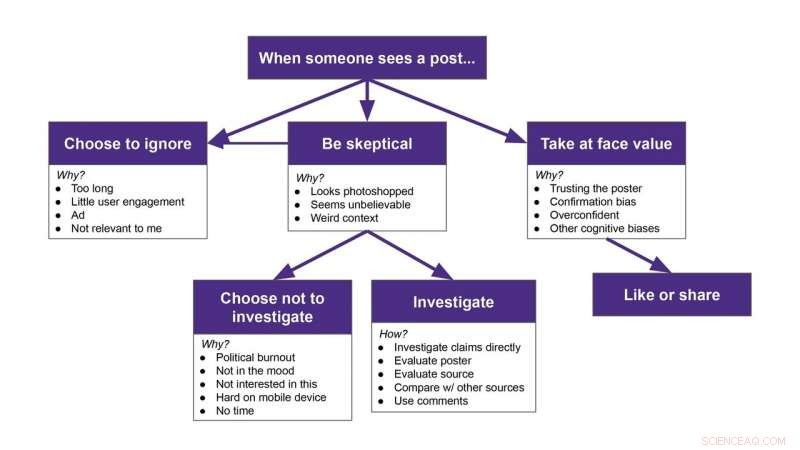

Los participantes tuvieron varias reacciones al encontrar una publicación falsa:algunos la ignoraron por completo, algunos lo tomaron al pie de la letra, algunos investigaron si era cierto, y algunos sospecharon de él, pero luego optaron por ignorarlo. Crédito:Franziska Roesner / Universidad de Washington

Plataformas de redes sociales, como Facebook y Twitter, proporcionar a las personas mucha información, pero cada vez es más difícil saber qué es real y qué no.

Los investigadores de la Universidad de Washington querían saber cómo las personas investigaban publicaciones potencialmente sospechosas en sus propios feeds. El equipo observó a 25 participantes desplazarse por sus feeds de Facebook o Twitter mientras, sin que ellos lo sepan, una extensión de Google Chrome agregó contenido desacreditado al azar en la parte superior de algunas de las publicaciones reales. Los participantes tuvieron varias reacciones al encontrar una publicación falsa:algunos la ignoraron por completo, algunos lo tomaron al pie de la letra, algunos investigaron si era cierto, y algunos sospecharon de él, pero luego optaron por ignorarlo. Estos resultados han sido aceptados en la conferencia ACM CHI de 2020 sobre factores humanos en sistemas informáticos.

"Queríamos entender qué hace la gente cuando encuentra noticias falsas o información errónea en sus feeds. ¿Lo notan? ¿Qué hacen al respecto?" dijo la autora principal Franziska Roesner, profesor asociado de la Universidad de Washington en la Escuela de Ingeniería y Ciencias de la Computación Paul G. Allen. "Hay muchas personas que intentan ser buenos consumidores de información y están luchando. Si podemos entender lo que hacen estas personas, tal vez podamos diseñar herramientas que puedan ayudarlos ".

Investigaciones anteriores sobre cómo las personas interactúan con la información errónea pedían a los participantes que examinaran el contenido de una cuenta creada por un investigador. no de alguien a quien eligieron seguir.

"Eso puede hacer que la gente sospeche automáticamente, "dijo la autora principal Christine Geeng, estudiante de doctorado de la Universidad de Washington en la Escuela Allen. "Nos aseguramos de que todas las publicaciones parecieran provenir de personas a las que nuestros participantes siguieron".

Los investigadores reclutaron a participantes de entre 18 y 74 años de toda el área de Seattle, explicando que el equipo estaba interesado en ver cómo la gente usa las redes sociales. Los participantes utilizaron Twitter o Facebook al menos una vez a la semana y, a menudo, utilizaron las plataformas de redes sociales en una computadora portátil.

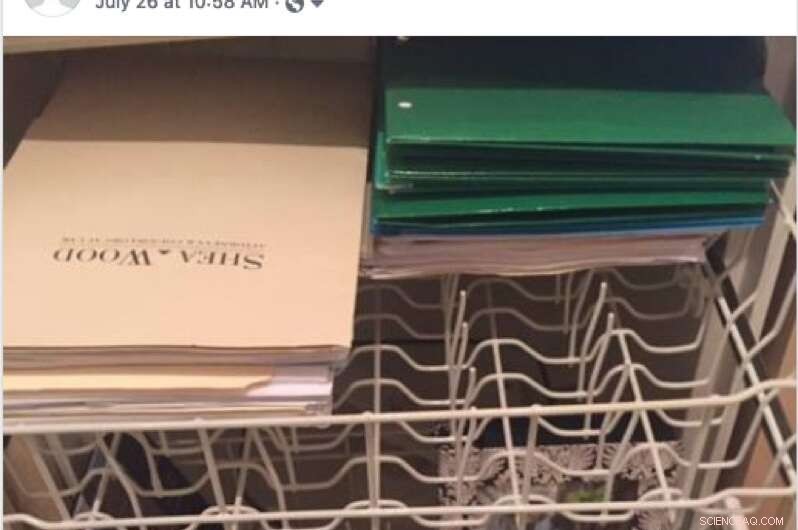

Un ejemplo de una publicación falsa que un participante podría ver en su feed de Facebook durante el estudio. Un participante mencionó que se saltó esta publicación porque vio la palabra "Florida" y decidió que no le pertenecía. Crédito:Geeng et al./2020 Conferencia ACM CHI sobre factores humanos en sistemas informáticos

Luego, el equipo desarrolló una extensión de Chrome que agregaría al azar publicaciones falsas o memes que habían sido desacreditados por el sitio web de verificación de hechos Snopes.com en la parte superior de las publicaciones reales para que pareciera temporalmente que las personas las estaban compartiendo en los feeds de los participantes. Entonces, en lugar de ver la publicación de un primo sobre unas vacaciones recientes, un participante vería a su primo compartir una de las historias falsas.

Los investigadores instalaron la extensión en la computadora portátil del participante o el participante inició sesión en sus cuentas en la computadora portátil del investigador, que tenía la extensión habilitada. El equipo les dijo a los participantes que la extensión modificaría sus feeds (los investigadores no dijeron cómo) y que realizarían un seguimiento de sus gustos y acciones durante el estudio. De hecho, no estaba rastreando nada. La extensión se eliminó de las computadoras portátiles de los participantes al final del estudio.

"Les pedimos que se desplacen por sus feeds con la extensión activa, "Dijo Geeng." Les dije que pensaran en voz alta sobre lo que estaban haciendo o lo que harían si estuvieran en una situación sin mí en la habitación. Entonces la gente hablaba de 'Oh sí, Leería este artículo, 'o' Me saltearía esto '. A veces hago preguntas como, '¿Por qué te saltas esto? ¿Por qué te gustaría eso? '"

En realidad, los participantes no podían dar me gusta ni compartir las publicaciones falsas. En Twitter, un "retweet" compartiría el contenido real debajo de la publicación falsa. La única vez que un participante retuiteó contenido debajo de la publicación falsa, los investigadores les ayudaron a deshacerlo después de que terminó el estudio. En Facebook, los botones Me gusta y Compartir no funcionaron en absoluto.

Después de que los participantes encontraron todas las publicaciones falsas, nueve para Facebook y siete para Twitter, los investigadores detuvieron el estudio y explicaron lo que estaba sucediendo.

"No fue como dijimos, 'Oye, había algunas publicaciones falsas allí '. Dijimos, 'Es difícil detectar la desinformación. Aquí están todas las publicaciones falsas que acaba de ver. Estos eran falsos y tus amigos realmente no los publicaron, ", Dijo Geeng." Nuestro objetivo no era engañar a los participantes o hacer que se sintieran expuestos. Queríamos normalizar la dificultad de determinar qué es falso y qué no ".

Un ejemplo de una publicación falsa que un participante podría ver en su feed de Facebook durante el estudio. Crédito:Geeng et al./2020 Conferencia ACM CHI sobre factores humanos en sistemas informáticos

Los investigadores concluyeron la entrevista pidiendo a los participantes que compartieran los tipos de estrategias que utilizan para detectar información errónea.

En general, los investigadores encontraron que los participantes ignoraban muchas publicaciones, especialmente aquellos que consideraron demasiado largos, overly political or not relevant to them.

But certain types of posts made participants skeptical. Por ejemplo, people noticed when a post didn't match someone's usual content. Sometimes participants investigated suspicious posts—by looking at who posted it, evaluating the content's source or reading the comments below the post—and other times, people just scrolled past them.

"I am interested in the times that people are skeptical but then choose not to investigate. Do they still incorporate it into their worldviews somehow?" Roesner said. "At the time someone might say, 'That's an ad. I'm going to ignore it.' But then later do they remember something about the content, and forget that it was from an ad they skipped? That's something we're trying to study more now."

While this study was small, it does provide a framework for how people react to misinformation on social media, dijo el equipo. Now researchers can use this as a starting point to seek interventions to help people resist misinformation in their feeds.

"Participants had these strong models of what their feeds and the people in their social network were normally like. They noticed when it was weird. And that surprised me a little, " Roesner said. "It's easy to say we need to build these social media platforms so that people don't get confused by fake posts. But I think there are opportunities for designers to incorporate people and their understanding of their own networks to design better social media platforms."