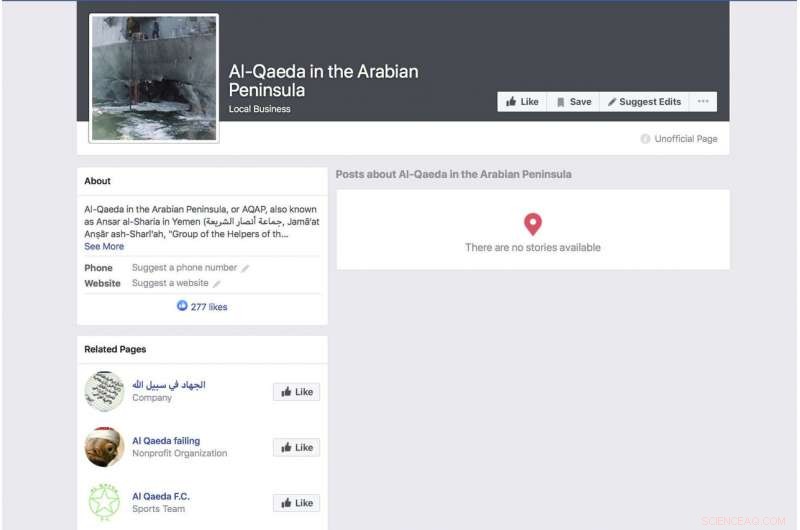

Una página de Facebook generada automáticamente para un grupo que se identifica como el grupo terrorista "Al-Qaeda en la Península Arábiga" muestra una foto del buque de guerra USS Cole de la Armada estadounidense bombardeado. La página todavía estaba activa el martes, Mayo 7, 2019, cuando se hizo la captura de pantalla. Facebook dice que tiene sistemas robustos para eliminar contenido de grupos extremistas, pero la denuncia de un denunciante sellada revisada por la AP dice que el contenido prohibido permanece en la web y es fácil de encontrar. (Facebook vía AP)

La pregunta surge una y otra vez, con material extremista, El discurso del odio, intromisión electoral e invasiones a la privacidad. ¿Por qué Facebook no puede simplemente arreglarlo?

Es complicado, con motivos que incluyen el tamaño de Facebook, su modelo de negocio y limitaciones técnicas, por no hablar de años de crecimiento descontrolado. Oh, y el elemento de la naturaleza humana.

La última revelación:Facebook está creando inadvertidamente videos de celebración utilizando contenido extremista y páginas comerciales autogeneradas para personas como ISIS y Al Qaida. La compañía dice que está trabajando en soluciones y que los problemas están mejorando. Eso es verdad, pero los críticos dicen que lo mejor no es suficiente cuando los tiroteos masivos se transmiten en vivo y las turbas en línea están difundiendo rumores que conducen a una violencia mortal.

"Han sido frustrantemente lentos al lidiar con todo, desde el abuso sexual infantil hasta el terrorismo, la supremacía blanca, intimidación, pornografía no consensual "y cosas como permitir que los anunciantes se orienten a categorías como" Odia a los judíos, "simplemente porque algunos usuarios habían incluido el término como" interés, "dijo Hany Farid, un experto en análisis forense digital de la Universidad de California, Berkeley.

A medida que surgen nuevos problemas, La fórmula de Facebook ha sido disculparse y prometer hacer cambios, a veces también observando que no anticipó cómo los actores malintencionados podrían hacer un mal uso de su plataforma con tanta facilidad. Más recientemente, la empresa también ha hecho hincapié en lo mucho que está mejorando, tanto técnicamente en su uso de inteligencia artificial para detectar problemas como en términos de enfocar más dinero y esfuerzo en solucionarlos.

En la página de Facebook de un usuario que se identifica como Nawan Al-Farancsa se muestra una pancarta que dice "El Estado Islámico". La página todavía estaba activa el martes, Mayo 7, 2019, cuando se hizo la captura de pantalla. Facebook dice que tiene sistemas robustos para eliminar contenido de grupos extremistas, pero la denuncia de un denunciante sellada revisada por la AP dice que el contenido prohibido permanece en la web y es fácil de encontrar. (Facebook vía AP)

"Después de realizar grandes inversiones, estamos detectando y eliminando contenido de terrorismo con una tasa de éxito mucho mayor que incluso en dos años, ", Dijo Facebook el miércoles en respuesta a las revelaciones sobre las páginas generadas automáticamente." No pretendemos encontrar todo, y nos mantenemos alerta en nuestros esfuerzos contra los grupos terroristas en todo el mundo ".

Ha tenido cierto éxito. A finales de 2016, El CEO Mark Zuckerberg descartó infamemente como "bastante loca" la idea de que las noticias falsas en su servicio podrían haber influido en las elecciones. Más tarde retrocedió, y desde entonces la empresa ha reducido la cantidad de información errónea compartida en su servicio, según lo medido por varios estudios independientes.

Zuckerberg también tiene, en general, evitó errores similares al admitir errores y ofrecer disculpas al público y a los legisladores.

Pero incluso cuando la empresa resuelve un problema, otros aparecen. La razón de eso podría estar incrustada en su ADN. Y eso no es solo porque su modelo de negocio se basa en que la mayor cantidad de personas posible lo use tanto como sea posible, dejando atrás datos personales que luego pueden ser dirigidos por los anunciantes.

En este jueves 29 de Marzo, 2018, foto de archivo, el logotipo de Facebook aparece en las pantallas del Nasdaq MarketSite, en Times Square de Nueva York. La pregunta surge una y otra vez, con material extremista, El discurso del odio, elecciones entrometidas, invasiones de privacidad, discriminación en la vivienda. ¿Por qué Facebook no puede simplemente arreglarlo? (Foto AP / Richard Drew, Expediente)

En este 11 de abril 2018, foto de archivo, El director ejecutivo de Facebook, Mark Zuckerberg, testifica ante una audiencia de Energía y Comercio de la Cámara de Representantes en Capitol Hill en Washington. Facebook da la impresión de que está deteniendo la gran mayoría de las publicaciones extremistas antes de que los usuarios las vean. Pero la denuncia de un denunciante confidencial a la Comisión de Bolsa y Valores obtenida por The Associated Press alega que la empresa de medios sociales ha exagerado su éxito. (Foto AP / Andrew Harnik, Expediente)

"Casi todo lo que Facebook ha diseñado ha sido diseñado para buenas personas. Las personas que son amables entre sí, que tienen cumpleaños para celebrar, que tienen nuevos cachorros y, en general, les gusta tratar bien a los demás, "dijo Siva Vaidhyanathan, director del Centro de Medios y Ciudadanía de la Universidad de Virginia. "Básicamente, Facebook está hecho para una especie mejor que la nuestra. Si estuviera hecho para perros perdigueros de oro, todo sería genial ".

Pero si solo el 1% de los 2.400 millones de personas en Facebook quieren hacer cosas terribles a los demás, eso es 24 millones de personas.

"Cada par de semanas, escuchamos que Facebook derriba páginas problemáticas, hacer promesas sobre la contratación de más personas, construyendo IA y así sucesivamente, ", Dijo Vaidhyanathan." Pero a la escala de Facebook, nada de eso importará. Básicamente estamos atrapados con toda esta basura ".

Chris Hughes, cofundador de Facebook, pidió la ruptura del gigante de las redes sociales en un artículo de opinión el jueves. Vaidhyanathan también cree que una fuerte regulación gubernamental podría ser la respuesta, como las leyes que "limitan la capacidad de las empresas de absorber todos nuestros datos y utilizarlos para orientar la publicidad".

"Realmente deberíamos abordar el back-end de Facebook, ", dijo." Eso es lo que tienes que atacar ".

© 2019 The Associated Press. Reservados todos los derechos.