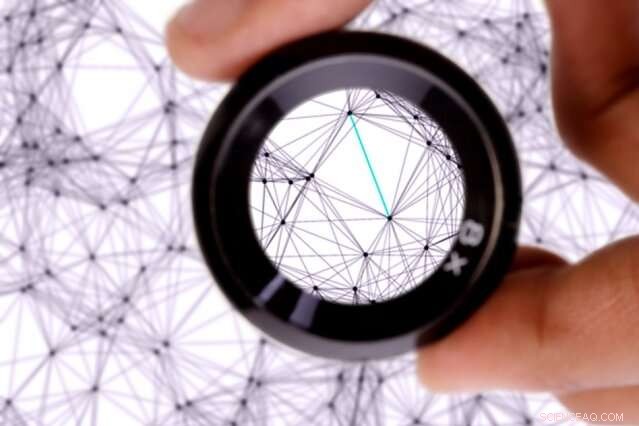

Investigadores del MIT y del Qatar Computing Research Institute (QCRI) están poniendo bajo el microscopio los sistemas de aprendizaje automático conocidos como redes neuronales. Crédito:MIT News

Investigadores del MIT y del Qatar Computing Research Institute (QCRI) están poniendo bajo el microscopio los sistemas de aprendizaje automático conocidos como redes neuronales.

En un estudio que arroja luz sobre cómo estos sistemas logran traducir texto de un idioma a otro, los investigadores desarrollaron un método que identifica nodos individuales, o "neuronas, "en las redes que capturan características lingüísticas específicas.

Las redes neuronales aprenden a realizar tareas computacionales procesando grandes conjuntos de datos de entrenamiento. En traducción automática, una red procesa los datos del lenguaje anotados por humanos, y presumiblemente "aprende" características lingüísticas, como morfología de palabras, estructura de la oración, y significado de la palabra. Dado nuevo texto, estas redes combinan estas características aprendidas de un idioma a otro, y producir una traducción.

Pero, entrenando, estas redes básicamente ajustan la configuración y los valores internos de una manera que los creadores no pueden interpretar. Para la traducción automática, eso significa que los creadores no necesariamente saben qué características lingüísticas captura la red.

En un artículo presentado en la conferencia de la Asociación para el Avance de la Inteligencia Artificial de esta semana, los investigadores describen un método que identifica qué neuronas son más activas al clasificar características lingüísticas específicas. También diseñaron un conjunto de herramientas para que los usuarios analicen y manipulen cómo sus redes traducen texto para diversos fines. como compensar cualquier sesgo de clasificación en los datos de entrenamiento.

En su papel los investigadores señalan las neuronas que se utilizan para clasificar, por ejemplo, palabras de género, tiempo pasado y presente, números al principio o en medio de las oraciones, y palabras en plural y singular. También muestran cómo algunas de estas tareas requieren muchas neuronas, mientras que otros requieren solo uno o dos.

"Nuestra investigación tiene como objetivo buscar el lenguaje dentro de las redes neuronales y ver qué información aprenden, "dice el coautor Yonatan Belinkov, un postdoctorado en el Laboratorio de Ciencias de la Computación e Inteligencia Artificial (CSAIL). "Este trabajo se trata de obtener una comprensión más detallada de las redes neuronales y tener un mejor control de cómo se comportan estos modelos".

Los coautores del artículo son:el científico investigador senior James Glass y el estudiante de pregrado Anthony Bau, de CSAIL; y Hassan Sajjad, Nadir Durrani, y Fahim Dalvi, de QCRI.

Poner un microscopio en las neuronas

Las redes neuronales están estructuradas en capas, donde cada capa consta de muchos nodos de procesamiento, cada uno conectado a nodos en capas arriba y abajo. Los datos se procesan primero en la capa más baja, que pasa una salida a la capa anterior, etcétera. Cada salida tiene un "peso" diferente para determinar cuánto figura en el cálculo de la siguiente capa. Durante el entrenamiento, estos pesos se reajustan constantemente.

Las redes neuronales utilizadas para la traducción automática se entrenan en datos de idiomas anotados. Entrenando, cada capa aprende diferentes "incrustaciones de palabras" para una palabra. Las incrustaciones de palabras son esencialmente tablas de varios cientos de números combinados de una manera que corresponde a una palabra y la función de esa palabra en una oración. Cada número de la incrustación es calculado por una sola neurona.

En su trabajo pasado, los investigadores entrenaron un modelo para analizar los resultados ponderados de cada capa para determinar cómo las capas clasificaban cualquier incrustación dada. Descubrieron que las capas inferiores clasificaban características lingüísticas relativamente más simples, como la estructura de una palabra en particular, y los niveles superiores ayudaban a clasificar características más complejas. como cómo las palabras se combinan para formar un significado.

En su nuevo trabajo, los investigadores utilizan este enfoque para determinar cómo las incrustaciones de palabras aprendidas hacen una clasificación lingüística. Pero también implementaron una nueva técnica, llamado "análisis de correlación lingüística, "que entrena un modelo para que se concentre en las neuronas individuales en cada incrustación de palabras que fueron más importantes en la clasificación.

La nueva técnica combina todas las incrustaciones capturadas de diferentes capas, cada una de las cuales contiene información sobre la clasificación final de la palabra, en una sola incrustación. A medida que la red clasifica una palabra determinada, el modelo aprende los pesos de cada neurona que se activó durante cada proceso de clasificación. Esto proporciona un peso a cada neurona en cada incrustación de palabras que se activa para una parte específica de la clasificación.

"La idea es, si esta neurona es importante, debe haber un gran peso que se aprende, ", Dice Belinkov." Las neuronas con pesos altos son las más importantes para predecir cierta propiedad lingüística. Puede pensar en las neuronas como un montón de botones que necesita girar para obtener la combinación correcta de números en la incrustación. Algunas perillas son más importantes que otras, por lo que la técnica es una forma de asignar importancia a esos botones ".

Ablación de neuronas, manipulación de modelos

Debido a que cada neurona está ponderada, se puede clasificar en orden de importancia. Con ese fin, los investigadores diseñaron un conjunto de herramientas, llamado NeuroX, que clasifica automáticamente todas las neuronas de una red neuronal según su importancia y las visualiza en una interfaz web.

Los usuarios cargan una red que ya han entrenado, así como texto nuevo. La aplicación muestra el texto y, junto a él, una lista de neuronas específicas, cada uno con un número de identificación. Cuando un usuario hace clic en una neurona, el texto se resaltará según las palabras y frases para las que se active la neurona. Desde allí, los usuarios pueden eliminar por completo, o "extirpar", las neuronas, o modificar el alcance de su activación, para controlar cómo se traduce la red.

La tarea de ablación se utilizó para determinar si el método de los investigadores identificaba con precisión las neuronas correctas de alto rango. En su papel los investigadores utilizaron la herramienta para demostrar que, mediante la ablación de neuronas de alto rango en una red, su desempeño en la clasificación de características lingüísticas correlacionadas se redujo significativamente. Alternativamente, cuando extirparon neuronas de rango inferior, rendimiento sufrido, pero no tan dramáticamente.

"Después de obtener todas estas clasificaciones, quieres ver qué sucede cuando matas estas neuronas y ver qué tanto afecta al rendimiento, ", Dice Belinkov." Ese es un resultado importante que demuestra que las neuronas que encontramos son, De hecho, importante para el proceso de clasificación ".

Una aplicación interesante del kit de herramientas es ayudar a limitar los sesgos en los datos del idioma. Modelos de traducción automática, como Google Translate, puede capacitar en datos con sesgo de género, lo que puede ser problemático para los idiomas con palabras de género. Ciertas profesiones, por ejemplo, puede ser referido más a menudo como masculino, y otros como mujeres. Cuando una red traduce texto nuevo, solo puede producir el género aprendido para esas palabras. En muchas traducciones en línea del inglés al español, por ejemplo, "doctor" a menudo se traduce en su versión masculina, mientras que "enfermera" se traduce en su versión femenina.

"Pero encontramos que podemos rastrear neuronas individuales a cargo de propiedades lingüísticas como el género, ", Dice Belinkov." Si eres capaz de rastrearlos, tal vez puedas intervenir de alguna manera e influir en la traducción para traducir estas palabras más al género opuesto ... para eliminar o mitigar el sesgo ".

En experimentos preliminares, los investigadores modificaron las neuronas en una red para cambiar el texto traducido del tiempo pasado al presente con un 67 por ciento de precisión. Ablaron para cambiar el género de las palabras con un 21 por ciento de precisión. "Todavía es un trabajo en progreso, "Dice Belinkov. El siguiente paso, él añade, está afinando la aplicación web para lograr una ablación y manipulación más precisas.

Esta historia se vuelve a publicar por cortesía de MIT News (web.mit.edu/newsoffice/), un sitio popular que cubre noticias sobre la investigación del MIT, innovación y docencia.