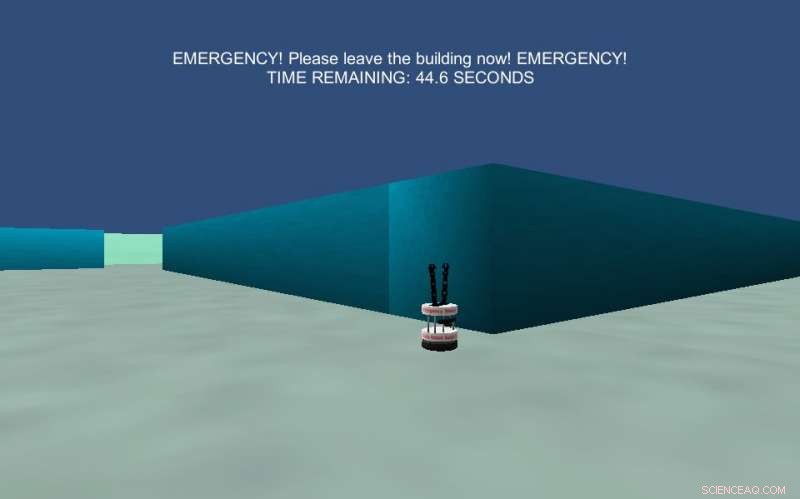

La imagen muestra un experimento de navegación por un laberinto que se describió como una situación de emergencia. A los participantes se les dijo que su tarea era actuar como si estuvieran en una evacuación de emergencia y tuvieran que encontrar una salida en 30 segundos para poder sobrevivir. Crédito:Wagner et al.

Investigadores de la Universidad Estatal de Pensilvania, El MIT y el Instituto de Tecnología de Georgia han desarrollado recientemente un marco conceptual para modelar el fenómeno de la confianza entre humanos y robots. Su marco, descrito en un artículo publicado en ACM Digital Library, utiliza representaciones computacionales inspiradas en la teoría de juegos para representar la confianza, una noción definida usando la teoría en psicología social.

La confianza juega un papel clave en las interacciones interpersonales, tanto en entornos profesionales como personales. Cuando una persona confía en otra, podrían decidir hacer algo que los ponga en un riesgo considerable, sosteniendo la creencia de que las acciones del otro mitigarán de alguna manera este riesgo.

Cuando se trata de definir la confianza, muchos investigadores coinciden en que conlleva una situación en la que un individuo es vulnerable y esta vulnerabilidad reside en las acciones, motivaciones, o comportamientos de otro. Alan R. Wagner, Paul Robinette, y Ayanna Howard, los tres investigadores detrás del estudio reciente, Quería crear un marco que pudiera usarse para modelar la confianza interpersonal entre humanos y robots.

"Estamos interesados en desarrollar robots que sepan cuándo confiar en los humanos, comprender qué situaciones requieren confianza y atraer la cantidad adecuada de confianza de los humanos, "Robinette explicó." Inicialmente, Nos motivó una investigación que sugiere que a veces la gente hace cosas raras cuando un robot se lo pide, como tirar libros de texto costosos y verter jugo de naranja en una maceta. También hay un número creciente de situaciones en las que los humanos se ponen en riesgo en manos de un robot (por ejemplo, automóviles autónomos, drones volando por encima, guardias de seguridad robot, etc.). Por lo tanto, queríamos desarrollar un marco que permitiera a los robots comprender las relaciones de confianza con los humanos ".

El marco conceptual desarrollado por Wagner y sus colegas generó varias hipótesis comprobables relacionadas con la confianza entre humanos y robots. En su estudio, los investigadores examinaron estas hipótesis generadas y realizaron una serie de experimentos, reuniendo pruebas que respaldaban su marco y estaban en conflicto con él.

"El marco de confianza comenzó en la investigación de Alan, que definió la confianza de una manera que las computadoras, y así robots, puede utilizar, "Dijo Robinette.

En su trabajo anterior, Wagner definió la confianza situacional como 'una creencia, en poder del fideicomitente, que el fiduciario actuará de manera que mitigue el riesgo del fideicomitente en una situación en la que el fideicomitente ha puesto en riesgo sus resultados ”. Su definición se centra principalmente en el riesgo que implica una situación determinada, destacando también la creencia de que una persona / robot actuará para reducir el riesgo para la otra persona / robot.

"Nuestro marco proporciona criterios para lo que constituye una situación de confianza y ofrece varias categorías de situaciones que no requieren confianza, por ejemplo, cuando no haya riesgo para el fideicomitente o cuando el riesgo no pueda mitigarse por una razón u otra, "Robinette dijo." Con este marco, un robot puede evaluar por sí mismo si la situación en la que se encuentra requiere confianza o no, y luego actuar de manera apropiada ".

Los investigadores probaron las hipótesis generadas por su marco en una serie de pruebas y experimentos. Por ejemplo, en un experimento, presentaron a un grupo de participantes humanos escenarios que implicaban confiar o no confiar en otra persona, luego les preguntó cuál de estas dos opciones elegirían. Los participantes coincidieron con las condiciones de confianza que genera su marco, en un grado muy alto.

Los investigadores llevaron a cabo varios otros experimentos que evaluaron la precisión de las hipótesis generadas por su marco conceptual. Algunas de estas pruebas reunidas que apoyan estas hipótesis, mientras que algunos produjeron resultados contradictorios.

"Creo que el hallazgo más significativo de este trabajo es que encontramos considerable evidencia de apoyo para este marco en estudios con muchos participantes de diversos orígenes, ", Dijo Robinette." Esto significa que el marco de confianza se puede utilizar en la mayoría de las situaciones, permitiendo que los robots comprendan mejor por qué los humanos que los rodean actúan como lo hacen. El robot incluso puede usar este marco para guiar a los humanos a situaciones menos riesgosas, por ejemplo, reconociendo que una persona confía demasiado en un robot, tal vez para hacer algo para lo que no fue programado, e informar a la persona de su error ".

El marco ideado por Wagner y sus colegas podría aplicarse a una variedad de situaciones que involucran la confianza entre humanos y robots. Sin embargo, en algunos casos, las hipótesis del marco no eran lo suficientemente precisas, por ejemplo, cuando se pidió a las personas que confiaran en un robot en lo que parecía ser una situación de emergencia.

No obstante, estos hallazgos son valiosos, ya que arrojan luz sobre áreas específicas en las que a las personas les resulta más difícil confiar en los robots. Las investigaciones futuras podrían analizar más de cerca por qué los participantes tomaron estas decisiones y qué les impidió confiar en los robots. al mismo tiempo que exploran formas en las que los ingenieros en robótica pueden mejorar la seguridad alrededor de los robots.

"Alan y Ayanna han estado trabajando para ampliar esta investigación al dominio de la robótica sanitaria, ", Dijo Robinette." Creo que Alan también tiene un proyecto para investigar con mayor detalle los robots de evacuación de emergencia y su relación con las personas. Recientemente he estado trabajando en la formación de equipos entre humanos y máquinas y planeo aplicar este marco de confianza a la relación entre los humanos y los robots con los que trabajan ".

© 2018 Science X Network