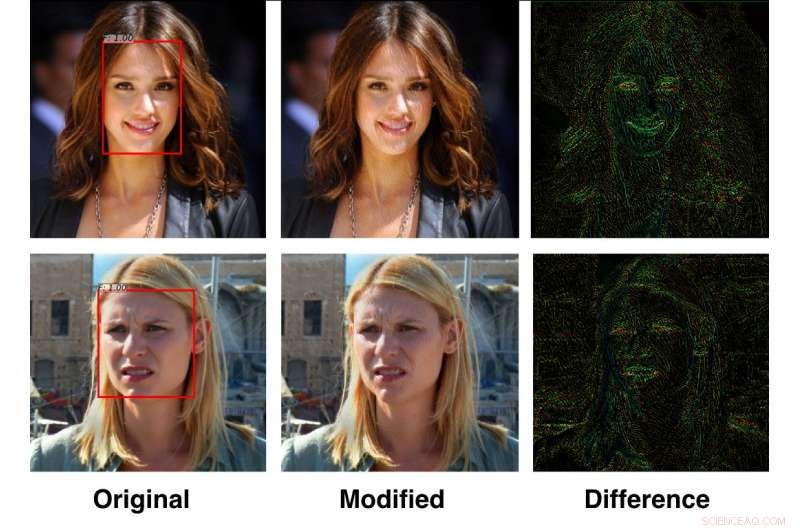

Los investigadores de U of T Engineering han diseñado un 'filtro de privacidad' que interrumpe los algoritmos de reconocimiento facial. El sistema se basa en dos algoritmos creados por IA:uno que realiza detección continua de rostros, y otro diseñado para interrumpir el primero. Crédito:Avishek Bose

Cada vez que subes una foto o un video a una plataforma de redes sociales, sus sistemas de reconocimiento facial aprenden un poco más sobre ti. Estos algoritmos ingieren datos sobre quién eres, su ubicación y las personas que conoce, y están mejorando constantemente.

A medida que aumentan las preocupaciones sobre la privacidad y la seguridad de los datos en las redes sociales, Los investigadores de la U of T Engineering dirigidos por el profesor Parham Aarabi y el estudiante de posgrado Avishek Bose han creado un algoritmo para interrumpir dinámicamente los sistemas de reconocimiento facial.

"La privacidad personal es un problema real a medida que el reconocimiento facial se vuelve cada vez mejor, ", dice Aarabi." Ésta es una forma en la que los sistemas beneficiosos de reconocimiento facial pueden combatir esa capacidad ".

Su solución aprovecha una técnica de aprendizaje profundo llamada entrenamiento contradictorio, que enfrenta a dos algoritmos de inteligencia artificial entre sí. Aarabi y Bose diseñaron un conjunto de dos redes neuronales:la primera que trabaja para identificar caras, y el segundo trabajando para interrumpir la tarea de reconocimiento facial del primero. Los dos están constantemente luchando y aprendiendo el uno del otro, el establecimiento de una carrera armamentista de IA en curso.

El resultado es un filtro similar a Instagram que se puede aplicar a las fotos para proteger la privacidad. Su algoritmo altera píxeles muy específicos en la imagen, realizando cambios que son casi imperceptibles para el ojo humano.

"La IA disruptiva puede 'atacar' lo que busca la red neuronal para la detección de rostros, ", dice Bose." Si la IA de detección está buscando por el rabillo del ojo, por ejemplo, ajusta la esquina de los ojos para que se noten menos. Crea alteraciones muy sutiles en la foto, pero para el detector son lo suficientemente importantes como para engañar al sistema ".

Aarabi y Bose probaron su sistema en el conjunto de datos faciales de 300 W, un grupo estándar de la industria de más de 600 rostros que incluye una amplia gama de etnias, condiciones y ambientes de iluminación. Demostraron que su sistema podía reducir la proporción de rostros que eran originalmente detectables desde casi el 100 por ciento hasta el 0,5 por ciento.

"La clave aquí fue entrenar las dos redes neuronales entre sí, con una creando un sistema de detección facial cada vez más robusto, y el otro crea una herramienta cada vez más potente para desactivar la detección facial, "dice Bose, el autor principal del proyecto. El estudio del equipo se publicará y presentará en el Taller internacional IEEE 2018 sobre procesamiento de señales multimedia a finales de este verano.

Además de deshabilitar el reconocimiento facial, la nueva tecnología también interrumpe la búsqueda basada en imágenes, identificación de características, estimación de la emoción y la etnia, y todos los demás atributos basados en rostros que podrían extraerse automáticamente.

Próximo, el equipo espera que el filtro de privacidad esté disponible públicamente, ya sea a través de una aplicación o un sitio web.

"Hace diez años, estos algoritmos tendrían que ser definidos por humanos, pero ahora las redes neuronales aprenden por sí mismas; no es necesario que les proporcione nada más que datos de entrenamiento, "dice Aarabi." Al final, pueden hacer cosas realmente asombrosas. Es un momento fascinante en el campo hay un potencial enorme ".