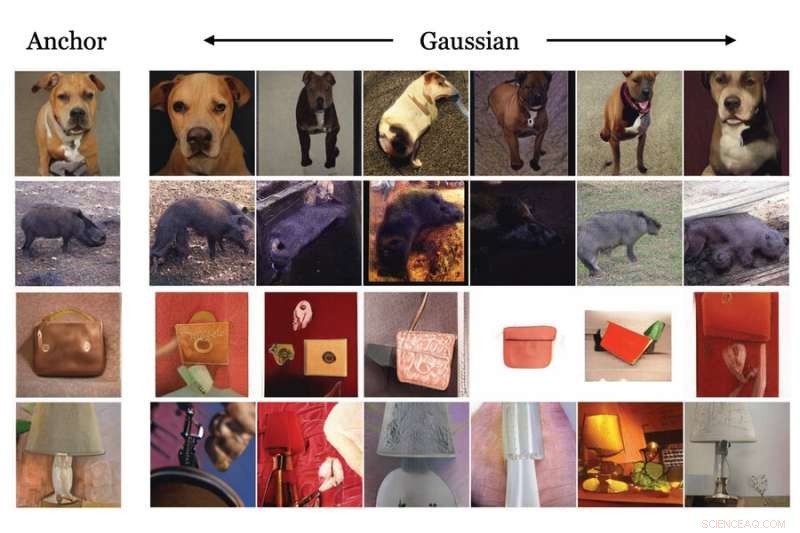

Los investigadores del MIT han demostrado el uso de un modelo generativo de aprendizaje automático para crear datos sintéticos, basados en datos reales, que pueden usarse para entrenar otro modelo para la clasificación de imágenes. Esta imagen muestra ejemplos de los métodos de transformación del modelo generativo. Crédito:Instituto de Tecnología de Massachusetts

Se necesitan enormes cantidades de datos para entrenar modelos de aprendizaje automático para realizar tareas de clasificación de imágenes, como identificar daños en fotografías satelitales después de un desastre natural. Sin embargo, estos datos no siempre son fáciles de obtener. La generación de conjuntos de datos puede costar millones de dólares, si existen datos utilizables en primer lugar, e incluso los mejores conjuntos de datos a menudo contienen sesgos que afectan negativamente el rendimiento de un modelo.

Para evitar algunos de los problemas que presentan los conjuntos de datos, los investigadores del MIT desarrollaron un método para entrenar un modelo de aprendizaje automático que, en lugar de usar un conjunto de datos, usa un tipo especial de modelo de aprendizaje automático para generar datos sintéticos extremadamente realistas que pueden entrenar otro modelo para tareas de visión aguas abajo.

Sus resultados muestran que un modelo de aprendizaje de representación contrastivo entrenado usando solo estos datos sintéticos es capaz de aprender representaciones visuales que rivalizan o incluso superan a las aprendidas a partir de datos reales.

Este modelo especial de aprendizaje automático, conocido como modelo generativo, requiere mucha menos memoria para almacenar o compartir que un conjunto de datos. El uso de datos sintéticos también tiene el potencial de eludir algunas preocupaciones sobre la privacidad y los derechos de uso que limitan cómo se pueden distribuir algunos datos reales. También se podría editar un modelo generativo para eliminar ciertos atributos, como la raza o el género, lo que podría abordar algunos sesgos que existen en los conjuntos de datos tradicionales.

"Sabíamos que este método eventualmente debería funcionar; solo necesitábamos esperar a que estos modelos generativos mejoraran cada vez más. Pero nos complació especialmente cuando demostramos que este método a veces funciona incluso mejor que el modelo real", dice Ali Jahanian, científico investigador en el Laboratorio de Ciencias de la Computación e Inteligencia Artificial (CSAIL) y autor principal del artículo.

Jahanian escribió el artículo con los estudiantes graduados de CSAIL Xavier Puig y Yonglong Tian, y el autor principal Phillip Isola, profesor asistente en el Departamento de Ingeniería Eléctrica y Ciencias de la Computación. La investigación se presentará en la Conferencia Internacional sobre Representaciones de Aprendizaje.

Generación de datos sintéticos

Una vez que un modelo generativo ha sido entrenado con datos reales, puede generar datos sintéticos tan realistas que casi no se pueden distinguir de los reales. El proceso de entrenamiento involucra mostrar al modelo generativo millones de imágenes que contienen objetos en una clase particular (como autos o gatos), y luego aprende cómo se ve un auto o un gato para poder generar objetos similares.

Esencialmente, al accionar un interruptor, los investigadores pueden usar un modelo generativo previamente entrenado para generar un flujo constante de imágenes únicas y realistas que se basan en las del conjunto de datos de entrenamiento del modelo, dice Jahanian.

Pero los modelos generativos son aún más útiles porque aprenden a transformar los datos subyacentes en los que se entrenan, dice. Si el modelo se entrena con imágenes de automóviles, puede "imaginar" cómo se vería un automóvil en diferentes situaciones (situaciones que no vio durante el entrenamiento) y luego generar imágenes que muestran el automóvil en poses, colores o tamaños únicos.

Tener múltiples vistas de la misma imagen es importante para una técnica llamada aprendizaje contrastivo, donde un modelo de aprendizaje automático muestra muchas imágenes sin etiquetar para saber qué pares son similares o diferentes.

Los investigadores conectaron un modelo generativo previamente entrenado a un modelo de aprendizaje contrastivo de una manera que permitió que los dos modelos trabajaran juntos automáticamente. El alumno contrastivo podría decirle al modelo generativo que produzca diferentes vistas de un objeto y luego aprender a identificar ese objeto desde múltiples ángulos, explica Jahanian.

"Fue como conectar dos bloques de construcción. Debido a que el modelo generativo puede brindarnos diferentes puntos de vista de la misma cosa, puede ayudar al método contrastivo a aprender mejores representaciones", dice.

Incluso mejor que la cosa real

Los investigadores compararon su método con varios otros modelos de clasificación de imágenes que se entrenaron con datos reales y descubrieron que su método funcionaba tan bien, y en ocasiones mejor, que los otros modelos.

Una ventaja de usar un modelo generativo es que, en teoría, puede crear un número infinito de muestras. Entonces, los investigadores también estudiaron cómo la cantidad de muestras influía en el rendimiento del modelo. Descubrieron que, en algunos casos, generar un mayor número de muestras únicas condujo a mejoras adicionales.

"Lo bueno de estos modelos generativos es que alguien más los entrenó por ti. Puedes encontrarlos en repositorios en línea, para que todos puedan usarlos. Y no necesitas intervenir en el modelo para obtener buenas representaciones", dice Jahanian. .

Pero advierte que existen algunas limitaciones en el uso de modelos generativos. En algunos casos, estos modelos pueden revelar datos de origen, lo que puede plantear riesgos de privacidad, y podrían amplificar los sesgos en los conjuntos de datos en los que están capacitados si no se auditan adecuadamente.

Él y sus colaboradores planean abordar esas limitaciones en trabajos futuros. Otra área que quieren explorar es el uso de esta técnica para generar casos de esquina que podrían mejorar los modelos de aprendizaje automático. Los casos de esquina a menudo no se pueden aprender de datos reales. Por ejemplo, si los investigadores están entrenando un modelo de visión por computadora para un automóvil autónomo, los datos reales no contendrían ejemplos de un perro y su dueño corriendo por una carretera, por lo que el modelo nunca aprendería qué hacer en esta situación. La generación sintética de esos datos de caso de esquina podría mejorar el rendimiento de los modelos de aprendizaje automático en algunas situaciones de alto riesgo.

Los investigadores también quieren seguir mejorando los modelos generativos para poder componer imágenes que sean aún más sofisticadas, dice.