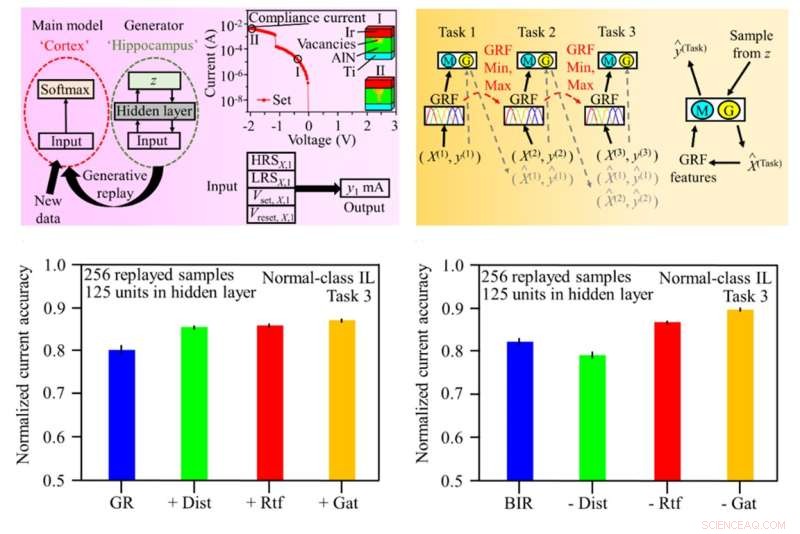

Gráficos de la configuración de reproducción generativa (panel superior izquierdo) y esquema para entrenar una red neuronal artificial (ANN) con reproducción generativa (panel superior derecho). La precisión normalizada de la corriente eléctrica para los modelos convencionales (panel inferior izquierdo) y de reproducción inspirada en el cerebro (BIR) (panel inferior derecho). Crédito:SUTD

Como lo demuestran los avances en varios campos de la inteligencia artificial (IA), como el procesamiento de imágenes, la atención médica inteligente, los vehículos autónomos y las ciudades inteligentes, este es sin duda el período dorado del aprendizaje profundo. En la próxima década más o menos, la inteligencia artificial y los sistemas informáticos eventualmente estarán equipados con la capacidad de aprender y pensar como lo hacen los humanos, para procesar el flujo continuo de información e interactuar con el mundo real.

Sin embargo, los modelos de IA actuales sufren una pérdida de rendimiento cuando se entrenan consecutivamente con nueva información. Esto se debe a que cada vez que se generan nuevos datos, se escriben encima de los datos existentes, borrando así la información anterior. Este efecto se conoce como "olvido catastrófico". Una dificultad surge del problema de estabilidad-plasticidad, donde el modelo de IA necesita actualizar su memoria para ajustarse continuamente a la nueva información y, al mismo tiempo, mantener la estabilidad de su conocimiento actual. Este problema impide que la IA de última generación aprenda continuamente de la información del mundo real.

Los sistemas informáticos perimetrales permiten trasladar la informática desde el almacenamiento en la nube y los centros de datos hasta cerca de la fuente original, como los dispositivos conectados a Internet de las cosas (IoT). La aplicación eficiente del aprendizaje continuo en sistemas informáticos de borde con recursos limitados sigue siendo un desafío, aunque se han propuesto muchos modelos de aprendizaje continuo para resolver este problema. Los modelos tradicionales requieren un alto poder de cómputo y una gran capacidad de memoria.

Un equipo de investigadores de la Universidad de Tecnología y Diseño de Singapur (SUTD), que incluye a Shao-Xiang Go, Qiang Wang, Bo Wang, Yu Jiang y Natasa Bajalovic. El equipo fue dirigido por el investigador principal, el profesor asistente Desmond Loke de SUTD. El estudio de estos investigadores, "Conducción eléctrica de aprendizaje continuo en materiales con memoria de conmutación resistiva", se publicó en la revista Advanced Theory and Simulations. .

El equipo propuso Brain-Inspired Replay (BIR), un modelo inspirado en el cerebro, que realiza un aprendizaje continuo de forma natural. El modelo BIR, basado en el uso de una red neuronal artificial y un autocodificador variacional, imita las funciones del cerebro humano y puede funcionar bien en situaciones de aprendizaje incremental en clase sin almacenar datos. Los investigadores también usaron el modelo BIR para representar el crecimiento de filamentos conductores usando corriente eléctrica en sistemas de memoria digital.

"En este modelo, el conocimiento se conserva dentro de los modelos entrenados para minimizar la pérdida de rendimiento tras la introducción de tareas adicionales, sin necesidad de consultar datos de trabajos anteriores", explicó el profesor asistente Loke. "Entonces, esto nos ahorra una cantidad sustancial de energía".

"Además, se logró una precisión de vanguardia del 89% en el cumplimiento desafiante de las tareas de aprendizaje actuales sin almacenar datos, que es aproximadamente dos veces mayor que la de los modelos tradicionales de aprendizaje continuo, así como una alta eficiencia energética". ", agregó.

Para permitir que el modelo procese información sobre el terreno en el mundo real de forma independiente, el equipo planea expandir la capacidad ajustable del modelo en la próxima fase de su investigación.

"Basada en demostraciones a pequeña escala, esta investigación aún se encuentra en sus primeras etapas", dijo el profesor asistente Loke. "Se espera que la adopción de este enfoque permita que los sistemas avanzados de IA progresen de forma independiente sin control humano". Una sinapsis artificial de energía ultrabaja para los sistemas de IA de próxima generación