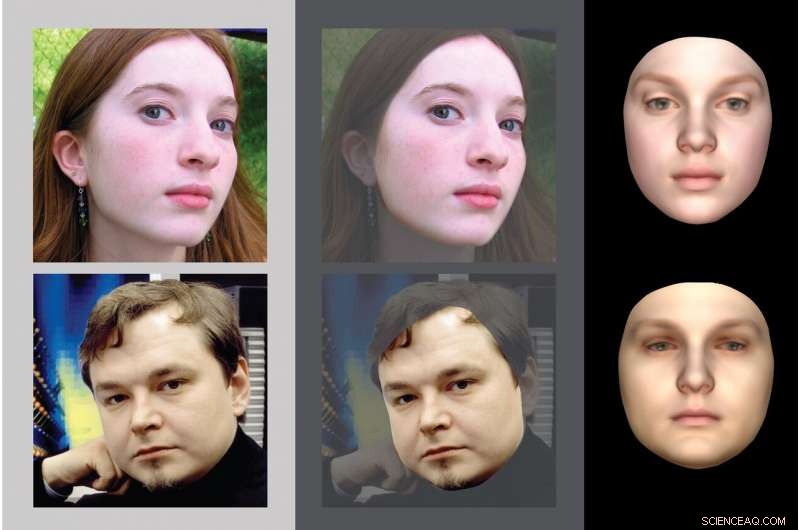

Los científicos cognitivos del MIT han desarrollado un modelo informático de reconocimiento facial que realiza una serie de cálculos que invierten los pasos que utilizaría un programa de gráficos por computadora para generar una representación 2D de un rostro. Los científicos cognitivos del MIT han desarrollado un modelo informático de reconocimiento facial que realiza una serie de cálculos que invierten los pasos que usaría un programa de gráficos por computadora para generar una representación 2D de una cara. Crédito:MIT

Cuando abrimos nuestros ojos inmediatamente vemos nuestro entorno con gran detalle. Cómo el cerebro es capaz de formar tan rápidamente estas representaciones ricamente detalladas del mundo es uno de los mayores acertijos sin resolver en el estudio de la visión.

Los científicos que estudian el cerebro han intentado replicar este fenómeno utilizando modelos de visión por computadora, pero hasta ahora, Los modelos líderes solo realizan tareas mucho más simples, como seleccionar un objeto o una cara sobre un fondo desordenado. Ahora, un equipo dirigido por científicos cognitivos del MIT ha producido un modelo informático que captura la capacidad del sistema visual humano para generar rápidamente una descripción detallada de la escena a partir de una imagen, y ofrece una idea de cómo el cerebro logra esto.

"Lo que estábamos tratando de hacer en este trabajo es explicar cómo la percepción puede ser mucho más rica que simplemente colocar etiquetas semánticas en partes de una imagen, y explorar la cuestión de cómo vemos todo el mundo físico, "dice Josh Tenenbaum, profesor de ciencia cognitiva computacional y miembro del Laboratorio de Ciencias de la Computación e Inteligencia Artificial del MIT (CSAIL) y del Centro de Cerebros, Mentes y Máquinas (CBMM).

El nuevo modelo postula que cuando el cerebro recibe información visual, realiza rápidamente una serie de cálculos que invierten los pasos que usaría un programa de gráficos por computadora para generar una representación bidimensional de una cara u otro objeto. Este tipo de modelo, conocidos como gráficos inversos eficientes (EIG), también se correlaciona bien con las grabaciones eléctricas de las regiones selectivas de rostros en los cerebros de primates no humanos, sugiriendo que el sistema visual de los primates puede estar organizado de la misma manera que el modelo de computadora, dicen los investigadores.

Ilker Yildirim, un ex postdoctorado del MIT que ahora es profesor asistente de psicología en la Universidad de Yale, es el autor principal del artículo, que aparece hoy en Avances de la ciencia . Tenenbaum y Winrich Freiwald, profesor de neurociencias y comportamiento en la Universidad Rockefeller, son los autores principales del estudio. Mario Belledonne, un estudiante de posgrado en Yale, también es autor.

Gráficos inversos

Décadas de investigación sobre el sistema visual del cerebro han estudiado, en gran detalle, cómo la entrada de luz en la retina se transforma en escenas cohesivas. Esta comprensión ha ayudado a los investigadores de inteligencia artificial a desarrollar modelos informáticos que pueden replicar aspectos de este sistema. como reconocer caras u otros objetos.

"La visión es el aspecto funcional del cerebro que mejor entendemos, en humanos y otros animales, "Dice Tenenbaum." Y la visión por computadora es una de las áreas más exitosas de la IA en este momento. Damos por sentado que las máquinas ahora pueden mirar imágenes y reconocer rostros muy bien, y detectar otros tipos de objetos ".

Sin embargo, incluso estos sofisticados sistemas de inteligencia artificial no se acercan a lo que puede hacer el sistema visual humano, Dice Yildirim.

"Nuestros cerebros no solo detectan que hay un objeto allí, o reconocer y poner una etiqueta en algo, ", dice." Vemos todas las formas, la geometría, las superficies, las texturas. Vemos un mundo muy rico ".

Hace más de un siglo, el Físico, físico, y el filósofo Hermann von Helmholtz teorizó que el cerebro crea estas ricas representaciones invirtiendo el proceso de formación de imágenes. Hizo la hipótesis de que el sistema visual incluye un generador de imágenes que se utilizaría, por ejemplo, para producir los rostros que vemos durante los sueños. Hacer funcionar este generador a la inversa permitiría al cerebro trabajar hacia atrás a partir de la imagen e inferir qué tipo de rostro u otro objeto produciría esa imagen. dicen los investigadores.

Sin embargo, la pregunta seguía siendo:¿Cómo podría el cerebro realizar este proceso, conocidos como gráficos inversos, ¿tan rapido? Los informáticos han intentado crear algoritmos que pudieran realizar esta hazaña, pero los mejores sistemas anteriores requieren muchos ciclos de procesamiento iterativo, tardando mucho más que los 100 a 200 milisegundos que el cerebro necesita para crear una representación visual detallada de lo que estás viendo. Los neurocientíficos creen que la percepción en el cerebro puede avanzar tan rápido porque se implementa en un paso en su mayoría feedforward a través de varias capas organizadas jerárquicamente de procesamiento neuronal.

El equipo dirigido por el MIT se propuso construir un tipo especial de modelo de red neuronal profunda para mostrar cómo una jerarquía neuronal puede inferir rápidamente las características subyacentes de una escena; en este caso, un rostro específico. En contraste con las redes neuronales profundas estándar utilizadas en la visión por computadora, que se entrenan a partir de datos etiquetados que indican la clase de un objeto en la imagen, La red de los investigadores se entrena a partir de un modelo que refleja las representaciones internas del cerebro de cómo pueden verse las escenas con caras.

Su modelo aprende así a invertir los pasos realizados por un programa de gráficos por computadora para generar caras. Estos programas gráficos comienzan con una representación tridimensional de una cara individual y luego la convierten en una imagen bidimensional, visto desde un punto de vista particular. Estas imágenes se pueden colocar en una imagen de fondo arbitraria. Los investigadores teorizan que el sistema visual del cerebro puede hacer algo similar cuando sueñas o conjuras una imagen mental de la cara de alguien.

Los investigadores entrenaron su red neuronal profunda para realizar estos pasos a la inversa, es decir, comienza con la imagen 2-D y luego agrega características como textura, curvatura, e iluminación, para crear lo que los investigadores llaman una representación "2.5D". Estas imágenes 2.5D especifican la forma y el color de la cara desde un punto de vista particular. A continuación, se convierten en representaciones en 3-D, que no dependen del punto de vista.

"El modelo ofrece una descripción a nivel de sistemas del procesamiento de rostros en el cerebro, permitiéndole ver una imagen y finalmente llegar a un objeto 3-D, que incluye representaciones de forma y textura, a través de esta importante etapa intermedia de una imagen 2.5D, "Dice Yildirim.

Rendimiento del modelo

Los investigadores encontraron que su modelo es consistente con los datos obtenidos al estudiar ciertas regiones en el cerebro de los monos macacos. En un estudio publicado en 2010, Freiwald y Doris Tsao de Caltech registraron la actividad de las neuronas en esas regiones y analizaron cómo respondían a 25 caras diferentes. visto desde siete puntos de vista diferentes. Ese estudio reveló tres etapas de procesamiento facial de alto nivel, que el equipo del MIT ahora hipotetiza corresponden a tres etapas de su modelo de gráficos inversos:aproximadamente, una etapa dependiente del punto de vista 2.5D; un escenario que pasa de 2.5 a 3-D; y un 3-D, etapa invariante del punto de vista de la representación del rostro.

"Lo que mostramos es que las propiedades de respuesta tanto cuantitativas como cualitativas de esos tres niveles del cerebro parecen encajar notablemente bien con los tres niveles superiores de la red que hemos construido, "Dice Tenenbaum.

Los investigadores también compararon el rendimiento del modelo con el de los humanos en una tarea que implica reconocer rostros desde diferentes puntos de vista. Esta tarea se vuelve más difícil cuando los investigadores alteran las caras eliminando la textura de la cara y preservando su forma. o distorsionar la forma conservando la textura relativa. El rendimiento del nuevo modelo fue mucho más similar al de los humanos que los modelos de computadora utilizados en el software de reconocimiento facial de última generación, evidencia adicional de que este modelo puede estar más cerca de imitar lo que sucede en el sistema visual humano.

Los investigadores ahora planean continuar probando el enfoque de modelado en imágenes adicionales, incluidos los objetos que no son rostros, para investigar si los gráficos inversos también podrían explicar cómo el cerebro percibe otros tipos de escenas. Además, creen que la adaptación de este enfoque a la visión por computadora podría conducir a sistemas de IA de mejor rendimiento.

"Si podemos mostrar evidencia de que estos modelos podrían corresponder a cómo funciona el cerebro, este trabajo podría llevar a los investigadores de visión por computadora a tomar más en serio e invertir más recursos de ingeniería en este enfoque de gráficos inversos para la percepción, "Dice Tenenbaum." El cerebro sigue siendo el estándar de oro para cualquier tipo de máquina que ve el mundo de forma rica y rápida ".