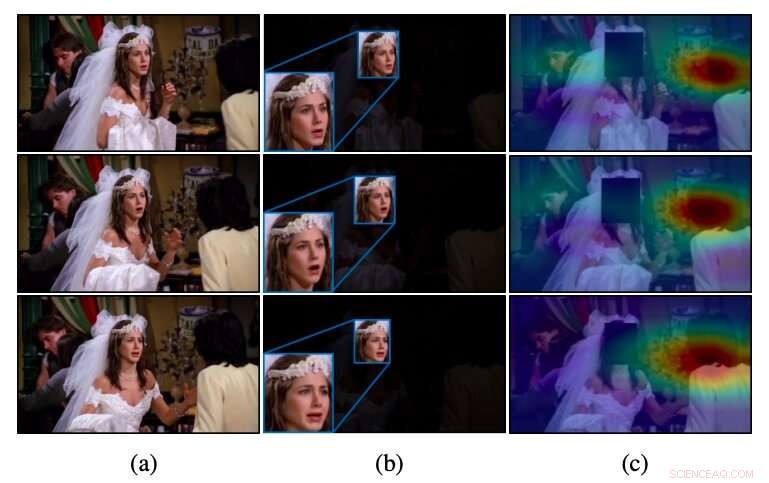

Intuición de CAER-Net para videos sin recortar, como en (a) métodos convencionales que aprovechan solo las regiones faciales, como en (b), a menudo no reconocen la emoción. A diferencia de estos métodos, CAER-Net se enfoca en regiones de contexto tanto presenciales como atentas, como se ve en (c). Crédito:Lee et al.

Un equipo de investigadores de la Universidad de Yonsei y la École Polytechnique Fédérale de Lausanne (EPFL) ha desarrollado recientemente una nueva técnica que puede reconocer emociones analizando los rostros de las personas en imágenes junto con características contextuales. Presentaron y describieron su arquitectura basada en el aprendizaje profundo, llamado CAER-Net, en un artículo publicado previamente en arXiv.

Por muchos años, investigadores de todo el mundo han intentado desarrollar herramientas para detectar automáticamente las emociones humanas mediante el análisis de imágenes, videos o clips de audio. Estas herramientas pueden tener numerosas aplicaciones, por ejemplo, mejorar las interacciones robot-humano o ayudar a los médicos a identificar signos de trastornos mentales o neurales (p. ej., , basado en patrones de habla atípicos, rasgos faciales, etc.).

Hasta aquí, la mayoría de técnicas para reconocer emociones en imágenes se han basado en el análisis de las expresiones faciales de las personas, esencialmente asumiendo que estas expresiones transmiten mejor las respuestas emocionales de los humanos. Como resultado, la mayoría de los conjuntos de datos para entrenar y evaluar herramientas de reconocimiento de emociones (p. ej., los conjuntos de datos AFEW y FER2013) solo contienen imágenes recortadas de rostros humanos.

Una limitación clave de las herramientas convencionales de reconocimiento de emociones es que no logran un rendimiento satisfactorio cuando las señales emocionales en los rostros de las personas son ambiguas o indistinguibles. En contraste con estos enfoques, Los seres humanos son capaces de reconocer las emociones de los demás basándose no solo en sus expresiones faciales, sino también en pistas contextuales (por ejemplo, las acciones que están realizando, sus interacciones con los demás, Dónde están, etc.).

Estudios anteriores sugieren que analizar tanto las expresiones faciales como las características relacionadas con el contexto puede mejorar significativamente el rendimiento de las herramientas de reconocimiento de emociones. Inspirado por estos hallazgos, Los investigadores de Yonsei y EPFL se propusieron desarrollar una arquitectura basada en el aprendizaje profundo que pueda reconocer las emociones de las personas en imágenes basadas tanto en sus expresiones faciales como en la información contextual.

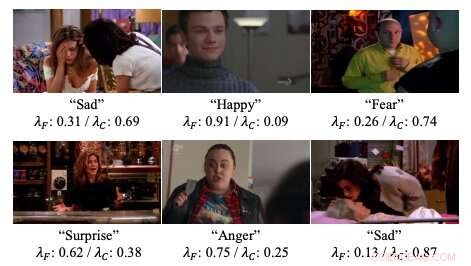

Ejemplos de pesos de atención en las redes neuronales desarrollados por los investigadores. Crédito:Lee et al.

"Presentamos redes profundas para el reconocimiento de emociones sensibles al contexto, llamado CAER-Net, que explotan no solo la expresión facial humana, sino también información de contexto, de forma conjunta y potenciadora, ", escribieron los investigadores en su artículo." La idea clave es ocultar rostros humanos en una escena visual y buscar otros contextos basados en un mecanismo de atención ".

CAER-Net, la arquitectura desarrollada por investigadores, se compone de dos subredes y codificadores clave que extraen por separado rasgos faciales y regiones contextuales en una imagen. Luego, estos dos tipos de características se combinan utilizando redes de fusión adaptativas y se analizan juntas para predecir las emociones de las personas en una imagen determinada.

Además de CAER-Net, los investigadores también introdujeron un nuevo conjunto de datos para el reconocimiento de emociones sensibles al contexto, al que se refieren como CAER. Las imágenes de este conjunto de datos representan los rostros de las personas y su entorno / contexto, por lo tanto, podría servir como un punto de referencia más eficaz para entrenar la evaluación de técnicas de reconocimiento de emociones.

Los investigadores evaluaron su técnica de reconocimiento de emociones en una serie de experimentos, utilizando tanto el conjunto de datos que compilaron como el conjunto de datos de AFEW. Sus hallazgos sugieren que analizar tanto las expresiones faciales como la información contextual puede mejorar considerablemente el rendimiento de las herramientas de reconocimiento de emociones. como lo indican estudios previos.

"Esperamos que los resultados de este estudio faciliten más avances en el reconocimiento de emociones sensibles al contexto y sus tareas relacionadas, "escribieron los investigadores.

© 2019 Science X Network