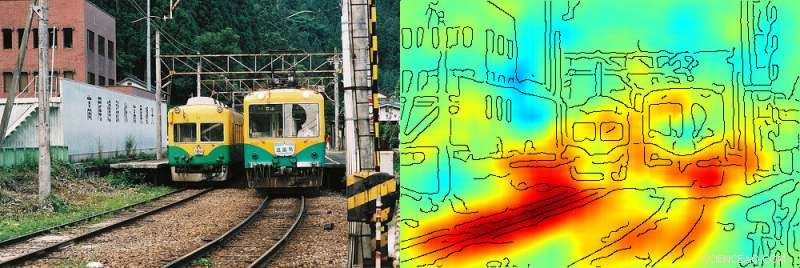

Aquí, el sistema de inteligencia artificial clasifica una imagen como un tren porque hay vías. Crédito:Fraunhofer HHI

La inteligencia artificial (IA) ya está firmemente arraigada en nuestra vida cotidiana y está conquistando cada vez más territorio. Por ejemplo, los asistentes de voz ya son un elemento cotidiano en los teléfonos inteligentes de muchas personas, coches y casas. El progreso en el campo de la IA se basa principalmente en el uso de redes neuronales. Imitando la funcionalidad del cerebro humano, Las redes neuronales vinculan unidades definidas matemáticamente entre sí. Pero en el pasado no se sabía cómo toma decisiones una red neuronal. Investigadores del Instituto Fraunhofer de Telecomunicaciones, Instituto Heinrich Hertz, HHI y Technische Universität Berlin han desarrollado una tecnología que revela los criterios que utilizan los sistemas de IA al tomar decisiones. El innovador método de análisis de relevancia espectral (SpRAy) basado en la tecnología de propagación de relevancia por capas proporciona un primer vistazo dentro de la "caja negra".

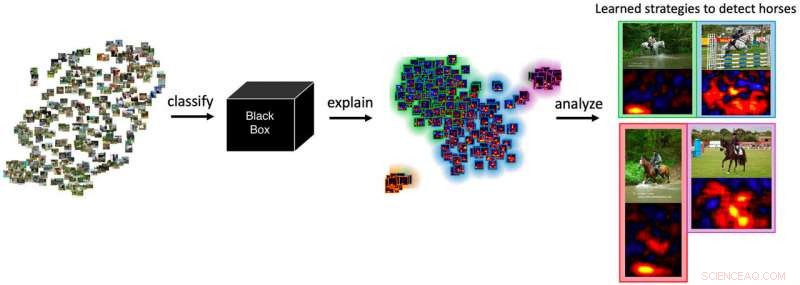

Hoy en día es casi imposible encontrar un área en la que la inteligencia artificial sea irrelevante, ya sea en la fabricación, publicidad o comunicaciones. Muchas empresas utilizan sistemas de inteligencia artificial en red y de aprendizaje, por ejemplo, para generar pronósticos de demanda precisos y predecir exactamente el comportamiento del cliente. Este enfoque también se puede utilizar para ajustar los procesos logísticos regionales. El sector sanitario también utiliza actividades específicas de IA, como la generación de pronósticos sobre la base de datos estructurados. Esto juega un papel, por ejemplo, en el reconocimiento de imágenes:las imágenes de rayos X se ingresan en un sistema de inteligencia artificial que luego genera un diagnóstico. La detección adecuada del contenido de la imagen también es crucial para la conducción autónoma. donde las señales de tráfico, árboles, Los peatones y ciclistas deben identificarse con total precisión. Y este es el quid de la cuestión:los sistemas de inteligencia artificial deben proporcionar estrategias de resolución de problemas absolutamente confiables en áreas de aplicación sensibles, como diagnósticos médicos y en áreas críticas para la seguridad. Sin embargo, en el pasado, no estaba del todo claro cómo los sistemas de IA toman decisiones. Es más, las predicciones dependen de la calidad de los datos de entrada. Investigadores del Instituto Fraunhofer de Telecomunicaciones, Instituto Heinrich Hertz, HHI y Technische Universität Berlin ahora han desarrollado una tecnología, Propagación de relevancia por capas (LRP), lo que hace que los pronósticos de IA sean explicables y, al hacerlo, revela estrategias de solución de problemas poco confiables. Un mayor desarrollo de la tecnología LRP, denominado Análisis de relevancia espectral (SpRAy), identifica y cuantifica un amplio espectro de comportamientos de toma de decisiones aprendidos y, por lo tanto, identifica decisiones indeseables incluso en enormes conjuntos de datos.

IA transparente

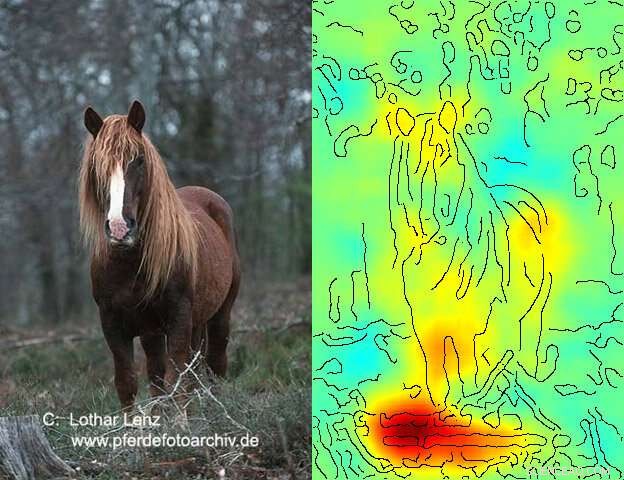

Aquí, el sistema de IA asigna la imagen a la categoría correcta según el banner de derechos de autor. Sin embargo, la estrategia de solución es defectuosa. Crédito:Fraunhofer HHI

En la práctica, la tecnología identifica los elementos de entrada individuales que se han utilizado para hacer una predicción. Así, por ejemplo, cuando se introduce una imagen de una muestra de tejido en un sistema de IA, la influencia de cada píxel individual se cuantifica en los resultados de la clasificación. En otras palabras, además de predecir qué tan "maligno" o "benigno" es el tejido de la imagen, el sistema también proporciona información sobre la base de esta clasificación. "No solo se supone que el resultado es correcto, la estrategia de solución también lo es. En el pasado, Los sistemas de inteligencia artificial se han tratado como cajas negras. Se confiaba en que los sistemas hicieran las cosas correctas. Con nuestro software de código abierto, que utiliza la propagación de relevancia por capas, Hemos logrado que el proceso de búsqueda de soluciones de los sistemas de IA sea transparente, "dice el Dr. Wojciech Samek, Jefe del grupo de investigación "Machine Learning" en Fraunhofer HHI. "Estamos usando LRP para visualizar e interpretar redes neuronales y otros modelos de aprendizaje automático. Usamos LRP para medir la influencia de cada variable de entrada en la predicción general y analizar las decisiones tomadas por los clasificadores, "añade el Dr. Klaus-Rob-ert Müller, Profesor de Machine Learning en TU Berlin.

Estrategias de solución poco fiables

Confiar en los resultados de las redes neuronales significa necesariamente comprender cómo funcionan. Según las pruebas del equipo de investigación, Los sistemas de IA no siempre aplican las mejores estrategias para llegar a una solución. Por ejemplo, un conocido sistema de inteligencia artificial clasifica las imágenes según el contexto. Asignó fotografías a la categoría "Barco" cuando se veía una gran cantidad de agua en la imagen. No estaba resolviendo la tarea real de reconocer imágenes de barcos, incluso si en la mayoría de los casos eligió las fotos correctas. "Muchos algoritmos de IA utilizan estrategias poco fiables y llegan a soluciones muy poco prácticas, "dice Samek, resumiendo los resultados de las investigaciones.

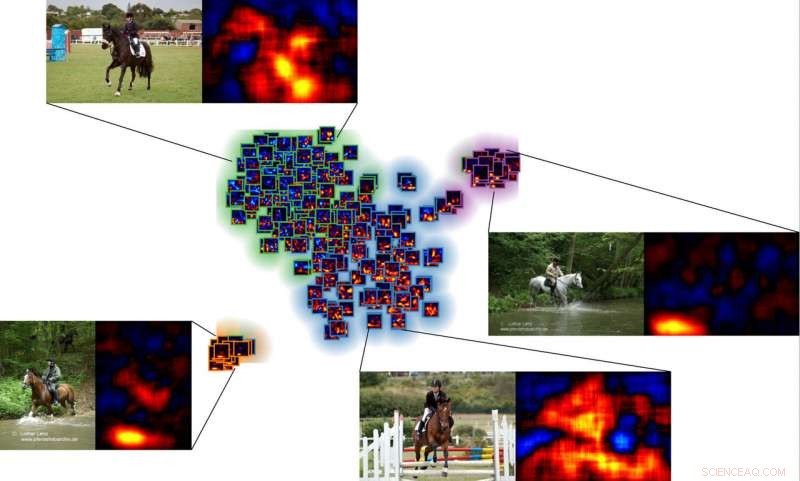

La nueva tecnología de análisis de relevancia espectral hace visibles los criterios utilizados por los sistemas de inteligencia artificial al tomar decisiones. Crédito:Fraunhofer HHI

Ver pensar a las redes neuronales

La tecnología LRP decodifica la funcionalidad de las redes neuronales y descubre qué rasgos característicos se utilizan, por ejemplo, para identificar un caballo como un caballo y no como un burro o una vaca. Identifica la información que fluye a través del sistema en cada nodo de la red. Esto hace posible investigar incluso redes neuronales muy profundas.

Los equipos de investigación de Fraunhofer HHI y TU Berlin están formulando actualmente nuevos algoritmos para la investigación de más preguntas con el fin de hacer que los sistemas de IA sean aún más fiables y robustos. Los socios del proyecto han publicado sus resultados de investigación en la revista Comunicaciones de la naturaleza .

La propagación de relevancia por capas proporciona una mirada dentro de la "caja negra". Crédito:Fraunhofer HHI

AI, aprendizaje automático y más

La inteligencia artificial se ocupa del desarrollo de sistemas que pueden resolver problemas de forma independiente y actuar de manera análoga a los patrones de pensamiento y comportamiento humanos. En la actualidad, los mayores avances se están logrando en el área del aprendizaje automático, un subcampo de IA. El aprendizaje automático se ocupa de métodos para extraer conocimiento de datos y contextos de aprendizaje independientes contenidos en los datos. El progreso es resultado del uso de redes neuronales artificiales basadas en conexiones entre unidades de cálculo matemático que en principio imitan la estructura neuronal del cerebro humano. Un subcampo del aprendizaje automático, aprendizaje profundo, cubre una clase de nuevos procedimientos que permiten enseñar y entrenar redes neuronales artificiales complejas. Estas redes constan de una gran cantidad de niveles que están vinculados entre sí en estructuras de muchas capas.