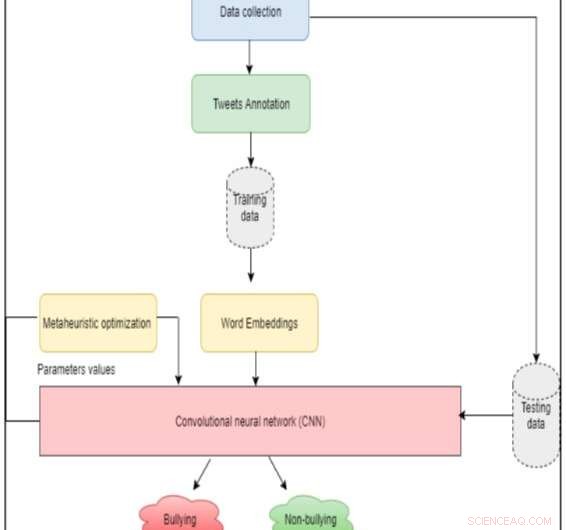

La arquitectura del sistema. Crédito:Al-Ajlan &Ykhlef.

Investigadores de la Universidad King Saud, en Arabia Saudita, han desarrollado un nuevo enfoque para detectar el ciberacoso en Twitter mediante el aprendizaje profundo llamado OCDD. A diferencia de otros enfoques de aprendizaje profundo, que extraen características de los tweets y las envían a un clasificador, su método representa un tweet como un conjunto de vectores de palabras.

En años recientes, El ciberacoso en las redes sociales se ha convertido en un tema enorme y ampliamente discutido. El ciberacoso implica el uso de canales de comunicación online para intimidar a otros usuarios enviando mensajes intimidantes, mensajes amenazantes o abusivos. Esto puede tener consecuencias psicológicas y, a veces, potencialmente mortales para las víctimas.

Investigadores de todo el mundo han intentado desarrollar nuevas formas de detectar el ciberacoso, gestionarlo y reducir su prevalencia en las redes sociales. Muchos enfoques de aprendizaje profundo para identificar el trabajo de acoso cibernético mediante el análisis de características textuales y de usuario. Sin embargo, estas técnicas tienen varias limitaciones, lo que puede reducir significativamente su rendimiento.

Por ejemplo, algunos de estos enfoques intentan mejorar la detección mediante la introducción de nuevas funciones. Sin embargo, aumentar el número de características puede complicar las fases de extracción y selección de características. Es más, estos enfoques no consideran que algunos datos del usuario, como la edad y la fecha de nacimiento, se puede fabricar fácilmente. Para abordar las limitaciones de los métodos de detección de ciberacoso existentes, Monirah A. Al-Ajlan y Mourad Ykhlef, dos investigadores de la Universidad King Saud, propuso un nuevo enfoque llamado detección optimizada del ciberacoso en Twitter (OCDD).

"A diferencia del trabajo anterior en este campo, OCDD no extrae características de los tweets y las envía a un clasificador:más bien, representa un tweet como un conjunto de vectores de palabras, "explican los investigadores en su artículo, publicado en IEEE Explore y presentado en el 21 S t Conferencia Nacional de Computación de la Sociedad de Computación de Arabia Saudita (NCC). "De este modo, se conserva la semántica de las palabras, y se pueden eliminar las fases de extracción y selección de características ".

Al-Ajlan e Ykhlef construyeron su enfoque en datos de entrenamiento etiquetados y generaron incrustaciones de palabras para palabras individuales usando GloVe, un algoritmo de aprendizaje no supervisado que puede obtener representaciones vectoriales de palabras. Estas incrustaciones de palabras luego se envían a una red neuronal convolucional (CNN) para detectar si podrían estar asociadas con el acoso cibernético.

Los algoritmos de CNN suelen constar de una capa de entrada y salida, así como varias otras capas. La configuración manual de parámetros para cada una de estas capas puede ser una tarea desafiante y que requiere mucho tiempo. Por lo tanto, los investigadores decidieron incorporar un algoritmo de optimización metaheurística en su modelo, lo que puede facilitar este proceso identificando valores óptimos o casi óptimos que se utilizarán para la clasificación.

"OCDD avanza el estado actual de la detección del acoso cibernético al eliminar la difícil tarea de extracción / selección de características y reemplazarla con vectores de palabras que capturan la semántica de las palabras y CNN que clasifica los tweets de una manera más inteligente que los algoritmos de clasificación tradicionales, "escriben los investigadores en su artículo.

Cuando se prueba en tareas de minería de texto, OCDD obtuvo resultados muy prometedores. Sin embargo, aún no se ha implementado y evaluado dentro de los contextos de detección del ciberacoso. Los investigadores ahora planean adaptar su enfoque para que también pueda analizar texto en árabe.

© 2019 Science X Network