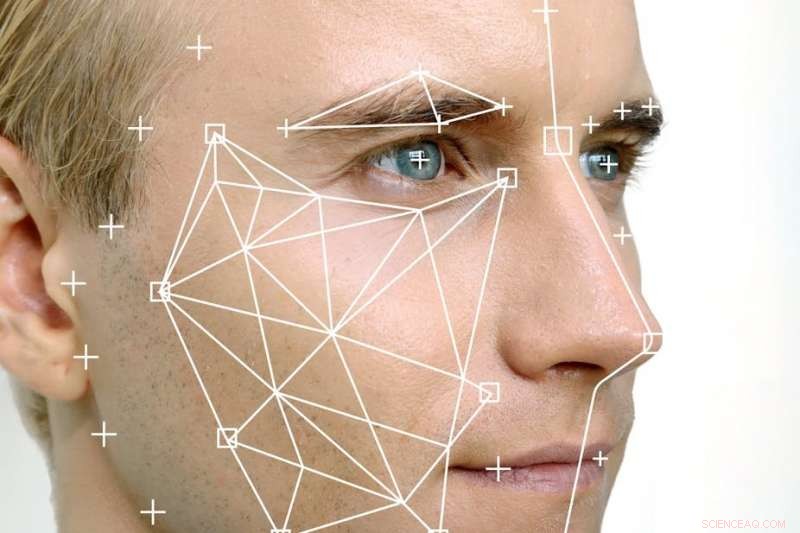

Hay muchas preguntas sobre cómo la tecnología de reconocimiento facial puede afectar los derechos de privacidad de las personas y si empeorará la discriminación en las prácticas policiales. Crédito:Shutterstock

El uso de la tecnología de reconocimiento facial automatizado (FRT) se está volviendo más común a nivel mundial, en particular en China, el Reino Unido y ahora Australia.

FRT significa que podemos identificar a las personas en función de un análisis de sus rasgos faciales geométricos, hacer una comparación entre un algoritmo creado a partir de la imagen capturada y uno ya almacenado, como una licencia de conducir, imagen de custodia o cuenta de redes sociales.

FRT tiene numerosas aplicaciones del sector público y privado cuando se necesita verificación de identidad. Estos incluyen el acceso a un área segura, desbloquear un dispositivo móvil o abordar un avión. También es capaz de reconocer el estado de ánimo de las personas reacciones y, aparentemente, sexualidad.

Y es más valioso para la vigilancia que las cámaras CCTV comunes, ya que puede identificar a las personas en tiempo real y vincularlas a las imágenes almacenadas. Esto es de inmenso valor para el estado en las investigaciones penales, operaciones antiterroristas y control de fronteras.

Cómo afecta el derecho a la privacidad

Pero el despliegue de FRT, que ya está siendo utilizado por las AFP y las fuerzas policiales estatales y por empresas privadas en otros lugares (aeropuertos, recintos deportivos, bancos y centros comerciales), está poco regulado y se basa en algoritmos cuestionables que no son transparentes públicamente.

Esta tecnología tiene importantes implicaciones para los derechos de privacidad de las personas, y su uso puede empeorar los prejuicios y la discriminación existentes en las prácticas policiales.

El uso de FRT atenta contra los derechos de privacidad al crear un algoritmo de características personales únicas. Esto, a su vez, reduce las características de las personas a datos y permite su seguimiento y vigilancia. Estos datos e imágenes también se almacenarán durante un cierto período de tiempo, abriendo la posibilidad de piratear o defraudar.

Además, FRT puede exponer a las personas a una posible discriminación de dos maneras. Primero, Las agencias estatales pueden hacer un mal uso de las tecnologías en relación con ciertos grupos demográficos, ya sea intencionalmente o de otra manera.

Y en segundo lugar, La investigación indica que las minorías étnicas, Las personas de color y las mujeres son identificadas erróneamente por FRT en tasas más altas que el resto de la población. Esta inexactitud puede llevar a que los miembros de ciertos grupos sean sometidos a medidas policiales o de seguridad de mano dura y que sus datos se retengan de manera inapropiada.

Esto es particularmente relevante en relación con las comunidades que ya son blanco de manera desproporcionada en Australia.

Lo que los legisladores están tratando de hacer

El Parlamento ha elaborado un proyecto de ley en un esfuerzo por regular este espacio, pero deja mucho que desear. El proyecto de ley se encuentra actualmente en segunda lectura; no se ha fijado una fecha para la votación.

Si pasa, el proyecto de ley permitiría el intercambio de información de identidad entre el gobierno de la Commonwealth, gobiernos estatales y territoriales y "entidades no gubernamentales" (que no se han especificado) mediante la creación de un eje central llamado "La capacidad", así como la Solución Nacional de Reconocimiento Facial de Licencias de Conducir, una base de datos de información contenida en documentos de identidad gubernamentales, como licencias de conducir.

El proyecto de ley también autorizaría al Departamento del Interior a cobrar, usar y compartir información de identificación en relación con una variedad de actividades, como la prevención del fraude, cumplimiento de la ley, seguridad comunitaria, y seguridad vial.

Sería muy preferible que dicha legislación permitiera compartir la identidad solo para una gama limitada de delitos graves. Como esta escrito, este proyecto de ley se refiere a personas que no han sido condenadas por ningún delito penal, y De hecho, no es necesario que se sospeche de ningún delito.

También, el pueblo australiano no ha dado su consentimiento para que sus datos se compartan de esta manera. Este intercambio tendría un efecto desproporcionado en nuestro derecho a la privacidad.

En tono rimbombante, la violación del derecho a la privacidad se ve agravada por el hecho de que el proyecto de ley permitiría al sector privado acceder a los servicios de búsqueda de identidades. Aunque el sector privado ya utiliza tecnologías de comparación y verificación de imágenes hasta cierto punto, como los bancos que buscan detectar el blanqueo de capitales, por ejemplo, el proyecto de ley ampliaría esto. El proyecto de ley no proporciona suficientes garantías o sanciones para las entidades privadas si utilizan el centro o los datos de las personas de manera inapropiada.

La prevalencia de falsos positivos en coincidencias de identidad

En un sentido práctico, También existen preocupaciones sobre la confiabilidad y precisión de FRT, que se está desarrollando rápidamente pero no está exento de problemas importantes. Queda por ver si estos problemas son solo errores o una característica de FRT.

La experiencia del Reino Unido ilustra claramente estos problemas. Policía de Gales del Sur, el líder nacional británico en tecnología de reconocimiento facial, utilizó el sistema desarrollado por una empresa australiana privada llamada Neoface en 18 reuniones públicas entre mayo de 2017 y marzo de 2018. Se encontró que el 91% de las coincidencias, o 2, 451 instancias, identificó incorrectamente a miembros inocentes del público como incluidos en una lista de vigilancia. La supervisión manual del programa reveló que las coincidencias eran falsos positivos.

La Policía Metropolitana de Londres también está ejecutando un piloto de FRT. Registró cifras algo mejores, pero todavía tenía una tasa de identificación de falsos negativos del 30% en el Carnaval de Notting Hill y del 22% en el Día del Recuerdo, ambos en 2017.

También es importante destacar el papel central de las empresas privadas en el desarrollo de esta tecnología. Los algoritmos FRT están patentados, y no hay ninguna indicación públicamente disponible de la medida o estándar que representa una identidad "coincidente".

Legislar en un movimiento rápido, el espacio impulsado por la tecnología no es una tarea envidiable. Existe cierto beneficio en cierto grado de flexibilidad en las definiciones y reglas legales para que la ley no se vuelva estática y redundante demasiado pronto. Pero incluso la interpretación más generosa del proyecto de ley admitiría que es una forma defectuosa de regular el uso de una tecnología poderosa y problemática que llegó para quedarse. te guste o no.

Este artículo se ha vuelto a publicar de The Conversation con una licencia de Creative Commons. Lea el artículo original.