Procesos por mensajes ofensivos. Crédito:Basado en cifras obtenidas del Ministerio de Justicia, Autor proporcionado

Facebook ha puesto a disposición por primera vez datos sobre la escala de comentarios abusivos publicados en su sitio. Esto puede haber sido hecho bajo la creciente presión de las organizaciones para que las empresas de redes sociales sean más transparentes sobre el abuso en línea. o para ganar credibilidad después del escándalo de datos de Cambridge Analytica. De cualquier manera, las cifras no hacen que la lectura sea placentera.

En un período de seis meses desde octubre de 2017 hasta marzo de 20178, 21 millones de imágenes sexualmente explícitas, Se eliminaron de su sitio 3,5 millones de publicaciones gráficamente violentas y 2,5 millones de formas de incitación al odio. Estas cifras ayudan a revelar algunos puntos llamativos.

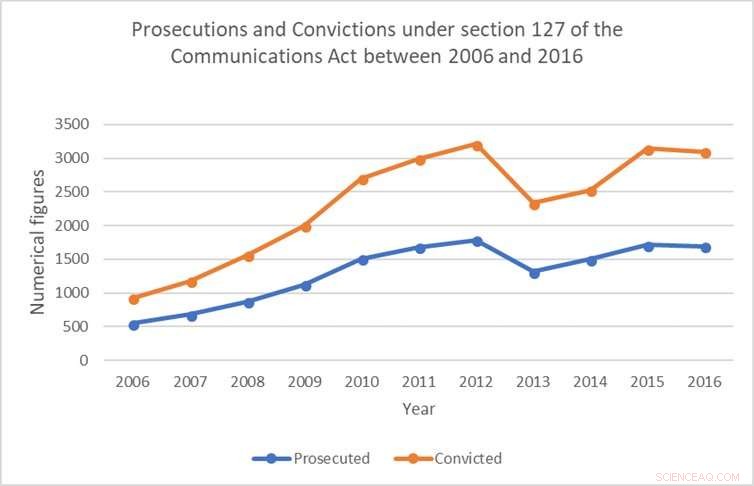

Como se esperaba, los datos indican que el problema está empeorando. Por ejemplo, entre enero y marzo se estimó que por cada 10, 000 mensajes en línea, entre 22 y 27 contenían violencia gráfica, de 16 a 19 en los tres meses anteriores. Esto pone de relieve el hecho de que en el Reino Unido, han disminuido los enjuiciamientos por abuso en línea, como se muestra en el gráfico siguiente.

Sin embargo, lo que Facebook no nos ha dicho es igualmente significativo.

La red social ha estado bajo una creciente presión para combatir el abuso en su sitio, en particular, la eliminación de la propaganda terrorista después de eventos como el ataque de Westminster de 2017 y el atentado de Manchester Arena. Aquí, la empresa ha sido proactiva. Entre enero y marzo de 2018, Facebook eliminó 1,9 millones de mensajes que alentaban la propaganda terrorista, un aumento de 800, 000 comentarios en comparación con los tres meses anteriores. Un total del 99,5% de estos mensajes se localizaron con la ayuda de tecnología avanzada.

A primera vista, Parece que Facebook ha desarrollado con éxito un software que puede eliminar este contenido de su servidor. Pero Facebook no ha publicado cifras que muestren la prevalencia de la propaganda terrorista en su sitio. Así que realmente no sabemos qué tan exitoso es el software a este respecto.

Eliminar publicaciones violentas

Facebook también ha utilizado la tecnología para ayudar a eliminar la violencia gráfica de su sitio. Entre los dos períodos de tres meses hubo un aumento del 183% en la cantidad de publicaciones eliminadas que fueron etiquetadas gráficamente como violentas. Un total de 86% de estos comentarios fueron marcados por un sistema informático.

Pero también sabemos que las cifras de Facebook también muestran que hasta 27 de cada 10, 000 comentarios que superaron la tecnología de detección contenían violencia gráfica. Eso no suena como muchos, pero vale la pena considerar la gran cantidad de comentarios totales publicados en el sitio por sus más de 2 mil millones de usuarios activos. Una estimación sugiere que 510, Cada minuto se publican 000 comentarios. Si es exacto, eso significaría 1, 982, Cada 24 horas se publican 880 comentarios violentos.

Para compensar las fallas en su software de detección, Facebook, como otras redes sociales, ha confiado durante años en la autorregulación, animando a los usuarios a informar de los comentarios que creen que no deberían estar en el sitio. Por ejemplo, entre enero y marzo de 2018, Facebook eliminó 2,5 millones de comentarios que se consideraron incitación al odio pero solo 950, 000 (38%) de estos mensajes habían sido marcados por su sistema. El otro 62% fue informado por los usuarios. Esto muestra que la tecnología de Facebook no combate adecuadamente el discurso de odio en su red. a pesar de la creciente preocupación de que los sitios de redes sociales están alimentando los delitos de odio en el mundo real.

¿Cuántos comentarios se reportan?

Esto nos lleva a la otra cifra significativa no incluida en los datos publicados por Facebook:el número total de comentarios reportados por los usuarios. Dado que se trata de un mecanismo fundamental para abordar el abuso en línea, la cantidad de informes presentados a la empresa debe ponerse a disposición del público. Esto nos permitirá comprender el alcance total de los comentarios abusivos realizados en línea. mientras deja en claro el número total de mensajes que Facebook no elimina del sitio.

La decisión de Facebook de publicar datos que exponen la escala del abuso en su sitio es un importante paso adelante. Gorjeo, por el contrario, se le pidió información similar pero se negó a divulgarla, alegar que sería engañoso. Claramente, no todos los comentarios marcados por usuarios de sitios de redes sociales violarán sus términos y condiciones. Pero el hecho de que Twitter no divulgara esta información sugiere que la compañía no está dispuesta a revelar la magnitud del abuso en su propio sitio.

Sin embargo, incluso Facebook aún tiene un largo camino por recorrer para lograr una transparencia total. Idealmente, todos los sitios de redes sociales publicarán informes anuales sobre cómo están abordando el abuso en línea. Esto permitiría a los reguladores y al público hacer que las empresas rindan cuentas de manera más directa por las fallas para eliminar el abuso en línea de sus servidores.

Este artículo se publicó originalmente en The Conversation. Lea el artículo original.