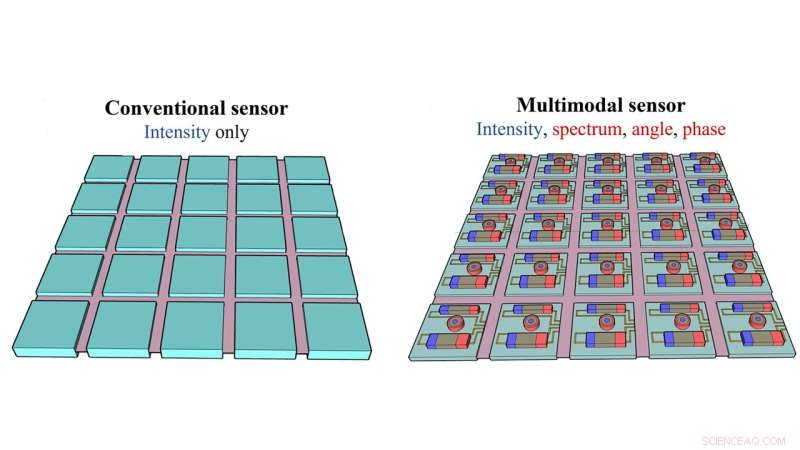

Los esquemas de (a) un sensor convencional que puede detectar solo la intensidad de la luz y (b) un sensor multimodal nanoestructurado, que puede detectar varias calidades de luz a través de las interacciones luz-materia en una escala de sublongitud de onda. Crédito:Yurui Qu y Soongyu Yi

Los sensores de imagen miden la intensidad de la luz, pero también se deben extraer el ángulo, el espectro y otros aspectos de la luz para avanzar significativamente en la visión artificial.

En Letras de Física Aplicada , investigadores de la Universidad de Wisconsin-Madison, la Universidad de Washington en St. Louis y OmniVision Technologies destacan los últimos componentes nanoestructurados integrados en chips sensores de imagen que tienen más probabilidades de tener el mayor impacto en imágenes multimodales.

Los desarrollos podrían permitir que los vehículos autónomos vean alrededor de las esquinas en lugar de solo en línea recta, imágenes biomédicas para detectar anomalías en diferentes profundidades de tejido y telescopios para ver a través del polvo interestelar.

"Los sensores de imagen experimentarán una transición gradual para convertirse en los ojos artificiales ideales de las máquinas", dijo el coautor Yurui Qu, de la Universidad de Wisconsin-Madison. "Es probable que una evolución que aproveche el notable logro de los sensores de imágenes existentes genere impactos más inmediatos".

Los sensores de imagen, que convierten la luz en señales eléctricas, están compuestos por millones de píxeles en un solo chip. El desafío es cómo combinar y miniaturizar componentes multifuncionales como parte del sensor.

En su propio trabajo, los investigadores detallaron un enfoque prometedor para detectar espectros de múltiples bandas mediante la fabricación de un espectrómetro en chip. Depositaron filtros de cristal fotónico formados por silicio directamente encima de los píxeles para crear interacciones complejas entre la luz incidente y el sensor.

Los píxeles debajo de las películas registran la distribución de la energía de la luz, a partir de la cual se puede deducir la información espectral de la luz. El dispositivo, de menos de una centésima de pulgada cuadrada de tamaño, es programable para cumplir con varios rangos dinámicos, niveles de resolución y casi cualquier régimen espectral, desde visible hasta infrarrojo.

Los investigadores construyeron un componente que detecta información angular para medir la profundidad y construir formas 3D a escalas subcelulares. Su trabajo se inspiró en los sensores auditivos direccionales que se encuentran en animales, como los geckos, cuyas cabezas son demasiado pequeñas para determinar de dónde proviene el sonido de la misma manera que los humanos y otros animales. En su lugar, utilizan tímpanos acoplados para medir la dirección del sonido dentro de un tamaño que es mucho más pequeño que la longitud de onda acústica correspondiente.

De manera similar, se construyeron pares de nanocables de silicio como resonadores para soportar la resonancia óptica. La energía óptica almacenada en dos resonadores es sensible al ángulo de incidencia. El cable más cercano a la luz envía la corriente más fuerte. Al comparar las corrientes más fuertes y más débiles de ambos cables, se puede determinar el ángulo de las ondas de luz entrantes.

Millones de estos nanocables se pueden colocar en un chip de 1 milímetro cuadrado. La investigación podría respaldar los avances en cámaras sin lentes, realidad aumentada y visión robótica.

El artículo "Conjuntos de píxeles sensibles a la luz multimodales" está escrito por Yurui Qu, Soongyu Yi, Lan Yang y Zongfu Yu. El artículo aparecerá en Applied Physics Letters el 26 de julio de 2022. + Explora más