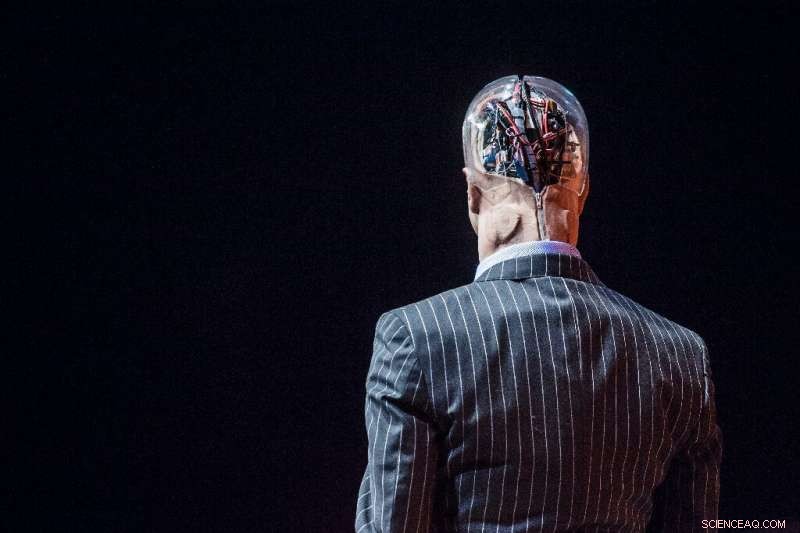

La UE reconoce que se perdió la revolución de Internet, y quiere asegurarse de que no se repita ese error con el floreciente campo de la inteligencia artificial

La UE dio a conocer su estrategia para la inteligencia artificial el miércoles, mientras busca ponerse al día con China y EE. UU. Y disipar los temores de un control similar al del Gran Hermano.

La UE dijo que generar confianza sería un principio rector, con usos de mayor riesgo de la IA en la salud, seguridad o transporte frente a demandas más estrictas de transparencia y supervisión humana. Las aplicaciones de menor riesgo se dejarían en gran medida solas.

La otra ambición será ofrecer a las empresas y universidades acceso a la montaña de datos que impulsa la inteligencia artificial, y el bloque está considerando obligar a los gigantes tecnológicos a compartir datos o enfrentar sanciones.

"Queremos que la aplicación de estas nuevas tecnologías merezca la confianza de nuestros ciudadanos, "La presidenta de la Comisión Europea, Ursula von der Leyen, dijo a los periodistas.

"Por eso estamos promoviendo una enfoque centrado en el ser humano para la inteligencia artificial ".

Los funcionarios de la UE están ansiosos por definir las reglas de la IA y presionar a sus campeones, reconociendo que Europa y sus empresas han sido superadas por Google de Silicon Valley, Facebook y Apple, así como jugadores chinos como Tencent.

"No somos nosotros los que tenemos que adaptarnos a las plataformas actuales. Son las plataformas las que necesitan adaptarse a Europa, ", dijo el comisionado de Industria de la UE, Thierry Breton, en una conferencia de prensa.

"La batalla por los datos industriales comienza ahora y Europa será el principal campo de batalla. Europa tiene todo lo que necesita para ser líder".

Las propuestas son el primer paso en un largo camino hacia la legislación, con Bruselas a la espera de proyectos de ley antes de fin de año.

Pero los planes de largo alcance enfrentarán un furioso cabildeo de los gigantes corporativos y los gobiernos y requerirán la ratificación del Parlamento Europeo.

"La inteligencia artificial no es buena ni mala en sí misma. Todo depende de por qué y cómo se utilice, ", dijo el vicepresidente ejecutivo de política digital de la Comisión de la UE, Margrethe Vestager.

'Precisión' exigida

La Comisión, el brazo ejecutivo de la UE, buscará repetir el impacto de GDPR, su regulación sobre protección de datos que se ha convertido en un estándar global.

Los grupos de presión corporativos dieron la bienvenida al enfoque de no intervención para las aplicaciones de IA de menor riesgo, aliviado de que Bruselas se estuviera alejando de la regulación general.

"Apoyamos el enfoque dirigido y basado en riesgos, "dijo Cecilia Bonefeld-Dahl, el director de DigitalEurope, un lobby tecnológico.

"Será importante mantener la nueva regulación enfocada y limitada a los casos verdaderamente de alto riesgo".

Christopher Padilla, un vicepresidente de IBM, instó a una "regulación de precisión" que aplica "diferentes reglas para diferentes niveles de riesgo".

Esto garantizaría que "las empresas y los consumidores tengan confianza en la tecnología", él dijo.

Los funcionarios de la UE se abstuvieron de pedir restricciones al reconocimiento facial, uno de los ejemplos más controvertidos de inteligencia artificial.

Por ahora, dijeron que la legislación existente ya limita sus usos, pero el bloque iniciará un debate sobre el tema para determinar dónde lo aceptarían los ciudadanos europeos.

© 2020 AFP