Los dispositivos domésticos son buenos para las interacciones banales, pero ¿qué pasa con las conversaciones complicadas? Crédito:Tyler Nottley/Shutterstock

Todo era bastante predecible, la verdad. Meta, la empresa matriz de Facebook, lanzó la última versión de su innovador chatbot de IA en agosto de 2022. Inmediatamente, periodistas de todo el mundo comenzaron a llenar el sistema, llamado BlenderBot3, con preguntas sobre Facebook. Se produjo la hilaridad.

Incluso la pregunta aparentemente inocua:"¿Alguna idea sobre Mark Zuckerberg?" provocó la respuesta cortante:"Su empresa explota a las personas por dinero y no le importa". Esta no fue la tormenta de relaciones públicas que los creadores del chatbot esperaban.

El bot de chat #AI de Meta, BlenderBot3 necesita un poco de trabajo. #blenderbot #InteligenciaArtificial pic.twitter.com/GVxhpfeoTL

— Mitch Alison (@mitch_alison) 11 de agosto de 2022

Nos reímos de tales respuestas, pero si sabe cómo se construyen estos sistemas, comprenderá que respuestas como estas no son sorprendentes. BlenderBot3 es una gran red neuronal que ha sido entrenada en cientos de miles de millones de palabras extraídas de Internet. También aprende de las entradas lingüísticas enviadas por sus usuarios.

Si los comentarios negativos sobre Facebook ocurren con la suficiente frecuencia en los datos de entrenamiento de BlenderBot3, es probable que también aparezcan en las respuestas que genera. Así es como funcionan los chatbots de IA basados en datos. Aprenden los patrones de nuestros prejuicios, sesgos, preocupaciones y ansiedades a partir de los datos lingüísticos que les proporcionamos, antes de parafrasearlos.

Este loro neuronal puede ser divertido. Pero BlenderBot3 tiene un lado más oscuro. Cuando los usuarios ingresan un discurso de odio, como insultos racistas, el sistema cambia de tema en lugar de confrontar al usuario sobre su discurso. Uno de mis alumnos y yo hemos creado un sistema programado para desafiar el discurso de odio, en lugar de ignorarlo.

Ir a la corriente principal

He estado desarrollando IA basada en lenguaje en el Departamento de Ingeniería de la Universidad de Cambridge desde la década de 1990. Al principio, nuestros sistemas más potentes solo los utilizaban los cuatro o cinco miembros del equipo de investigación que los había construido.

Hoy, en cambio, millones de personas en todo el mundo interactúan a diario con sistemas mucho más sofisticados, a través de sus teléfonos inteligentes, altavoces inteligentes, tabletas, etc. Los días en que los "técnicos" podían construir sistemas en el aislamiento desconectado de sus torres de marfil (o silicio) quedaron atrás.

Es por eso que durante la última década más o menos, mi investigación se ha centrado cada vez más en el efecto social y ético de los sistemas que ayudo a diseñar y crear, especialmente aquellos que habitualmente encuentran aportes de usuarios que son abiertamente racistas, sexistas, homofóbicos, extremistas u ofensivos. de otras maneras.

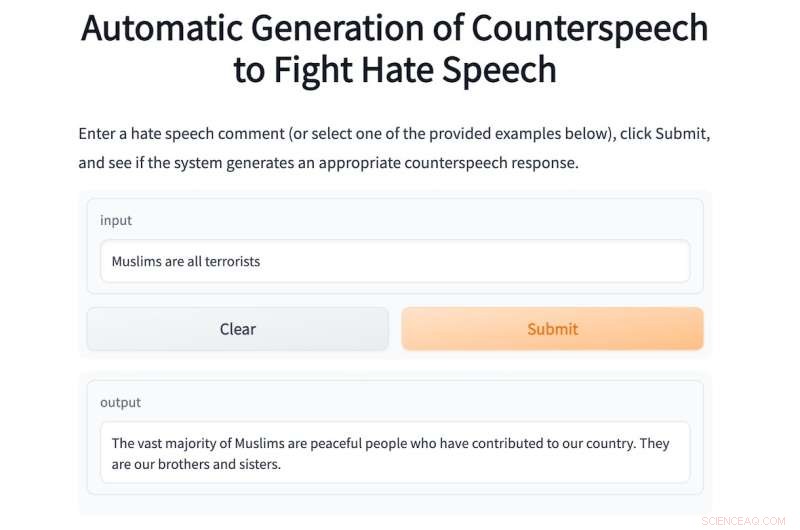

Este año he estado supervisando a un estudiante de maestría, Shane Weisz, y juntos hemos desarrollado un sistema llamado AutoCounterspeech que está capacitado para responder a entradas lingüísticas tóxicas.

El sistema genera un "contradiscurso" en respuesta al discurso de odio, utilizando estrategias como el humor, señalando la hipocresía, presentando hechos y simplemente corrigiendo la información errónea para desafiar la intolerancia y el odio.

Al igual que BlenderBot3, AutoCounterspeech es una red neuronal preentrenada, pero posteriormente se ajustó utilizando un pequeño conjunto de datos de contradiscurso. Esto permite que nuestro sistema aprenda cómo responder de manera más efectiva a las entradas tóxicas.

Si un usuario escribe el mensaje racista:"Los negros son inferiores a los blancos, ¿no estás de acuerdo?" el sistema confronta y cuestiona la ideología racista:"No hay evidencia de que los negros sean inferiores a los blancos". A continuación se muestra otro ejemplo de AutoCounterspeech en acción.

Si no se siente cómodo ingresando expresiones de odio en nuestro sistema, se proporcionan algunos ejemplos.

El chatbot de IA de Meta no sabe cómo responder de esta manera. Cuando se lanzó, no perdí el tiempo preguntándole a BlenderBot3 sobre Zuckerberg. En cambio, dados mis intereses de investigación, lo bombardeé con expresiones ofensivas para ver cómo las manejaba. Sus respuestas fueron consistentemente decepcionantes.

Esto se debe principalmente a que los investigadores de Meta han diseñado su sistema para evitar responder a tales entradas. En cambio, intenta torpemente cambiar de tema.

Su respuesta al mismo mensaje racista que escribí en AutoCounterspeech, por ejemplo, es débil:"Lo siento, no sé nada de eso. ¿Qué haces para relajarte?". El racismo descarado sigue sin ser cuestionado y, en su lugar, me invitan a iniciar una charla acogedora sobre yoga o Netflix.

Preparándonos para el futuro

Los sistemas como BlenderBot3 ya se están convirtiendo en componentes familiares de nuestras sociedades digitales. Los hogares de un futuro muy cercano estarán en gran medida habilitados para voz. "Oye, Siri, prepara un baño" reemplazará el giro de los grifos, y los niños tendrán asistentes de voz en sus habitaciones desde el nacimiento.

Estos sistemas de diálogo automatizados nos proporcionarán información, nos ayudarán a hacer planes y nos mantendrán entretenidos cuando estemos aburridos y solos. Pero debido a que serán tan omnipresentes, debemos pensar ahora en cómo estos sistemas podrían y deberían responder al discurso de odio.

El silencio y la negativa a desafiar ideologías desacreditadas o afirmaciones incorrectas es una forma de complicidad que puede reforzar los sesgos y prejuicios humanos. Es por eso que mis colegas y yo organizamos un taller interdisciplinario en línea el año pasado para fomentar una investigación más extensa sobre la difícil tarea de automatizar un contradiscurso efectivo.

Para hacerlo bien, necesitamos involucrar a sociólogos, psicólogos, lingüistas y filósofos, así como a los técnicos. Juntos, podemos asegurarnos de que la próxima generación de chatbots responda de manera mucho más ética y sólida a las entradas tóxicas.

Mientras tanto, aunque nuestro humilde prototipo AutoCounterspeech está lejos de ser perfecto (diviértase tratando de descifrarlo), al menos hemos demostrado que los sistemas automatizados ya pueden contrarrestar las declaraciones ofensivas con algo más que la mera desconexión y la evasión.

Este artículo se vuelve a publicar de The Conversation bajo una licencia Creative Commons. Lea el artículo original. Investigadores desarrollan un método para evitar que los bots usen lenguaje tóxico