Brendan Bena presentando su trabajo en una conferencia. Crédito:UC Colorado Springs.

Durante las ultimas décadas, Los investigadores han desarrollado herramientas de inteligencia artificial (IA) y técnicas computacionales cada vez más avanzadas que se pueden aplicar en una variedad de entornos. Entre estos, las técnicas que pueden generar lenguaje escrito o hablado han atraído una atención considerable, particularmente con la introducción de nuevos asistentes de voz, robots y nuevos dispositivos interactivos.

Investigadores de la Universidad de Colorado (UC) - Colorado Springs y la Universidad de Drury han desarrollado recientemente un sistema de generación de lenguaje único que puede producir versos de poesía creativos. Su sistema, presentado en un artículo publicado previamente en arXiv, es una adaptación perfeccionada de GPT-2, un modelo de lenguaje pre-entrenado desarrollado por OpenAI.

Jugal Kalita, el profesor de UC Colorado Springs que supervisa el estudio reciente, ha realizado investigaciones sobre la generación del lenguaje natural durante los últimos 30 años, a partir de sus días de posgrado en la Universidad de Pensilvania. Su primer artículo sobre la generación del lenguaje natural, publicado en 1988, tenía como objetivo producir párrafos de texto que pudieran aparecer en una revista típica, siguiendo un conjunto básico de reglas. Más recientemente, inspirado en los avances en las redes neuronales artificiales para el procesamiento del lenguaje natural (NLP), El profesor Kalita y sus alumnos comenzaron a desarrollar técnicas de aprendizaje profundo para la generación de artículos cortos, diálogos y escritura creativa.

"La idea de investigar el tema de la generación automática de poesía surgió a principios del verano de 2019, cuando Brendan Bena, un pasante de investigación de verano en la Universidad de Colorado, Colorado Springs, de la Universidad Drury de Missouri, mostró interés en generar automáticamente letras de canciones, "El profesor Kalita dijo a TechXplore." Originalmente quería buscar la creación de un sistema que intentara imitar las emociones provocadas a través de las letras de las canciones ".

Como la mayoría de las letras de las canciones están protegidas por derechos de autor, Encontrar grandes conjuntos de datos para entrenar modelos de aprendizaje profundo en la generación de letras puede ser un gran desafío. Bena y el profesor Kalita decidieron desarrollar una herramienta de aprendizaje profundo para la generación de poesía. Sin embargo, en lugar de centrarse en características como la estructura o el ritmo de la poesía, como la mayoría de los estudios de generación de poesía anteriores, exploraron sus aspectos más emocionales y creativos.

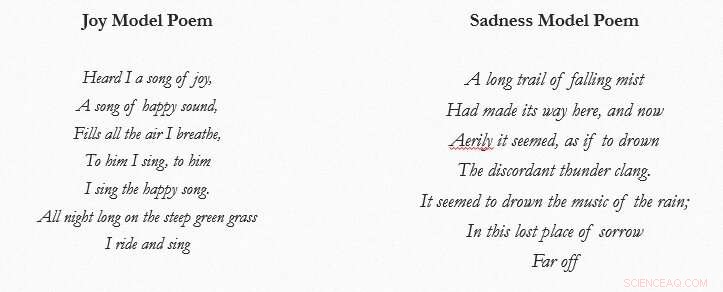

Ejemplos de la poesía que evoca emociones producidas por el sistema de generación del lenguaje de los investigadores. Crédito:Bena y Kalita.

"Después de darse cuenta de que había una parte mucho mayor de la investigación, así como datos, en el campo de la generación de poesía, cambiamos nuestro enfoque a este tema en particular, "Bena dijo a TechXplore." El trabajo se basó en gran medida en la tarea general de generación de texto que vino con mucha investigación previa. Sin embargo, a diferencia de los esfuerzos anteriores, deseamos centrarnos más en el contenido, emoción y creatividad del texto, a diferencia de la estructura o el ritmo que se encuentra en los estudios anteriores de generación de poesía ".

Para desarrollar su sistema de generación de poesía, Bena y el Prof. Kalita primero reunieron un gran corpus de texto de las bases de datos del Proyecto Gutenberg y UC-Santa Cruz Dreambank. Examinaron la base de datos de Gutenberg en busca de palabras incluidas en EmoLex, un conjunto de datos de léxico de emociones desarrollado por el Consejo Nacional de Investigación de Canadá.

Luego, los investigadores dividieron el conjunto de datos resultante en diferentes categorías de emociones, "mirando la cantidad de palabras EmoLex contenidas en cada extracto, y usó estos datos para entrenar una red neuronal profunda. El modelo que entrenaron es una adaptación de GPT-2, una arquitectura que aprende a generar nuevos fragmentos de texto modelando el estilo del lenguaje utilizado en los datos sobre los que se entrena.

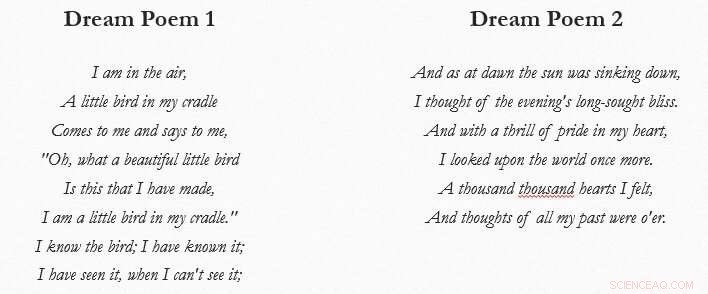

"También alimentamos nuestra red neuronal artificial con una combinación de datos de sueños y poesía para crear lo que se conoce como 'poesía de sueños' '", Explicó Bena." Al final, teníamos cinco modelos de emoción separados para las emociones de alegría, tristeza, confianza, ira y anticipación, pero también teníamos un modelo de poesía onírica. Este sistema, como se dijo anteriormente, se centra menos en la estructura que se encuentra en una gran cantidad de obras de generación de poesía y más en un estilo de poesía de verso libre que busca imitar y reproducir la delicadeza y creatividad de los poetas reales ".

Los investigadores pidieron a los usuarios humanos que evaluaran los poemas creados por su sistema, al mismo tiempo que emplea la herramienta Coh-Metrix para evaluar la calidad de los versos que generó. Descubrieron que producía poemas que efectivamente provocaban tristeza y alegría el 87,5% y el 85% de las veces, respectivamente. Además, cuando se entrena tanto en datos de sueños como en poesía, su sistema generó versos de poesía únicos 'oníricos' que capturaron elementos de lo que se conoce como 'poesía onírica' con una puntuación de 3,2 en la escala Likert.

Ejemplos de poesía onírica producidos por el sistema de generación del lenguaje de los investigadores. Crédito:Bena y Kalita.

"Nuestros hallazgos sugieren que el texto puede, De hecho, generarse de modo que provoque emoción en los lectores y que pueda parecerse a los tipos de creatividad que los artistas buscan inyectar en su trabajo, Bena dijo. "Creemos que nuestra investigación es un trabajo novedoso en el campo de la generación de poesía creativa y esperamos que nuestro estudio abra la puerta a futuros trabajos en esta área".

Bena y el profesor Kalita se encuentran entre los primeros en demostrar destellos iniciales de creatividad mecánica en la generación de poesía. En sus próximos estudios, los investigadores planean mejorar la calidad de los poemas compuestos por su sistema, al mismo tiempo que aplican su enfoque a la creación de poesía en otros idiomas.

"Si seleccionamos un poco más los datos de entrenamiento, Creemos que una arquitectura de red neuronal podría capturar mejor las emociones y los aspectos oníricos de la poesía que buscamos crear. "Bena dijo." De hecho, mientras que el diccionario EmoLex es un conjunto de datos muy útil, su vocabulario no explica todo el inglés de estilo antiguo que se encuentra en algunas de las poesías de Gutenberg ".

En el futuro, los investigadores esperan replicar su experimento centrándose en léxicos a nivel de frase o segmento, ya que esto podría permitirles capturar dependencias en texto basado en emociones de manera más efectiva. Su estudio también podría repetirse utilizando una arquitectura basada en redes neuronales más sofisticada, lo que puede mejorar la calidad de la poesía producida tanto en términos de gramática como de estructura de la oración.

Como Bena y el profesor Kalita ya han utilizado su sistema para producir versos de poesía onírica, eventualmente también podrían aplicarlo a otros estilos creativos, como borrar la poesía. La poesía de borrado se produce tomando palabras específicas o al azar de un texto existente y luego usándolas para formar nuevos versos.

"Finalmente, también estamos trabajando en la generación de poesía en varios idiomas diferentes utilizando el aprendizaje por transferencia, "Dijo el profesor Kalita." Por ejemplo, Shaun Tucker, un estudiante de maestría en UC-Colorado Springs ha estado generando poesía en varios idiomas indoeuropeos utilizando el modelo GPT-2 pre-entrenado de OpenAI. Hasta aquí, hemos generado poemas en ingles, Español, Ucranio, Hindi, Bengalí y asamés y descubrió que el modelo generativo de aprendizaje profundo GPT-2, que ha sido previamente entrenado con una gran cantidad de texto en inglés, Se puede entrenar con prosa y poemas en todos estos lenguajes para generar poesía ".

© 2020 Science X Network