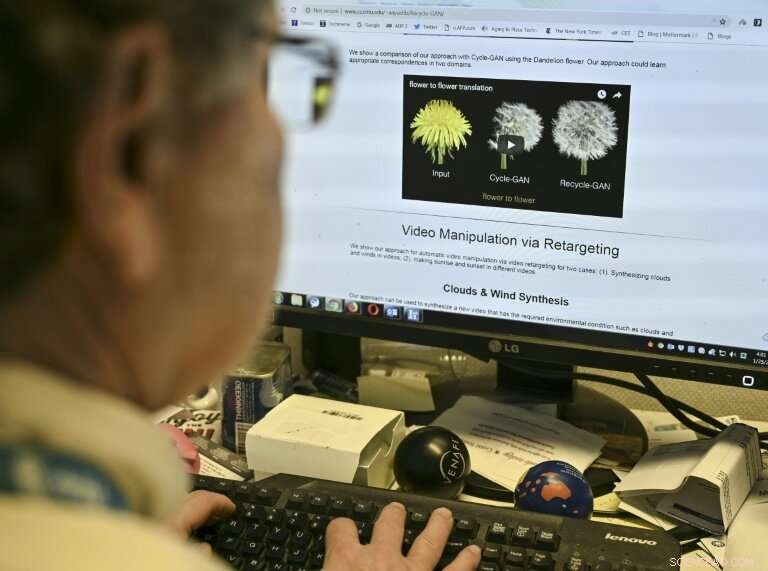

Paul Scharre, del Center for a New American Security, mira un video "deepfake" del expresidente estadounidense Barack Obama manipulado para mostrarle las palabras del actor Jordan Peele el 24 de enero. 2019, en Washington

Si ves un video de un político hablando palabras que nunca diría, o una estrella de Hollywood que aparece de manera improbable en una película barata para adultos, no ajuste su televisor, es posible que esté presenciando el futuro de las "noticias falsas".

Los videos "deepfake" que manipulan la realidad se están volviendo más sofisticados debido a los avances en inteligencia artificial, creando el potencial para nuevos tipos de desinformación con consecuencias devastadoras.

A medida que avanza la tecnología, Crecen las preocupaciones sobre cómo los piratas informáticos o los agentes estatales pueden utilizar los deepfakes con fines nefastos.

"Aún no estamos en la etapa en la que vemos deepfakes armados, pero ese momento se acerca, "Robert Chesney, un profesor de derecho de la Universidad de Texas que ha investigado el tema, dijo a la AFP.

Chesney argumenta que los deepfakes podrían sumarse a la confusión actual sobre la desinformación y las operaciones de influencia.

"Un deepfake o una serie de deepfakes en el momento oportuno y cuidadosamente redactado podrían dar pistas sobre una elección, desencadenar violencia en una ciudad preparada para disturbios civiles, reforzar las narrativas insurgentes sobre las supuestas atrocidades de un enemigo, o exacerbar las divisiones políticas en una sociedad, ", Dijeron Chesney y la profesora de la Universidad de Maryland, Danielle Citron, en una publicación de blog del Consejo de Relaciones Exteriores.

Paul Scharre, miembro senior del Center for a New American Security, un grupo de expertos especializado en inteligencia artificial y cuestiones de seguridad, dijo que era casi inevitable que se utilizaran deepfakes en las próximas elecciones.

La manipulación digital puede ser buena para Hollywood, pero las nuevas técnicas "deepfake" podrían crear un nuevo tipo de desinformación. según los investigadores

Se podría implementar un video falso para difamar a un candidato, Scharre dijo:o para permitir que las personas nieguen eventos reales capturados en videos auténticos.

Con videos falsos creíbles en circulación, él agregó, "las personas pueden optar por creer cualquier versión o narrativa que quieran, y eso es una preocupación real ".

¿El regreso de Chaplin?

La manipulación de video ha existido durante décadas y puede ser inocua o incluso entretenida, como en la aparición con ayuda digital de Peter Cushing en "Rogue One:A Star Wars Story, 2016". "22 años después de su muerte.

Los investigadores de la Universidad Carnegie Mellon revelaron el año pasado técnicas que facilitan la producción de deepfakes a través del aprendizaje automático para inferir datos faltantes.

En la industria del cine, "la esperanza es que podamos hacer que las viejas estrellas de cine como Charlie Chaplin regresen, "dijo Aayush Bansal.

Los expertos dicen que una forma importante de lidiar con los deepfakes es aumentar la conciencia pública, hacer que la gente sea más escéptica de lo que solía considerarse una prueba incontestable

La popularización de aplicaciones que hacen videos falsos realistas amenaza con socavar la noción de verdad en los medios de comunicación. juicios penales y muchas otras áreas, señalan los investigadores.

"Si podemos poner alguna palabra en la boca de alguien, eso da bastante miedo, "dice Siwei Lyu, profesor de informática en la Universidad Estatal de Nueva York en Albany, que está investigando la detección de deepfake.

"Desdibuja la línea entre lo que es verdadero y lo que es falso. Si realmente no podemos confiar en que la información sea auténtica, no es mejor que no tener ninguna información".

El representante Adam Schiff y otros dos legisladores enviaron recientemente una carta al director de Inteligencia Nacional, Dan Coats, solicitando información sobre lo que está haciendo el gobierno para combatir los deepfakes.

"Vídeos falsificados, Las imágenes o el audio podrían usarse para apuntar a individuos para chantajearlos o para otros propósitos nefastos, "escribieron los legisladores.

"De mayor preocupación por la seguridad nacional, también podrían ser utilizados por actores nacionales o extranjeros para difundir información errónea ".

Los productores de "Rogue One:A Star Wars Story, "Los actores Peter Cushing y Carrie Fisher recreados digitalmente después de su muerte con técnicas similares a las empleadas para los videos" deepfake "

Separando lo falso de lo real

Los investigadores han estado trabajando en mejores métodos de detección durante algún tiempo, con el apoyo de empresas privadas como Google y entidades gubernamentales como la Agencia de Proyectos de Investigación Avanzada de Defensa del Pentágono (DARPA), que inició una iniciativa de análisis forense de medios en 2015.

La investigación de Lyu se ha centrado en detectar falsificaciones, en parte analizando la tasa de parpadeo de los ojos de un individuo.

Pero reconoce que incluso detectar falsificaciones puede no ser suficiente, si un video se vuelve viral y conduce al caos.

"Es más importante interrumpir el proceso que analizar los videos, "Dijo Lyu.

Si bien los deepfakes han evolucionado durante varios años, el tema se enfocó con la creación en abril pasado de un video que parecía mostrar al ex presidente Barack Obama usando una palabrota para describir a su sucesor Donald Trump, un truco coordinado del cineasta Jordan Peele y BuzzFeed.

Un periodista de AFP ve un ejemplo de un video "deepfake" manipulado con inteligencia artificial, por investigadores de la Universidad Carnegie Mellon

También en 2018, una proliferación de videos porno de "intercambio de caras" que usaban imágenes de Emma Watson, Scarlett Johansson y otras celebridades provocaron prohibiciones de deepfakes por Reddit, Twitter y Pornhub, aunque no quedó claro si podrían hacer cumplir las políticas.

Scharre dijo que hay "una carrera armamentista entre quienes están creando estos videos y los investigadores de seguridad que están tratando de construir herramientas efectivas de detección".

But he said an important way to deal with deepfakes is to increase public awareness, making people more skeptical of what used to be considered incontrovertible proof.

"After a video has gone viral it may be too late for the social harm it has caused, " él dijo.

© 2019 AFP