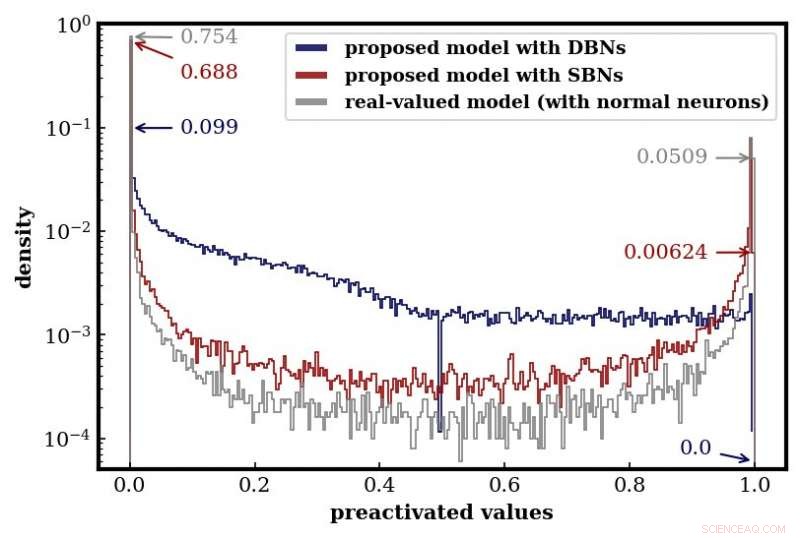

Salidas preactivadas (es decir, el valor real, valores intermedios justo antes de la operación de binarización; ver Sección 2.2) para el modelo propuesto implementado por MLP y capacitado con el objetivo WGAN-GP. Modelo propuesto con DBN (preactivado). Crédito:Dong y Yang.

Investigadores del Centro de Investigación para la Innovación de TI de la Academia Sinica, en Taiwan, Recientemente han desarrollado una nueva red generativa adversarial (GAN) que tiene neuronas binarias en la capa de salida del generador. Este modelo, presentado en un artículo prepublicado en arXiv, puede generar directamente predicciones con valores binarios en el momento de la prueba.

Hasta aquí, Los enfoques GAN han logrado resultados notables en el modelado de distribuciones continuas. Sin embargo, La aplicación de GAN a datos discretos ha sido algo desafiante hasta ahora, particularmente debido a las dificultades para optimizar la distribución del modelo hacia la distribución de datos objetivo en un espacio discreto de alta dimensión.

Hao-Wen Dong, uno de los investigadores que realizó el estudio, dicho Tech Xplore , "Actualmente estoy trabajando en la generación de música en el Laboratorio de Música e IA de la Academia Sinica. En mi opinión, componer se puede interpretar como una serie de decisiones, por ejemplo, en cuanto a la instrumentación, acordes e incluso las notas exactas a utilizar. Para avanzar hacia el logro de la gran visión de un compositor de IA sólido, Estoy particularmente interesado en saber si los modelos generativos profundos como las GAN son capaces de tomar decisiones. Por lo tanto, este trabajo examinó si podemos entrenar un GAN que usa neuronas binarias para tomar decisiones binarias usando retropropagación, el algoritmo de entrenamiento estándar ".

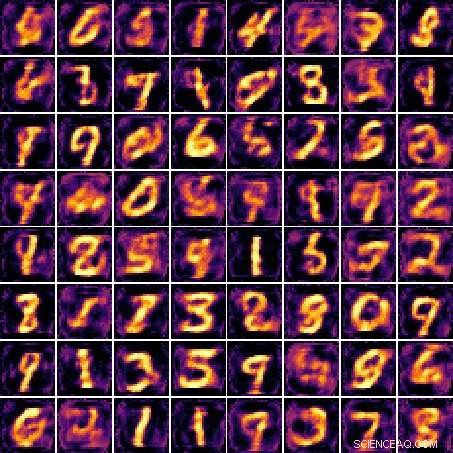

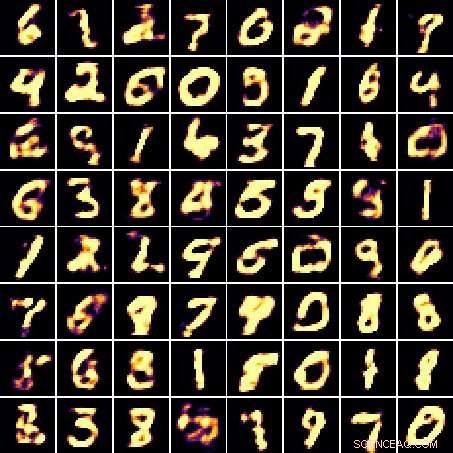

Dong y su asesor Yi-Hsuan Yang desarrollaron un modelo que puede generar directamente predicciones con valores binarios en el momento de la prueba. Luego lo usaron para generar dígitos MNIST binarizados y comparar el rendimiento de diferentes tipos de neuronas binarias, Objetivos de GAN y arquitecturas de red.

Muestra de dígitos generados y salidas preactivadas (es decir, el valor real, valores intermedios justo antes de la operación de binarización; ver Sección 2.2) para el modelo propuesto implementado por MLP y capacitado con el objetivo WGAN-GP. Modelo propuesto con SBN (preactivado). Crédito:Dong y Yang.

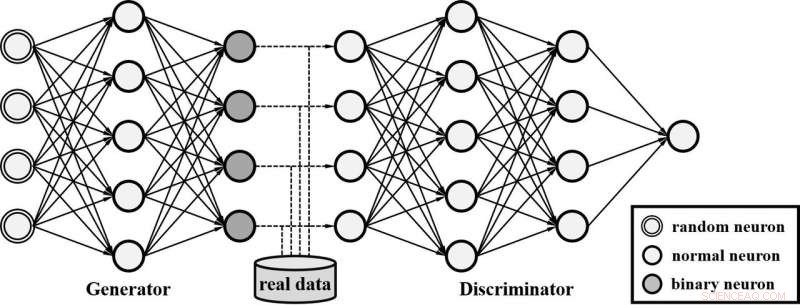

"En una palabra, BinaryGAN es una GAN que adopta neuronas binarias, neuronas que emiten un uno o un cero, en la capa de salida del generador, "Dijo Dong." Un GAN tiene dos componentes principales:el generador y el discriminador. El generador tiene como objetivo producir muestras de datos falsas que pueden engañar al discriminador para que clasifique las muestras generadas como reales. Por otra parte, el objetivo del discriminador es distinguir los datos falsos de los reales. La retroalimentación proporcionada por el discriminador se utiliza luego para mejorar el generador. Después del entrenamiento, el generador se puede utilizar para generar nuevas muestras de datos ".

Los investigadores pudieron entrenar eficazmente a BinaryGAN, su modelo generativo con neuronas binarias. Sus hallazgos también sugieren que el uso de estimadores de gradientes podría ser un enfoque prometedor para modelar distribuciones discretas con GAN.

Histogramas de las salidas preactivadas para el modelo propuesto y las predicciones probabilísticas para el modelo de valor real. Los dos modelos son implementados por MLP y entrenados con el objetivo WGAN-GP. Crédito:Dong y Yang.

"Con el uso de estimadores de gradiente, pudimos entrenar BinaryGAN, usando el algoritmo de retropropagación, "Dijo Dong." Además, la binarización adoptada en el modelo resultó en características distintas de las representaciones intermedias aprendidas por las redes neuronales profundas. Esto también enfatiza la importancia de incluir operaciones de binarización en el entrenamiento, para que estas operaciones de binarización también se puedan optimizar ".

Dong y Yang ahora buscan aplicar una GAN que adopte neuronas binarias para la realización de un gráfico de cálculo condicional. En este caso, algunos componentes se activarían y desactivarían, de acuerdo con las decisiones tomadas por las neuronas binarias de la red.

Diagrama del sistema del modelo propuesto implementado por MLP. Tenga en cuenta que las neuronas binarias solo se utilizan en la capa de salida del generador. Crédito:Dong y Yang.

"Esto es importante porque nos permite construir un modelo más complejo que se basa en decisiones tomadas en las primeras capas de la red, "Dijo Dong." Por ejemplo, podríamos construir un compositor de IA que aprenda a decidir primero la instrumentación y los acordes y luego componga en consecuencia ".

© 2018 Tech Xplore