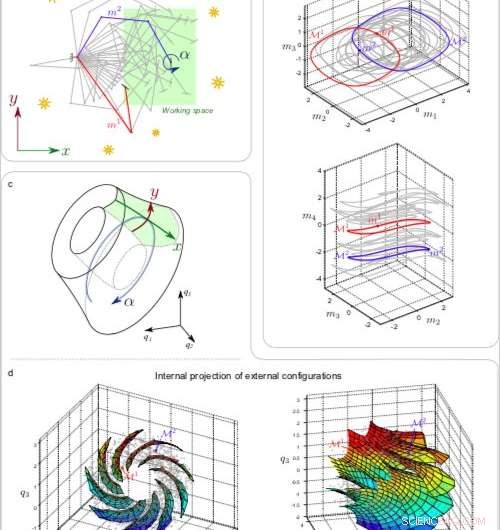

a) 1% de las 2500 configuraciones de brazo exploratorio mi. b) Dos proyecciones 3D del 1% de los conjuntos Mi incrustados en el espacio del motor 4D. c) Esquema del colector proyectado y captura de parámetros externos. d) Proyección en 3D de los 2500 colectores Mi (puntos grises) con superficies correspondientes a traslaciones en el espacio de trabajo para diferentes orientaciones retinianas. Crédito:Laflaquière et al.

Investigadores de Sorbonne Universités y CNRS han investigado recientemente los requisitos previos para la aparición de nociones espaciales simplificadas en sistemas robóticos. basado en el flujo sensoriomotor de un robot. Su estudio, prepublicado en arXiv, es parte de un proyecto más grande, en el que exploraron cómo las nociones perceptivas fundamentales (por ejemplo, cuerpo, espacio, objeto, color, etc.) se pueden instilar en sistemas biológicos o artificiales.

Hasta aquí, los diseños de los sistemas robóticos han reflejado principalmente la forma en que los seres humanos perciben el mundo. Diseñar robots guiados únicamente por la intuición humana, sin embargo, podría limitar sus percepciones a las experimentadas por los humanos.

Para diseñar robots totalmente autónomos, Por tanto, los investigadores podrían necesitar alejarse de los constructos relacionados con los humanos, permitiendo a los agentes robóticos desarrollar su propia forma de percibir el mundo. Según el equipo de investigadores de Sorbonne Universités y CNRS, un robot debe desarrollar gradualmente sus propias nociones perceptivas exclusivamente analizando sus experiencias sensoriomotoras e identificando patrones significativos.

"La hipótesis general es que nadie da nociones perceptivas a los organismos biológicos, "Alexander Terekhov, uno de los investigadores que realizó el estudio, dijo a TechXplore. "Estos conceptos se desarrollan con el tiempo, como herramientas útiles que les ayudan a dar sentido a los vastos datos sensoriomotores a los que están constantemente expuestos. Como consecuencia, La noción de espacio de una rana probablemente diferirá de la de un murciélago, que a su vez diferirá de la de los humanos. Entonces, al construir un robot, ¿Qué noción de espacio debemos darle? Probablemente ninguno de estos. Si queremos que los robots sean verdaderamente inteligentes, no debemos construirlos usando nociones abstractas, pero en vez, proporcionarles algoritmos que les permitan desarrollar esas nociones por sí mismos ".

Terekhov y sus colegas demostraron que la noción de espacio como independiente del entorno no puede deducirse solo mediante información exteroceptiva, ya que esta información varía mucho dependiendo de lo que se encuentre en el medio ambiente. Esta noción podría definirse mejor si se examinan las funciones que vinculan los comandos motores con los cambios en los estímulos externos al agente.

"Información importante provino de un antiguo estudio del famoso matemático francés Henri Poincaré, que estaba interesado en cómo las matemáticas en general y la geometría en particular podían surgir de la percepción humana, ", Dijo Terekhov." Él sugirió que la coincidencia en la entrada sensorial puede jugar un papel crucial ".

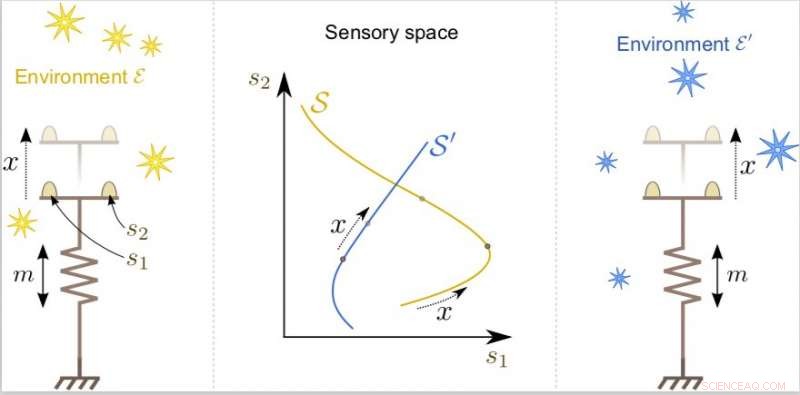

El agente puede mover sus sensores en el espacio externo usando su motor. Aunque la configuración del agente externo x puede ser la misma, su experiencia sensorial varía mucho según la estructura del entorno. Crédito:Laflaquière et al.

Las ideas introducidas por Poincaré se pueden explicar mejor con un ejemplo sencillo. Cuando miramos un objeto dado, los ojos capturan una imagen particular, que cambiará si el objeto se mueve 10 cm hacia la izquierda. Sin embargo, si nos movemos 10 cm a la izquierda, la imagen que vemos seguirá siendo casi exactamente la misma.

"Esta propiedad parece milagrosa si se piensa en cuántos receptores tiene el cuerpo humano, ", Dijo Terekhov." Es casi imposible tener la misma entrada dos veces en la vida, sin embargo, lo experimentamos constantemente. El cerebro puede utilizar estos eventos de baja probabilidad para construir nociones perceptivas generales ".

Para aplicar estas ideas al diseño de sistemas robóticos, los investigadores programaron un brazo robótico virtual con una cámara en la punta. El robot anotó las medidas provenientes de las articulaciones del brazo cada vez que recibió la misma información visual. "Al asociar todas estas medidas, el robot construye una abstracción que es matemáticamente equivalente a la posición y orientación de su cámara, aunque no tiene acceso explícito a esta información, ", Dijo Terekhov." Lo más importante es que, aunque esta noción abstracta se aprende sobre la base de la información visual, termina siendo independiente de ella, y por lo tanto funciona para todos los entornos; de la misma manera que nuestra noción de espacio no depende de la escena particular que vemos ".

Aplicando el mismo principio en otro estudio, los investigadores lograron que un robot compensara una distorsión óptica causada por una lente colocada frente a su cámara. Típicamente, esto se lograría mediante el entrenamiento de algoritmos en pares de imágenes distorsionadas y no distorsionadas.

"La parte complicada de nuestro estudio fue que el robot tenía que completar esta tarea mirando solo las imágenes distorsionadas, al igual que los humanos aprenden a compensar la distorsión introducida por los anteojos, ", Dijo Terekhov." Creemos que los principios introducidos por Poincaré, que son la base de nuestros algoritmos, podrían ser más generales y son utilizados por el cerebro en múltiples niveles. Actualmente estamos explorando la posibilidad de utilizar estos principios para construir redes neuronales que no sufran un olvido catastrófico y puedan acumular conocimiento gradualmente ".

© 2018 Tech Xplore