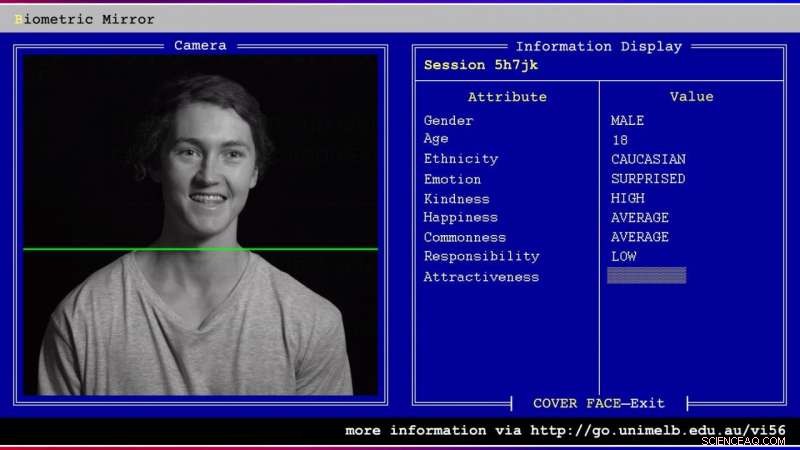

Biometric Mirror utiliza un conjunto de datos abierto de miles de imágenes faciales y evaluaciones de fuentes múltiples. Crédito:Sarah Fisher, Universidad de Melbourne

En una primicia mundial Los investigadores de la Universidad de Melbourne han diseñado un sistema de inteligencia artificial (IA) para detectar y mostrar los rasgos de personalidad y el atractivo físico de las personas basándose únicamente en una foto de su rostro.

El sistema, llamado Espejo Biométrico, investiga la comprensión de una persona sobre la IA y su respuesta a la información sobre sus rasgos únicos.

Cuando alguien se para frente al espejo biométrico, el sistema detecta una variedad de características faciales en segundos. Luego compara los datos del usuario con los de miles de fotos faciales, que fueron evaluados por su psicometría por un grupo de respondedores de fuentes múltiples.

El espejo biométrico muestra 14 características, de género, la edad y el origen étnico hasta el atractivo, rareza y estabilidad emocional. Cuanto más tiempo permanece una persona allí, cuanto más personales se vuelven los rasgos.

El proyecto de investigación, dirigido por el Dr. Niels Wouters del Center for Social Natural User Interfaces (SocialNUI) y Science Gallery Melbourne, explora las preocupaciones que plantea esta tecnología en torno al consentimiento, almacenamiento de datos y sesgo algorítmico.

"Con el auge de la IA y los macrodatos, el gobierno y las empresas utilizarán cada vez más cámaras CCTV y publicidad interactiva para detectar emociones, la edad, género y demografía de las personas que pasan, "Dijo el Dr. Wouters.

"Nuestro estudio tiene como objetivo provocar preguntas desafiantes sobre los límites de la IA. Muestra a los usuarios lo fácil que es implementar una IA que discrimina de formas poco éticas o problemáticas que podrían tener consecuencias sociales. Al fomentar el debate sobre la privacidad y la vigilancia masiva, esperamos contribuir a una mejor comprensión de la ética detrás de la IA ".

Biometric Mirror destaca las posibles consecuencias en el mundo real del sesgo y las suposiciones algorítmicas.

"Si bien recopilar información personal sobre sus preferencias de compra para personalizar un servicio individual puede parecer inofensivo, capturar esta información sin consentimiento hace que sea imposible saber si una predicción se basa en datos correctos, "Dijo el Dr. Wouters.

"El uso de la IA es una pendiente resbaladiza que se extiende más allá del ámbito de las compras y la publicidad. Imagínese no tener control sobre un algoritmo que lo considera erróneamente inadecuado para puestos de dirección, no elegible para títulos universitarios, o comparte tu foto públicamente sin tu consentimiento.

"Se elige uno de sus rasgos, digamos, su nivel de responsabilidad, y Biometric Mirror le pide que imagine que esta información ahora se está compartiendo con su aseguradora o futuro empleador, ", Dijo el Dr. Wouters." Este proyecto es una demostración transparente de las posibles consecuencias para las personas ".

El Dr. Wouters dijo que era importante tener en cuenta que Biometric Mirror no es una herramienta para el análisis psicológico.

"Biometric Mirror solo calcula la percepción pública estimada sobre la apariencia facial, " él dijo.

"Está limitado por su inexactitud, porque solo un conjunto de datos relativamente pequeño y de fuentes múltiples informó su diseño. Es inapropiado sacar conclusiones significativas sobre los estados psicológicos de Biometric Mirror ".