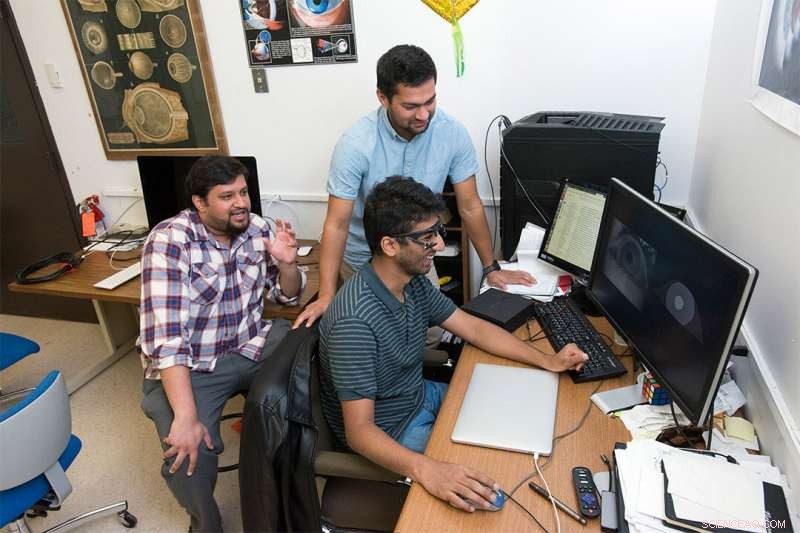

Un equipo de investigadores de RIT ganó el primer lugar en el OpenEDS Challenge de Facebook Research, una competencia internacional que impulsó a los investigadores a desarrollar soluciones de seguimiento ocular más efectivas. Rakshit Kothari de India (izquierda), Aayush Chaudhary de Nepal (al frente) y Manoj Acharya de Nepal (atrás) son Ph.D. estudiantes que encabezaron el proyecto. Crédito:A. Sue Weisler

Un equipo de investigadores del Instituto de Tecnología de Rochester se llevó el primer premio en un concurso internacional organizado por Facebook Research para desarrollar soluciones de seguimiento ocular más eficaces. El equipo, dirigido por tres Ph.D. estudiantes del Chester F. Carlson Center for Imaging Science, ganó el primer lugar en el OpenEDS Challenge centrado en la segmentación semántica.

Los productos de realidad virtual como Oculus VR se basan en el seguimiento ocular para crear experiencias inmersivas. El seguimiento ocular debe ser preciso, precisa y funciona todo el tiempo, para cada persona, en cualquier entorno.

"Actualmente, el seguimiento ocular se realiza detectando la pupila y ajustando un modelo bidimensional o tridimensional a los datos, "dijo Aayush Chaudhary, un doctorado en ciencias de la imagen. estudiante de Nepal y uno de los autores principales del artículo premiado. "El objetivo general del OpenEDS Challenge era separar el iris, pupila y esclerótica en imágenes del ojo para que los modelos 2-D y 3-D puedan adaptarse a un modelo compacto ".

Para ayudar a expandir las aplicaciones donde se puede utilizar el seguimiento ocular, Facebook Research lanzó el desafío de crear modelos informáticos robustos que puedan funcionar en tiempo real. Necesitaban que la solución ganadora fuera precisa, robusto y extremadamente eficiente en el consumo de energía.

"Cuando hablamos de realizar un seguimiento ocular en un dispositivo como su teléfono celular, necesitas modelos que sean pequeños, que puede ejecutarse en tiempo real, "dijo Rakshit Kothari, un doctorado en ciencias de la imagen. estudiante de la India. "Necesita poder sacar su teléfono celular y hacer que funcione de inmediato, sin mucho cálculo ".

Con el apoyo de sus asesores, tres doctorados en ciencias de la imagen. estudiantes — Kothari, Chaudhary, y Manoj Acharya de Nepal, dedicaron un mes de su tiempo de investigación a desarrollar la solución. Ejecutaron innumerables modelos en ese lapso, refinando continuamente su enfoque y avanzando en el desafío en el último día de competencia. Por el camino, superaron varios obstáculos imprevistos para construir un modelo práctico.

"Hay condiciones que nunca anticipamos que pueden surgir en estas imágenes, que nuestro modelo tuvo que cuidar inteligentemente, "dijo Acharya." Como ejemplo, si estuviera enseñando a este modelo cómo encontrar estas características usando imágenes en las que las personas no usan maquillaje en los ojos, y de repente alguien entra con mucha máscara de pestañas, eso podría deshacerse por completo. Necesita un modelo que sea lo suficientemente inteligente y lo suficientemente inteligente como para solucionarlo ".

El proyecto interdisciplinario requirió la colaboración de todos los laboratorios y universidades de RIT. Los tres autores principales colaboraron con coautores como Nitinraj Nair, un estudiante de posgrado en ciencias de la computación de la India, y Sushil Dangi, un doctorado en ciencias de la imagen. estudiante de Nepal. Trabajaron en estrecha colaboración con sus asesores:Frederick Wiedman, el profesor Jeff Pelz, Profesor asistente Gabriel Díaz, y el profesor asistente Christopher Kanan de la Facultad de Ciencias, y el profesor Reynold Bailey del Golisano College of Computing and Information Sciences.

Los investigadores trabajan en cuatro laboratorios RIT:el Laboratorio de Investigación de la Visión Multidisciplinaria (MVRL), el Laboratorio PerForM (Perception for Movement), el Laboratorio de Percepción de Máquinas y Neuromórficas (kLab) y el Laboratorio de Percepción Aplicada y Gráfica por Computador.

Los miembros del equipo presentarán su solución en el Taller OpenEDS de 2019:Eye Tracking para VR y AR en la Conferencia Internacional sobre Visión por Computadora (ICCV) en Seúl, Corea el 2 de noviembre.

El equipo ganó $ 5, 000 y donará el dinero del premio a la Beca Dotada Willem "Bill" Brouwer recientemente establecida para apoyar la investigación de estudiantes graduados en el Centro Chester F. Carlson para Ciencias de la Imagen.

Hay más información disponible en el sitio web de Facebook Research OpenEDS Challenge.