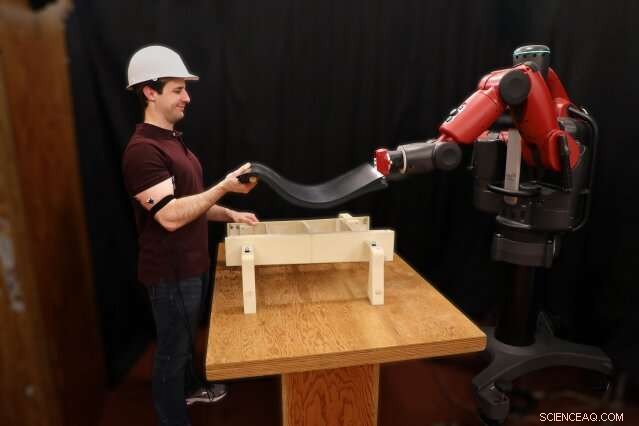

El autor principal, Joseph DelPreto, demuestra la capacidad del sistema para reflejar sus movimientos al monitorear la actividad muscular. Crédito:Joseph DelPreto / MIT CSAIL

Los humanos somos muy buenos colaborando. Por ejemplo, cuando dos personas trabajan juntas para llevar un objeto pesado como una mesa o un sofá, tienden a coordinar instintivamente sus movimientos, recalibrar constantemente para asegurarse de que sus manos estén a la misma altura que las de la otra persona. Nuestra capacidad natural para realizar este tipo de ajustes nos permite colaborar en tareas grandes y pequeñas.

Pero una computadora o un robot aún no pueden seguir el ejemplo de un humano con facilidad. Por lo general, los programamos explícitamente usando lenguaje de máquina, o entrenarlos para que entiendan nuestras palabras, à la asistentes virtuales como Siri o Alexa.

A diferencia de, Investigadores del Laboratorio de Ciencias de la Computación e Inteligencia Artificial del MIT (CSAIL) demostraron recientemente que es posible una colaboración más fluida entre robots y humanos a través de un nuevo sistema que desarrollaron. donde las máquinas ayudan a las personas a levantar objetos controlando sus movimientos musculares.

Apodado RoboRaise, el sistema implica colocar sensores de electromiografía (EMG) en los bíceps y tríceps de un usuario para monitorear la actividad muscular. Luego, sus algoritmos detectan continuamente cambios en el nivel del brazo de la persona, así como gestos discretos con las manos hacia arriba y hacia abajo que el usuario puede realizar para un control más preciso del motor.

El equipo utilizó el sistema para una serie de tareas relacionadas con la recogida y montaje de componentes de aviones simulados. En experimentos, los usuarios trabajaron en estas tareas con el robot y pudieron controlarlo a unas pocas pulgadas de las alturas deseadas al levantar y luego tensar el brazo. Era más preciso cuando se usaban gestos, y el robot respondió correctamente a aproximadamente el 70 por ciento de todos los gestos.

El autor principal, Joseph DelPreto, demuestra la capacidad del sistema para reflejar sus movimientos al monitorear la actividad muscular. Crédito:Joseph DelPreto / MIT CSAIL

El estudiante de posgrado Joseph DelPreto dice que podría imaginar a personas usando RoboRaise para ayudar en los entornos de fabricación y construcción, o incluso como asistente en la casa.

"Nuestro enfoque para levantar objetos con un robot tiene como objetivo ser intuitivo y similar a cómo podría levantar algo con otra persona, copiando aproximadamente los movimientos de los demás mientras se infieren ajustes útiles, "dice DelPreto, autor principal de un nuevo artículo sobre el proyecto con la profesora del MIT y directora de CSAIL, Daniela Rus. "La información clave es utilizar señales no verbales que codifiquen instrucciones sobre cómo coordinar, por ejemplo para levantar un poco más alto o más bajo. El uso de señales musculares para comunicarse casi convierte al robot en una extensión de usted mismo que puede controlar con fluidez ".

El proyecto se basa en el sistema existente del equipo que permite a los usuarios corregir instantáneamente los errores del robot con ondas cerebrales y gestos con las manos. ahora permite el movimiento continuo de una manera más colaborativa. "Nuestro objetivo es desarrollar la interacción humano-robot donde el robot se adapta al humano, en lugar de al revés. De esta forma el robot se convierte en una herramienta inteligente para el trabajo físico, "dice Rus.

Puede resultar complicado trabajar con las señales de EMG:a menudo son muy ruidosas, y puede ser difícil predecir exactamente cómo se mueve una extremidad en función de la actividad muscular. Incluso si puede estimar cómo se mueve una persona, Es posible que no esté claro cómo desea que responda el robot.

RoboRaise soluciona esto poniendo al ser humano en control. El sistema del equipo utiliza no invasivos, Sensores corporales que detectan la activación de neuronas a medida que tensa o relajas los músculos. El uso de wearables también evita problemas de oclusiones o ruido ambiental, lo que puede complicar las tareas relacionadas con la visión o el habla.

Luego, el algoritmo de RoboRaise procesa la actividad del bíceps para estimar cómo se mueve el brazo de la persona para que el robot pueda imitarlo aproximadamente. y la persona puede tensar o relajar ligeramente el brazo para mover el robot hacia arriba o hacia abajo. Si un usuario necesita que el robot se aleje más de su propia posición o mantenga una pose por un tiempo, solo pueden hacer gestos hacia arriba o hacia abajo para un control más preciso; una red neuronal detecta estos gestos en cualquier momento basándose en la actividad de bíceps y tríceps.

Un nuevo usuario puede empezar a utilizar el sistema muy rápidamente, con mínima calibración. Después de colocar los sensores, solo necesitan tensar y relajar el brazo unas cuantas veces y luego levantar un peso ligero a algunas alturas. La red neuronal que detecta gestos solo se entrena con datos de usuarios anteriores.

El equipo probó el sistema con 10 usuarios a través de una serie de tres experimentos de elevación:uno en el que el robot no se movió en absoluto, otro donde el robot se movió en respuesta a sus músculos pero no ayudó a levantar el objeto, y un tercero donde el robot y la persona levantaron un objeto juntos.

Cuando la persona tenía retroalimentación del robot, cuando podía verlo moverse o cuando estaban levantando algo juntos, la altura alcanzada era significativamente más precisa en comparación con no tener retroalimentación.

El equipo también probó RoboRaise en tareas de montaje, como levantar una hoja de caucho sobre una estructura de base. Pudo levantar con éxito tanto objetos rígidos como flexibles sobre las bases. RoboRaise se implementó en el robot humanoide Baxter del equipo, pero el equipo dice que podría adaptarse a cualquier plataforma robótica.

En el futuro, el equipo espera que agregar más músculos o diferentes tipos de sensores al sistema aumente los grados de libertad, con el objetivo final de realizar tareas aún más complejas. Las señales como el esfuerzo o la fatiga de la actividad muscular también podrían ayudar a los robots a brindar una asistencia más intuitiva. El equipo probó una versión del sistema que usa los niveles de bíceps y tríceps para decirle al robot con qué rigidez sostiene la persona el extremo del objeto; juntos, el ser humano y la máquina podrían arrastrar un objeto con fluidez o tensarlo rígidamente.

Esta historia se vuelve a publicar por cortesía de MIT News (web.mit.edu/newsoffice/), un sitio popular que cubre noticias sobre la investigación del MIT, innovación y docencia.