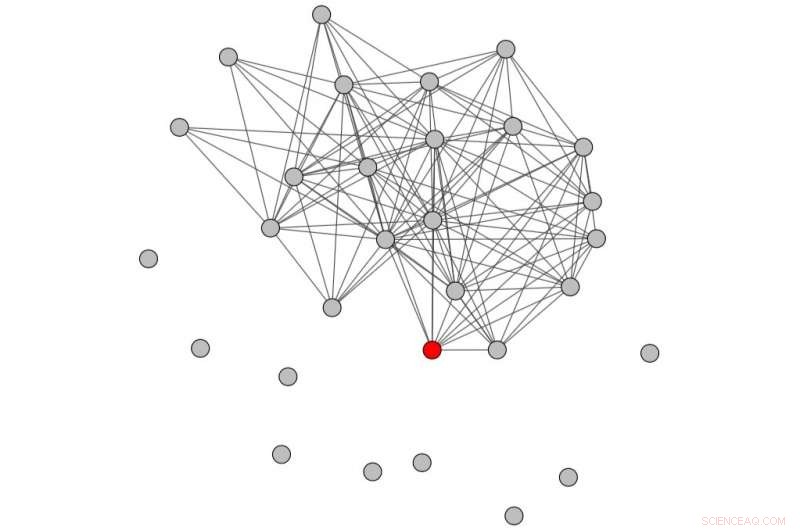

Gráfico conversacional obtenido considerando un período de tiempo anterior al abuso. Crédito:Papegnies et al.

Un equipo de investigadores de la Universidad de Aviñón ha desarrollado recientemente un sistema para detectar automáticamente el abuso en las comunidades en línea. Este sistema, presentado en un artículo publicado previamente en arXiv, se descubrió que supera los enfoques existentes para detectar abusos y moderar el contenido generado por el usuario.

"Las comunidades en línea en constante crecimiento ofrecen la oportunidad de difundir ideas a través de Internet, garantizando cierto anonimato a los usuarios, "dijeron los investigadores a TechXplore, vía correo electrónico. "Sin embargo, Estos espacios suelen tener usuarios que muestran un comportamiento abusivo. Para los líderes comunitarios, es importante moderar estos actos maliciosos, ya que no hacerlo podría envenenar a la comunidad, desencadenar el éxodo de usuarios y exponer a los administradores a problemas legales ".

La moderación del contenido generado por usuarios en línea generalmente se lleva a cabo manualmente por humanos; por eso, puede resultar caro y llevar mucho tiempo. Para reducir costos, Los investigadores han estado tratando de desarrollar herramientas de moderación de contenido totalmente automatizadas que podrían reemplazar o ayudar a los moderadores humanos.

"En este trabajo, formulamos la tarea de moderación del contenido como un problema de clasificación, y aplicar nuestro método a un corpus de mensajes intercambiados por jugadores de un MMORPG, un juego de rol multijugador masivo en línea, ", dijeron los investigadores.

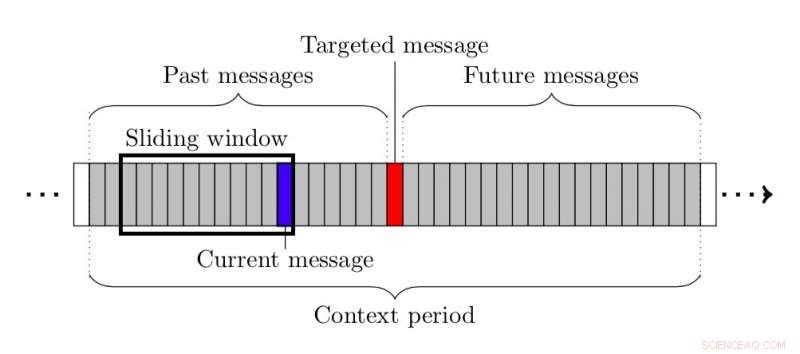

Como primer paso, los investigadores extrajeron redes de conversación de registros de chat sin procesar que representan las conversaciones en las que se envió cada mensaje abusivo, y los caracterizó utilizando medidas topológicas. Usaron sus resultados como características, capacitar a un clasificador para detectar abusos en plataformas en línea.

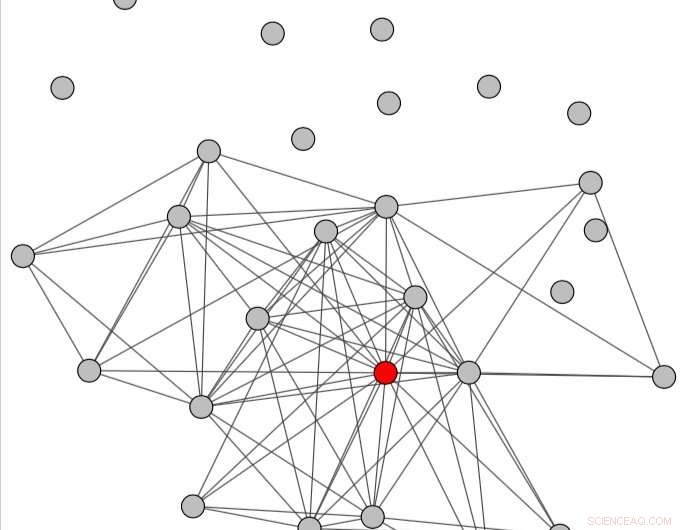

El gráfico conversacional obtenido al considerar un período de tiempo posterior al abuso. Crédito:Papegnies et al.

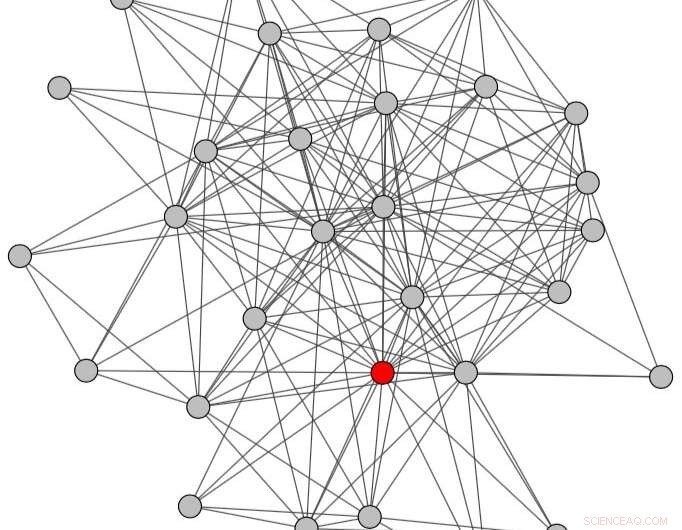

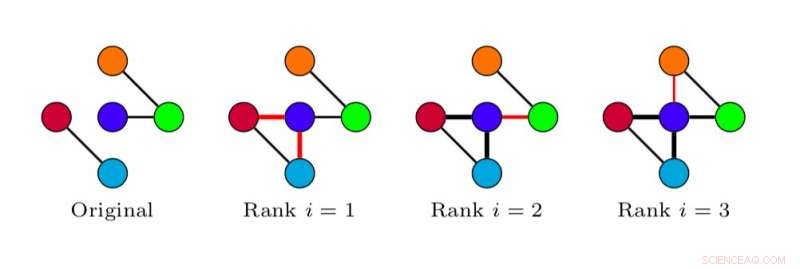

Al extraer las redes conversacionales, los investigadores siguieron un método de tres pasos. Primero, identificaron el subconjunto de mensajes que usarían para extraer la red. Luego, seleccionaron un subconjunto de usuarios que eran los posibles receptores de cada mensaje. Finalmente, agregaron bordes y revisaron sus pesos en función de estos posibles receptores de mensajes.

"Los métodos existentes para la detección automática de mensajes abusivos se centran en el contenido textual de los mensajes intercambiados, lo que plantea muchos problemas:problemas específicos del idioma, errores de sintaxis, faltas de ortografía, ofuscación, y otros, "explicaron los investigadores." Por el contrario, utilizamos solo la presencia / ausencia de interacciones entre usuarios, es decir, el hecho de que intercambien algunos mensajes (o no), por oposición a la naturaleza de los mensajes intercambiados. Ignorar el contenido nos permitió resolver estos problemas ".

Esencialmente, los investigadores modelaron conversaciones en línea utilizando un gráfico en el que los nodos representan a los usuarios y los enlaces representan los intercambios de mensajes. Usando medidas específicas de gráficos, pudieron observar diferencias en la forma en que se estructuran las conversaciones en función de si contienen o no mensajes abusivos. Estas diferencias se utilizaron luego para entrenar a un clasificador para que detecte el abuso en las conversaciones entre usuarios.

Gráfico conversacional obtenido considerando todo el período de tiempo (es decir, tanto antes como después del abuso). Crédito:Papegnies et al.

"Nuestro primer esfuerzo, presentado en un artículo anterior, se basó en el enfoque tradicional, es decir., utilizó el contenido textual de los mensajes, "explicaron los investigadores." Cuando propusimos este método basado en gráficos, no esperábamos que funcionara tan bien; incluso pensamos que daría como resultado un rendimiento más bajo en comparación con el método basado en contenido. Nos sorprendió mucho obtener resultados significativamente mejores. Este es el hallazgo más significativo de nuestro estudio:que, al menos para esta tarea específica, la estructura de la conversación es más discriminatoria que la naturaleza del contenido intercambiado ".

Crédito:Papegnies et al.

Crédito:Papegnies et al.

Los investigadores probaron su sistema en un conjunto de datos de comentarios de usuarios de un juego MMORPG francés y descubrieron que superaba los enfoques existentes. con una medida F de 83,89 cuando se utiliza el conjunto completo de funciones. Al reducir el conjunto de características y mantener solo las características más discriminatorias, pudieron reducir drásticamente el tiempo de computación, conservando un excelente rendimiento. En el futuro, su enfoque basado en gráficos también podría aplicarse a otras tareas de clasificación de mensajes, como la detección de trolls en línea.

"Ahora intentaremos fusionar ambos enfoques (basados en contenido y gráficos), para comprobar si aprovechan información similar, en cuyo caso los resultados serían similares, o si se basan en información complementaria, en ese caso, combinarlos debería conducir a mejoras en el rendimiento, ", agregaron los investigadores." Entonces, queremos avanzar hacia un método más automatizado para caracterizar nuestros gráficos conversacionales, llamadas incrustaciones de gráficos. Es un método basado en deep learning que consiste en entrenar una red neuronal para conseguir una representación eficiente de los gráficos. En comparación, actualmente hacemos esta parte del trabajo manualmente, a través de una tarea llamada selección de características ".

© 2019 Science X Network