Crédito:CC0 Public Domain

Una nueva encuesta masiva desarrollada por investigadores del MIT revela algunas preferencias globales distintas con respecto a la ética de los vehículos autónomos, así como algunas variaciones regionales en esas preferencias.

La encuesta tiene un alcance global y una escala única, con más de 2 millones de participantes en línea de más de 200 países que opinan sobre las versiones de un enigma ético clásico, el "Problema de la carretilla". El problema involucra escenarios en los que un accidente con un vehículo es inminente, y el vehículo debe optar por una de las dos opciones potencialmente fatales. En el caso de los automóviles sin conductor, eso podría significar desviarnos hacia un par de personas, en lugar de un gran grupo de espectadores.

"Básicamente, el estudio trata de comprender los tipos de decisiones morales a las que podrían tener que recurrir los vehículos autónomos, "dice Edmond Awad, un postdoctorado en el MIT Media Lab y autor principal de un nuevo artículo que describe los resultados del proyecto. "Todavía no sabemos cómo deberían hacer eso".

Todavía, Awad agrega, "Descubrimos que hay tres elementos que la gente parece aprobar más".

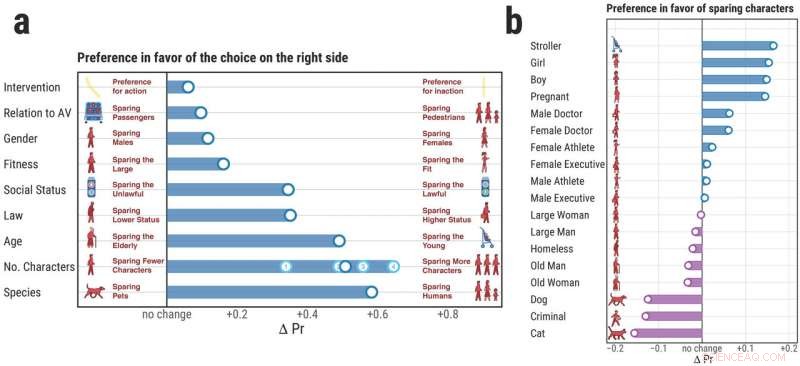

En efecto, las preferencias globales más enfáticas en la encuesta son para salvar la vida de los humanos sobre la vida de otros animales; perdonando la vida de muchas personas en lugar de unas pocas; y preservando la vida de los jóvenes, en lugar de personas mayores.

"Las principales preferencias fueron hasta cierto punto acordadas universalmente, "Awad señala." Pero el grado en que están de acuerdo con esto o no varía entre los diferentes grupos o países ". Por ejemplo, los investigadores encontraron una tendencia menos pronunciada a favorecer a las personas más jóvenes, en lugar de los ancianos, en lo que definieron como un grupo de países "orientales", incluidos muchos en Asia.

El papel, "El experimento de la máquina moral, "se publica en Naturaleza .

Los autores son Awad; Sohan Dsouza, estudiante de doctorado en el Media Lab; Richard Kim, asistente de investigación en el Media Lab; Jonathan Schulz, un postdoctorado en la Universidad de Harvard; Joseph Henrich, profesor de Harvard; Azim Shariff, profesor asociado de la Universidad de Columbia Británica; Jean-François Bonnefon, profesor de la Escuela de Economía de Toulouse; y Iyad Rahwan, profesor asociado de artes y ciencias de los medios en el Media Lab.

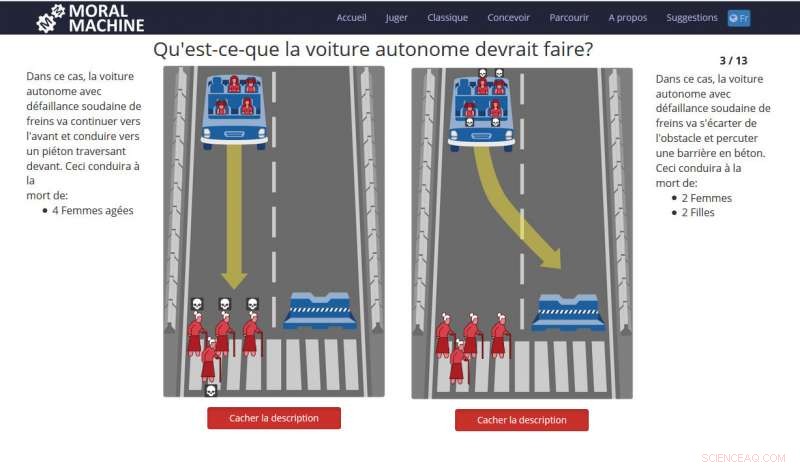

Ejemplo de situación propuesta en la plataforma Moral Machine. Crédito:Edmond Awad et al. Naturaleza.

Awad es un postdoctorado en el grupo de Cooperación Escalable del MIT Media Lab, que está dirigido por Rahwan.

Para realizar la encuesta, los investigadores diseñaron lo que ellos llaman "Máquina moral, "un juego en línea multilingüe en el que los participantes podrían expresar sus preferencias con respecto a una serie de dilemas a los que podrían enfrentarse los vehículos autónomos. Por ejemplo:si es así, ¿Deberían los vehículos autónomos salvar la vida de transeúntes respetuosos de la ley? o, alternativamente, peatones infractores de la ley que podrían estar cruzando imprudentemente? (La mayoría de las personas en la encuesta optaron por lo primero).

Todo dicho, "Moral Machine" compiló casi 40 millones de decisiones individuales de encuestados en 233 países; la encuesta recopiló 100 o más respuestas de 130 países. Los investigadores analizaron los datos en su conjunto, al mismo tiempo que divide a los participantes en subgrupos definidos por edad, educación, género, ingreso, y opiniones políticas y religiosas. Había 491, 921 encuestados que ofrecieron datos demográficos.

Los académicos no encontraron diferencias marcadas en las preferencias morales basadas en estas características demográficas, pero encontraron "grupos" más grandes de preferencias morales basadas en afiliaciones culturales y geográficas. Definieron "occidental, "" oriental, grupos de países "y" del sur ", y encontró algunas variaciones más pronunciadas en este sentido. Por ejemplo:los encuestados en los países del sur tenían una tendencia relativamente más fuerte a favorecer la protección de los jóvenes en lugar de los ancianos, especialmente en comparación con el grupo oriental.

Diagrama que presenta la diferencia entre la probabilidad de que las diferentes categorías de personas se salven en un accidente automovilístico. En este caso, la diferencia está a favor de las personas del lado derecho. Fig. B:Ventaja o desventaja relativa para cada categoría de personas en comparación con un adulto (hombre o mujer). Por ejemplo, la probabilidad de que un niño sea una niña se salve es 0,15 más alta que la de un adulto. Crédito:Edmond Awad et al. Naturaleza.

Awad sugiere que el reconocimiento de este tipo de preferencias debería ser una parte básica para informar la discusión de la esfera pública sobre estos temas. En todas las regiones, Dado que existe una preferencia moderada por evitar a los transeúntes que respetan la ley en lugar de a los peatones imprudentes, conocer estas preferencias podría, En teoria, inform the way software is written to control autonomous vehicles.

"The question is whether these differences in preferences will matter in terms of people's adoption of the new technology when [vehicles] employ a specific rule, " él dice.

Rahwan, for his part, notes that "public interest in the platform surpassed our wildest expectations, " allowing the researchers to conduct a survey that raised awareness about automation and ethics while also yielding specific public-opinion information.

"Por un lado, we wanted to provide a simple way for the public to engage in an important societal discussion, " Rahwan says. "On the other hand, we wanted to collect data to identify which factors people think are important for autonomous cars to use in resolving ethical tradeoffs."

Beyond the results of the survey, Awad suggests, seeking public input about an issue of innovation and public safety should continue to become a larger part of the dialogue surrounding autonomous vehicles.

"What we have tried to do in this project, and what I would hope becomes more common, is to create public engagement in these sorts of decisions, " Awad says.