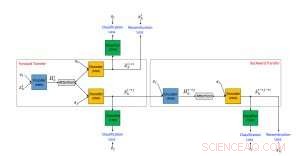

Marco propuesto de un algoritmo de transferencia de estilo de texto neuronal utilizando datos no paralelos. Crédito:IBM

Las redes sociales en línea se han convertido en una de las formas más importantes de comunicarse e intercambiar ideas. Desafortunadamente, el discurso a menudo se ve paralizado por un lenguaje abusivo que puede tener efectos dañinos en los usuarios de las redes sociales. Por ejemplo, una encuesta reciente de YouGov.uk descubrió que, entre la información que los empleadores pueden encontrar en línea sobre candidatos a puestos de trabajo, El lenguaje agresivo u ofensivo es la actividad de las redes sociales que más daña profesionalmente. Las redes de medios sociales en línea normalmente tratan el problema del lenguaje ofensivo simplemente filtrando una publicación cuando está marcada como ofensiva.

En el documento "Lucha contra el lenguaje ofensivo en las redes sociales con la transferencia de estilo de texto sin supervisión, "que se presentó en la 56a Reunión Anual de la Asociación de Lingüística Computacional (ACL 2018), presentamos un enfoque completamente nuevo para abordar este problema. Nuestro enfoque utiliza la transferencia de estilo de texto sin supervisión para traducir oraciones ofensivas en formas no ofensivas correspondientes. A lo mejor de nuestro conocimiento, Todo el trabajo anterior que aborda el problema del lenguaje ofensivo en las redes sociales se ha centrado únicamente en la clasificación de texto. Por lo tanto, esos métodos se pueden utilizar principalmente para marcar y filtrar el contenido ofensivo, pero nuestro enfoque propuesto da un paso adelante y produce una versión alternativa no ofensiva del contenido. Esto tiene dos beneficios potenciales para los usuarios de las redes sociales. Para aquellos usuarios que planean publicar un mensaje ofensivo, recibir una alerta de que el contenido es ofensivo y será bloqueado, junto con una versión más educada del mensaje que se puede publicar, podría animarlos a cambiar de opinión y evitar las blasfemias. Adicionalmente, para los usuarios que consumen contenido en línea, esto les permite ver y comprender el mensaje, pero en un tono cortés y no ofensivo.

Una arquitectura para reemplazar el lenguaje ofensivo

Nuestro método se basa en la arquitectura de red neuronal codificadora-decodificadora ahora popular, que es el enfoque más moderno para la traducción automática. En traducción automática, El entrenamiento de la red neuronal codificadora-decodificadora asume la existencia de una "Piedra Rosetta" donde el mismo texto está escrito tanto en el idioma de origen como en el de destino. Estos datos emparejados permiten a los desarrolladores determinar fácilmente si un sistema se traduce correctamente y, por lo tanto, entrenar a un sistema codificador-decodificador para que funcione bien. Desafortunadamente, a diferencia de la traducción automática, hasta donde sabemos, No existe un conjunto de datos de datos emparejados disponibles para el caso de sentencias ofensivas a no ofensivas. Es más, el texto transferido debe utilizar un vocabulario que sea común en un dominio de aplicación particular. Por lo tanto, Se necesitan métodos no supervisados que no utilicen datos emparejados para realizar esta tarea.

Propusimos un enfoque de transferencia de estilo de texto sin supervisión compuesto por tres componentes principales, a cada uno se le asignó una tarea separada durante el entrenamiento. Uno (un codificador RNN) analiza una oración ofensiva y comprime la información más relevante en un vector de valor real. Este es leído por otro componente (un decodificador RNN), que genera una nueva oración que es la versión traducida de la original. Luego, la oración traducida es evaluada por el tercer componente (un clasificador de CNN) para identificar si la salida se ha traducido correctamente del estilo ofensivo al no ofensivo. Adicionalmente, la oración generada también se "retrotraduce" de no ofensivo a ofensivo y se compara con la oración original para comprobar si se conservó el contenido. Si los resultados de cualquiera de las evaluaciones anteriores contienen errores, el sistema se ajusta en consecuencia. El codificador y el decodificador también son, en paralelo, entrenado mediante una configuración de autocodificación donde el objetivo consiste en reconstruir la frase de entrada. También utilizamos el mecanismo de atención que ayuda a garantizar la conservación del contenido. Nuestra principal contribución en términos de arquitectura es el uso combinado de un clasificador colaborativo, atención, y transferencia inversa.

Traducir lenguaje ofensivo

Probamos nuestro método propuesto utilizando datos de dos redes sociales populares:Twitter y Reddit. Creamos conjuntos de datos de textos ofensivos y no ofensivos clasificando aproximadamente 10 millones de publicaciones utilizando un clasificador de lenguaje ofensivo propuesto por Davidson et al. (2017). La siguiente tabla muestra ejemplos de oraciones ofensivas originales y las traducciones no ofensivas generadas por un método de transferencia de estilo de texto propuesto por Shen et al. (2017) y por nuestro enfoque. Nuestro sistema demostró un mejor desempeño en la traducción de oraciones ofensivas en no ofensivas mientras preserva el contenido general, pero a veces produce oraciones extrañas.

Este trabajo es un primer paso en la dirección de un nuevo enfoque prometedor para combatir las publicaciones abusivas en las redes sociales. La transferencia de estilo de texto sin supervisión es un área de investigación que acaba de comenzar a ver algunos resultados prometedores. Nuestro trabajo es una buena prueba de concepto de que los métodos actuales de transferencia de estilo de texto sin supervisión se pueden aplicar a tareas útiles. Sin embargo, Es importante tener en cuenta que los enfoques actuales de transferencia de estilo de texto sin supervisión solo pueden manejar bien los casos en los que el problema del lenguaje ofensivo es léxico (como los ejemplos que se muestran en la tabla) y se puede resolver cambiando o eliminando algunas palabras. Los modelos que usamos no serán efectivos en casos de sesgo implícito en los que las palabras normalmente inofensivas se usan de manera ofensiva.

Creemos que las versiones mejoradas del método propuesto, junto con el uso de volúmenes mucho mayores de datos de entrenamiento, podrá hacer frente a otras publicaciones abusivas, como las que contengan incitación al odio o a la violencia, racismo, y sexismo. Imaginamos que nuestro método podría usarse para mejorar la IA conversacional, asegurándose de que los chatbots que aprenden interactuando con usuarios en línea no reproducirán posteriormente lenguaje ofensivo y discurso de odio. El control parental es otro uso potencial del sistema propuesto.

Esta historia se vuelve a publicar por cortesía de IBM Research.