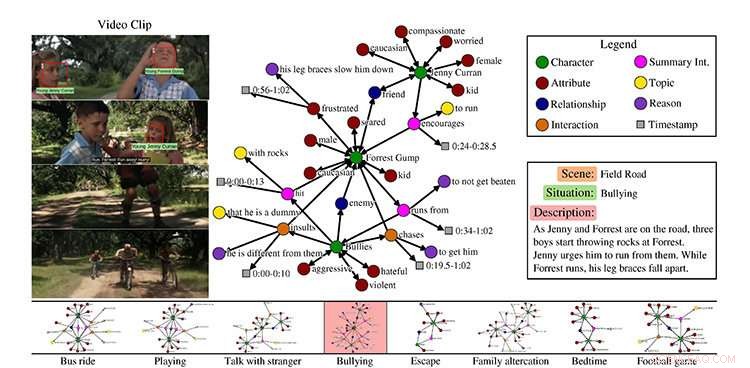

Un ejemplo del conjunto de datos MovieGraphs, escena de la película Forrest Gump. Crédito:Universidad de Toronto

Si tu amigo esta triste puedes decir algo para animarlos. Si le pide a su compañero de trabajo que haga café, conocen los pasos para completar esta tarea.

Pero, ¿cómo los robots artificialmente inteligentes, o IA, aprender a comportarse de la misma manera que los humanos?

Los investigadores de la Universidad de Toronto están presentando nuevos enfoques hacia las IA socialmente inteligentes, en la conferencia Computer Vision and Pattern Recognition (CVPR), el principal evento anual de visión por computadora de esta semana en Salt Lake City, Utah.

¿Cómo entrenamos a un robot a comportarse?

En su artículo MovieGraphs:Towards Understanding Human-Centric Situations from Videos, Paul Vicol, un doctorado estudiante de informática, Makarand Tapaswi, un investigador postdoctoral, Lluis Castrejón, un graduado de maestría en ciencias de la computación de la U of T que ahora es un Ph.D. estudiante del Instituto de Algoritmos de Aprendizaje de la Universidad de Montreal, y Sanja Fidler, profesor asistente en el departamento de ciencias matemáticas y computacionales de la U of T Mississauga y departamento de posgrado de ciencias de la computación en tres campus, han acumulado un conjunto de datos de videoclips anotados de más de 50 películas.

"MovieGraphs es un paso hacia la próxima generación de agentes cognitivos que pueden razonar sobre cómo se sienten las personas y sobre las motivaciones de sus comportamientos, "dice Vicol." Nuestro objetivo es permitir que las máquinas se comporten de manera adecuada en situaciones sociales. Nuestros gráficos capturan muchas propiedades de alto nivel de situaciones humanas que no se han explorado en trabajos anteriores ".

Su conjunto de datos se centra en películas del drama, romance, y géneros de comedia, como Forrest Gump y Titanic, y sigue a los personajes a lo largo del tiempo. No incluyen películas de superhéroes como Thor porque no son muy representativas de la experiencia humana.

"La idea era utilizar películas como proxy del mundo real, "dice Vicol.

Cada clip él dice, está asociado con un gráfico que captura detalles detallados sobre lo que sucede en el clip:qué personajes están presentes, sus relaciones, interacciones entre ellos junto con las razones por las que interactúan, y sus emociones.

Vicol explica que el conjunto de datos muestra, por ejemplo, no solo que dos personas discutan, pero de qué están discutiendo y las razones por las que discuten que provienen tanto de señales visuales como del diálogo. El equipo creó su propia herramienta para habilitar la anotación, que fue realizado por un solo anotador para cada película.

"Todos los clips de una película se anotan consecutivamente, y el gráfico completo asociado con cada clip es creado por una persona, lo que nos da una estructura coherente en cada gráfico, y entre gráficos a lo largo del tiempo, " él dice.

Con su conjunto de datos de más de 7, 500 clips, los investigadores introducen tres tareas, explica Vicol. El primero es la recuperación de videos, basado en el hecho de que los gráficos se basan en los videos.

"Por lo tanto, si realiza una búsqueda mediante un gráfico que dice que Forrest Gump está discutiendo con otra persona, y que las emociones de los personajes son tristes y enojados, entonces puedes encontrar el clip, " él dice.

El segundo es el orden de interacción, que se refiere a determinar el orden más plausible de interacciones entre personajes. Por ejemplo, explica si un personaje le da un regalo a otro personaje, la persona que recibe el regalo diría "gracias".

"Normalmente no dirías 'gracias, 'y luego recibir un regalo. Es una forma de evaluar si estamos capturando la semántica de las interacciones ".

Su tarea final es la predicción de la razón basada en el contexto social.

"Si nos centramos en una interacción, ¿Podemos determinar la motivación detrás de esa interacción y por qué ocurrió? Básicamente, eso es intentar predecir cuándo alguien le grita a otra persona la frase real que explicaría por qué, " él dice

Tapaswi dice que el objetivo final es aprender el comportamiento.

"Imagínese, por ejemplo, en un clip, la máquina básicamente encarna a Jenny [de la película Forrest Gump]. ¿Cuál es una acción apropiada para Jenny? En una escena es para animar a Forrest a huir de los matones. Así que estamos tratando de que las máquinas aprendan el comportamiento apropiado ".

"Apropiado en el sentido que permiten las películas, por supuesto."

Captura de pantalla:MIT CSAIL / VirtualHome:Simulación de actividades domésticas a través de programas

¿Cómo aprende un robot las tareas del hogar?

Dirigido por el profesor asistente del Instituto de Tecnología de Massachusetts Antonio Torralba y Fidler de la U of T, VirtualHome:Simulación de actividades domésticas a través de programas, está entrenando a un agente humano virtual usando lenguaje natural y un hogar virtual, para que el robot pueda aprender no solo a través del lenguaje, pero al ver explica el estudiante de maestría en ciencias de la computación de la U of T, Jiaman Li, un autor colaborador con U of T Ph.D. estudiante de ciencias de la computación Wilson Tingwu Wang.

Li explica que la acción de alto nivel puede ser "trabajar en la computadora" y la descripción incluye:encender la computadora, sentado frente a él, escribiendo en el teclado y agarrando el mouse para desplazarse.

"Entonces, si le contamos a un humano esta descripción, 'Trabajar en la computadora, 'el humano puede realizar estas acciones al igual que las descripciones. Pero si le decimos a los robots esta descripción, ¿Cómo hacen eso exactamente? El robot no tiene este sentido común. Necesita pasos muy claros, o programas ".

Debido a que no existe un conjunto de datos que incluya todo este conocimiento, ella dice que los investigadores crearon uno usando una interfaz web para recopilar los programas, que proporcionan el nombre de la acción y la descripción.

"Luego construimos un simulador para que tengamos un ser humano virtual en un hogar virtual que pueda realizar estas tareas, " ella dice.

Por su participación en el proyecto en curso, Li está utilizando el aprendizaje profundo, una rama del aprendizaje automático que entrena a las computadoras para que aprendan, para generar automáticamente programas a partir de texto o video para estos programas.

Sin embargo, no es una tarea fácil realizar cada acción en el simulador, dice Li, ya que el conjunto de datos resultó en más de 5, 000 programas.

"Simular todo lo que se hace en una casa es muy difícil, y damos un paso hacia esto implementando las acciones atómicas más frecuentes como caminar, sentarse, y recoger, "dice Fidler.

"Esperamos que nuestro simulador se utilice para entrenar robots en tareas complejas en un entorno virtual, antes de pasar al mundo real ".

MovieGraphs fue apoyado en parte por el Consejo de Investigación de Ciencias Naturales e Ingeniería de Canadá (NSERC) y VirtualHome es apoyado en parte por la Red NSERC COmputing Hardware for Emerging Intelligent Sensing Applications (COHESA).