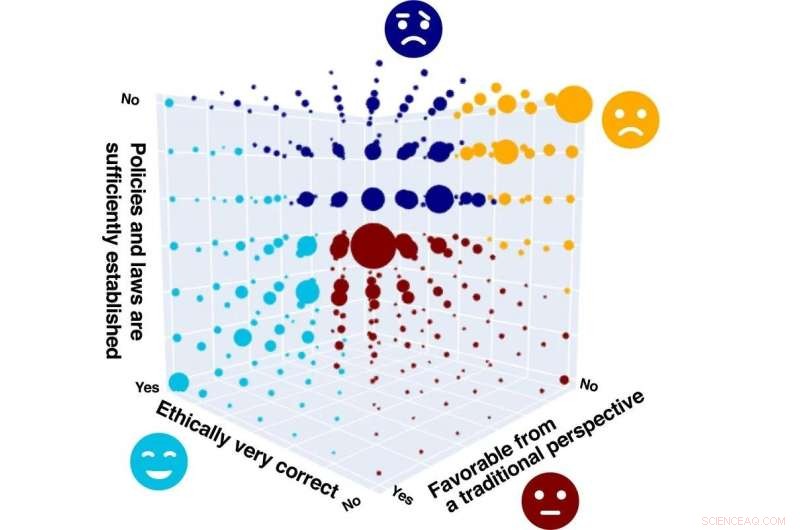

Las respuestas de los encuestados en Japón, EE. UU. y Alemania se separaron en respuestas éticas, legales y tradicionales. Por medio de la segmentación, las respuestas se pueden codificar por colores según si la respuesta del encuestado fue positiva (azul claro), negativa (naranja), preocupada por cuestiones legales (azul marino) o no preocupada por cuestiones legales (carmesí). Crédito:Ikkatai et al./Kavli IPMU

Las personas en Japón, EE. UU. y Alemania muestran diferentes preocupaciones con respecto al uso de la inteligencia artificial (IA) en entretenimiento, servicios de compras o para ayudar a encontrar delincuentes, informa un nuevo estudio en AI and Ethics .

Según el estudio, los japoneses tendían a mostrar más preocupación por el uso de la IA para combatir el crimen, mientras que los alemanes y los estadounidenses mostraban más preocupación por los aspectos éticos y sociales del uso de la IA en el entretenimiento.

"Descubrimos que hay una diferencia en los niveles de comprensión de AI y ELSI [temas éticos, legales y sociales] entre países. Creo que será importante llevar a cabo debates exhaustivos sobre los problemas legales y políticos que rodean a AI", dijo First. autor y profesor asociado de la Universidad de Kanazawa, Yuko Ikkatai.

Actualmente, la IA se está utilizando en una amplia gama de campos, lo que ha generado actitudes positivas y negativas en el público en general. Las políticas de ética difieren de un país a otro, como en Japón, donde las pautas enfatizan la regulación de la IA y la disminución de las preocupaciones de las personas, mientras que en los EE. UU. enfatizan la necesidad de maximizar los beneficios sociales de la IA y mencionan los riesgos a largo plazo, mientras que en Europa las pautas enfatizan los derechos y deberes de las personas.

Un equipo de investigación dirigido por el Instituto Kavli para la Física y Matemáticas del Universo (Kavli IPMU), profesor Hiromi Yokoyama, Ikkatai, y el Instituto de Física de la Inteligencia de la Universidad de Tokio, profesor asistente Tilman Hartwig, notó las actitudes éticas hacia la IA, un universal, avanzado tecnología, variaba entre países. Los investigadores dicen que reconocer las actitudes públicas sobre la IA en diferentes países será cada vez más importante antes de implementar nuevas tecnologías de IA.

Su estudio involucró la realización de una encuesta en línea en Japón, Estados Unidos y Alemania, pidiendo a los encuestados que observaran cuatro escenarios diferentes de IA y respondieran tres preguntas sobre cada uno de ellos, teniendo en cuenta los aspectos éticos, legales y sociales (ELSI). . El primer escenario involucró el uso de IA para cantantes generados por IA, el segundo escenario, compras de clientes de IA, el tercero, armas autónomas de IA y, por último, predicciones de actividades delictivas de IA. Se eligieron alrededor de 1000 encuestados en cada país, lo que refleja la población de su propio país por edad, sexo y ubicación.

Después de analizar sus resultados, los investigadores pudieron separar las respuestas en cuatro grupos:personas con puntos de vista optimistas, personas con puntos de vista negativos, personas preocupadas por cuestiones legales y personas que no se preocupan por cuestiones legales. El equipo lo ha llamado segmento AI y ELSI.

Los investigadores habían desarrollado previamente una métrica visual octogonal, análoga a un sistema de calificación, que podría ser útil para los investigadores de IA que deseaban saber cómo el público podría percibir su trabajo. El desarrollo del segmento de IA y ELSI se debió a que los investigadores encontraron que la métrica visual octogonal tenía una versatilidad limitada cuando se aplicaba a nuevas tecnologías distintas de la IA.

En el estudio más reciente del equipo, encontraron que, en general, cuanto mayor era el encuestado, más preocupados estaban por los problemas de IA y ELSI, mientras que los encuestados más familiarizados con IA dijeron que estaban más preocupados por los problemas legales.

Con respecto a cada escenario, los encuestados alemanes y estadounidenses estaban más preocupados por los problemas éticos y sociales relacionados con los cantantes generados por IA.

Sobre el uso de la IA para realizar compras, los encuestados alemanes estaban más preocupados por los problemas éticos, mientras que los encuestados japoneses estaban más preocupados por los problemas legales.

Con respecto a las armas autónomas de IA, los encuestados japoneses y alemanes estaban más preocupados por las cuestiones éticas, y los encuestados japoneses también estaban más preocupados por las cuestiones sociales y legales.

Finalmente, con respecto al uso de IA para capturar criminales, los encuestados de EE. UU. estaban más preocupados por las cuestiones éticas, sociales y legales.

"Es emocionante que podamos segmentar las respuestas tan claramente en cuatro grupos, y la característica más distintiva es la percepción de los problemas legales de la IA. Esto es sólido entre los tres países y muestra que la comunicación sobre las leyes y políticas relacionadas con la IA es muy importante". ", dijo Hartwig.

Los detalles de su estudio se publicaron en AI and Ethics el 1 de septiembre. + Explora más