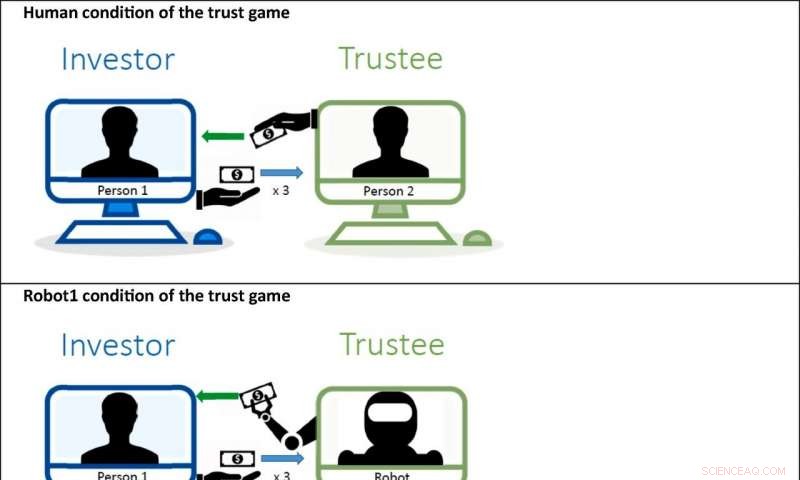

En la condición humana, un participante humano (Persona 1) en el papel de inversor se empareja con un participante humano (Persona 2) en el papel de fideicomisario. En la condición Robot1, un humano (Persona 1) en el papel de inversor se empareja con un robot en el papel de fideicomisario. En la condición Robot2, un participante humano (Persona 1) en el papel de inversor se empareja con un robot en el papel de fideicomisario que actúa en nombre de un participante pasivo (Persona 2). Crédito:Universidad Chapman

En una investigación publicada en el Revista de psicología económica , Los científicos exploran si las personas confían en los robots como confían en sus compañeros humanos. Es importante comprender estas interacciones porque las interacciones basadas en la confianza con robots son cada vez más comunes en el mercado. lugar de trabajo, en la carretera y en el hogar. Los resultados muestran que las personas extienden la confianza de manera similar a los humanos y los robots, pero las reacciones emocionales de las personas en las interacciones basadas en la confianza varían según el tipo de pareja.

El estudio fue dirigido por Eric Schniter de la Universidad Chapman, Doctor. y Timothy Shields, Doctor. junto con Daniel Sznycer de la Universidad de Montreal, Doctor.

Los investigadores utilizaron un experimento de juego de confianza anónimo durante el cual un fideicomisario humano decidió cuánto de una dotación de $ 10 dar a un fideicomisario:un humano, un robot, o un robot cuyos beneficios van a otro humano. El fideicomitente humano sabe que hubo ganancias potenciales de la transferencia y el fideicomisario determinaría si debe corresponder mediante la transferencia de una cantidad. Los robots fueron programados para imitar la reciprocidad previamente observada por los fideicomisarios humanos.

Está bien establecido que en juegos de confianza como este, la mayoría de las personas toman decisiones que conducen al beneficio tanto del fideicomitente como del fideicomisario. Después de la interacción, los participantes calificaron varias emociones positivas y negativas.

El diseño experimental permitió a los investigadores explicar dos aspectos importantes de la confianza en los robots explicables:cuánto confían los humanos en los robots en comparación con otros humanos y los patrones de cómo los humanos reaccionan emocionalmente después de las interacciones con los robots frente a otros humanos.

El experimento muestra que las personas extienden niveles similares de confianza hacia los humanos y los robots. Esto no es lo que encontraríamos si los humanos confiaran ciegamente o se negaran a confiar en los robots. Este tampoco sería el resultado si creemos que las personas otorgan confianza con la única intención de mejorar el bienestar de otros humanos. ya que confiar en un robot no mejora el bienestar de otra persona.

El resultado es coherente con la opinión de que las personas confían tanto para obtener ganancias monetarias como para descubrir información sobre las tendencias conductuales humanas. A través de sus interacciones de confianza con los robots, los participantes aprendieron sobre la cooperación de los seres humanos.

Las emociones sociales son más que sentimientos:regulan el comportamiento social. Más específicamente, emociones sociales como la culpa, gratitud, enfado, y el orgullo afectan la forma en que tratamos a los demás e influyen en cómo nos tratan los demás en interacciones basadas en la confianza.

Los participantes en este experimento experimentaron las emociones sociales de manera diferente dependiendo de si su pareja era un robot o un humano. El hecho de no corresponder a la inversión del fideicomitente en el fideicomisario desencadenó más ira cuando el fideicomisario era un humano que cuando el fideicomisario era un robot. Similar, la reciprocidad desencadenaba más gratitud cuando el fideicomisario era un humano que cuando el fideicomisario era un robot.

Más lejos, las emociones de los participantes discriminaban finamente entre los tipos de robots. Informaron sentir un orgullo y una culpa más intensos cuando la recompensa del fideicomisario del robot fue para un humano que cuando el robot actuó solo.

Dado que la confianza inicial no difirió según el tipo de socio, pero las emociones sociales lo hicieron, una posibilidad distinta es que la reextensión de la confianza en interacciones repetidas será diferente cuando la pareja es un ser humano, un robot, o un robot vinculado a un beneficiario humano.

En el futuro, La conducción presentará oportunidades de interacción en las que importará si las decisiones las toman humanos o robots y si sirven a los humanos o no. Algunos autos que se usan para entregas o camionetas pueden conducir sin ocupantes humanos, otros automóviles se conducirán con ocupantes humanos pasivos y, sin embargo, otros automóviles serán conducidos por conductores humanos. Se producen interacciones análogas con agentes de registro automatizados o robóticos, cajeros de banco, cirujanos etc.

Las asociaciones con reciprocadores consistentes pueden consolidarse en asociaciones más productivas cuando los reciprocadores son compañeros humanos, porque los humanos suscitan más gratitud que los robots. En cambio, las asociaciones con reciprocadores inconsistentes pueden ser más estables cuando los reciprocadores son robots, porque los robots provocan menos ira que los humanos. Más lejos, los humanos experimentaron el orgullo y la culpa con mayor intensidad en interacciones en las que los robots servían a un beneficiario, lo que sugiere que las personas serán más propensas a volver a extender la confianza a socios similares.

La arquitectura cognitiva humana evolucionó para tener suficiente estructura y contenido para promover la supervivencia y reproducción de nuestros antepasados y, al mismo tiempo, tener la flexibilidad para navegar por nuevos desafíos y oportunidades. Estas características permiten a los humanos diseñar e interactuar racionalmente con inteligencia artificial y robots. Todavía, interacciones con autómatas, y la capacidad de la ciencia para explicar estas interacciones es imperfecta porque los autómatas carecen de las señales psicofísicas que esperamos en una interacción y, a menudo, se guían por lógicas de decisión inexplicables o poco intuitivas.